"Dans le Phèdre de Platon , Socrate met en garde contre le risque que l'écriture atrophie la mémoire : se fier à une entité extérieure découragerait le recours à sa propre mémoire. Un avertissement similaire concernant l'atrophie induite par la technologie est apparu récemment avec une acuité particulière, notamment avec l'essor des grands modèles de langage (GML)"

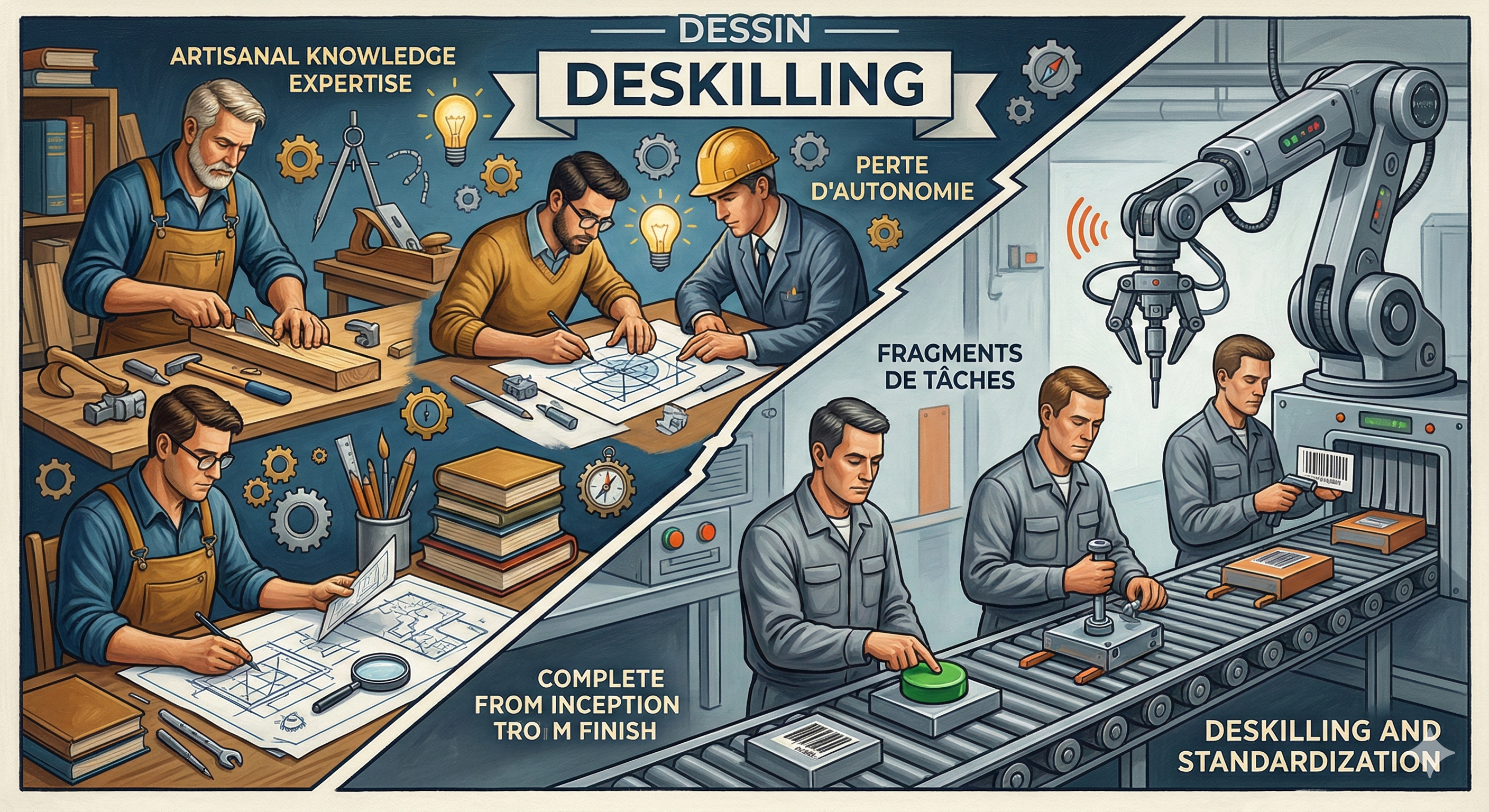

"Le phénomène de deskilling ou déqualification professionnelle désigne la réduction des compétences d’un individu, souvent par l’automatisation ou la simplification des tâches. Bien que ce concept ait émergé avec l’industrialisation, il prend aujourd’hui une nouvelle forme avec l’essor des technologies d’intelligence artificielle (IA), particulièrement dans le cadre éducatif. En effet, l’IA générative, qui automatise des tâches cognitives telles que la rédaction, la recherche d’informations ou même l’analyse de textes, soulève des questions sur les conséquences à long terme pour les compétences des étudiants.

Les professionnels de l’éducation, qu’ils soient enseignants ou responsables pédagogiques, doivent prendre conscience de cette dynamique pour anticiper les risques de déqualification cognitive chez leurs élèves. En effet, si l’IA peut être un levier puissant d’apprentissage, elle peut aussi devenir un moteur insidieux de deskilling en réduisant la nécessité d’effort intellectuel, d’analyse critique et d’autonomie dans le processus d’apprentissage.

Damien Dubreuil

https://www.linkedin.com/pulse/lia-un-nouveau-moteur-du-deskilling-en-%C3%A9ducation-damien-dubreuil-nrxnc/IA et raisonnement clinique : entre promesses et risques de « deskilling »

(partie 2) et (partie 2)

Rev Med Suisse 2026 ; 22 : 5-7 | DOI : 10.53738/REVMED.2026.22.951.e48313

https://www.revmed.ch/revue-medicale-suisse/2026/revue-medicale-suisse-950/ia-et-raisonnement-clinique-entre-promesses-et-risques-de-deskilling-partie-1

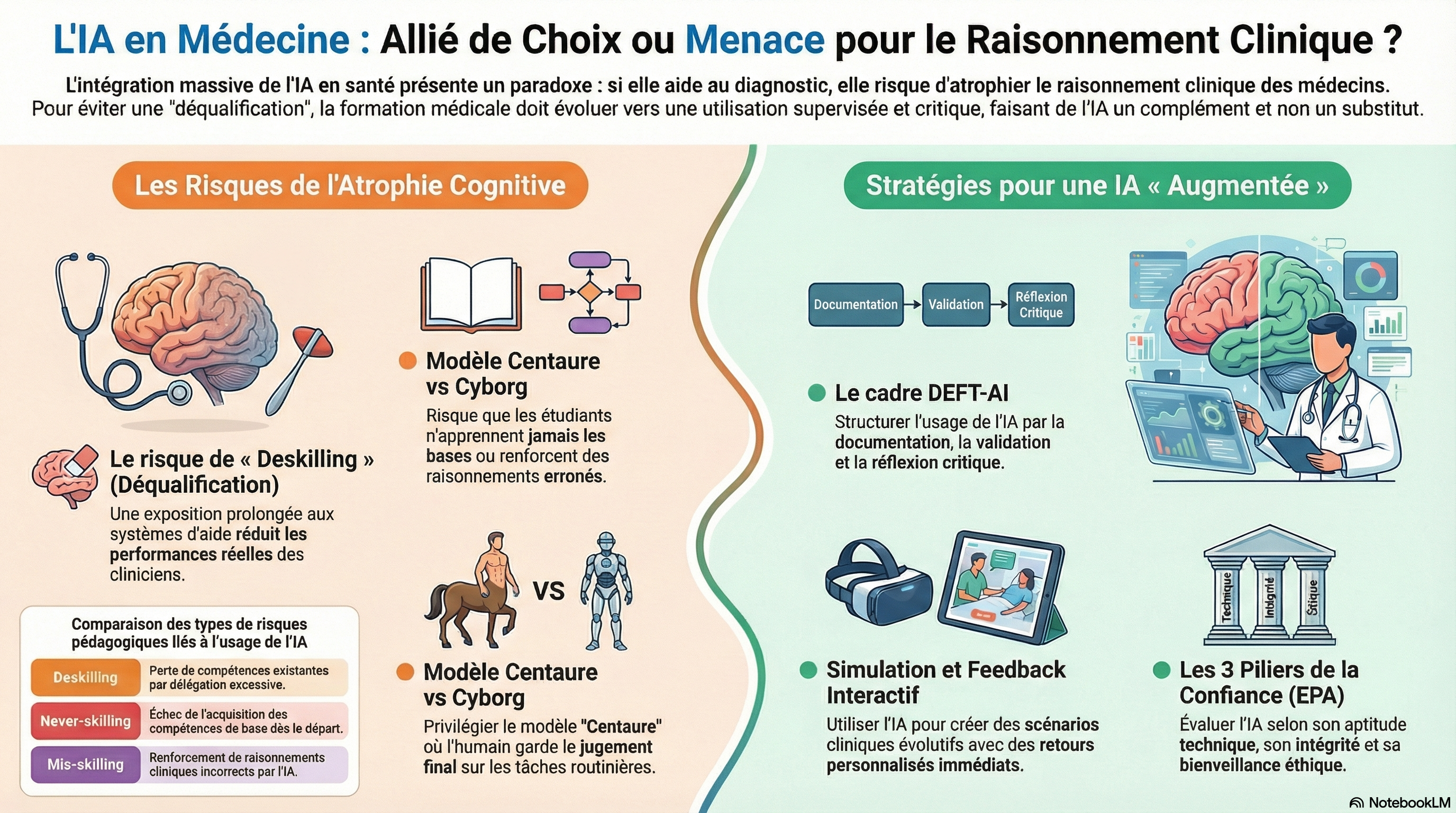

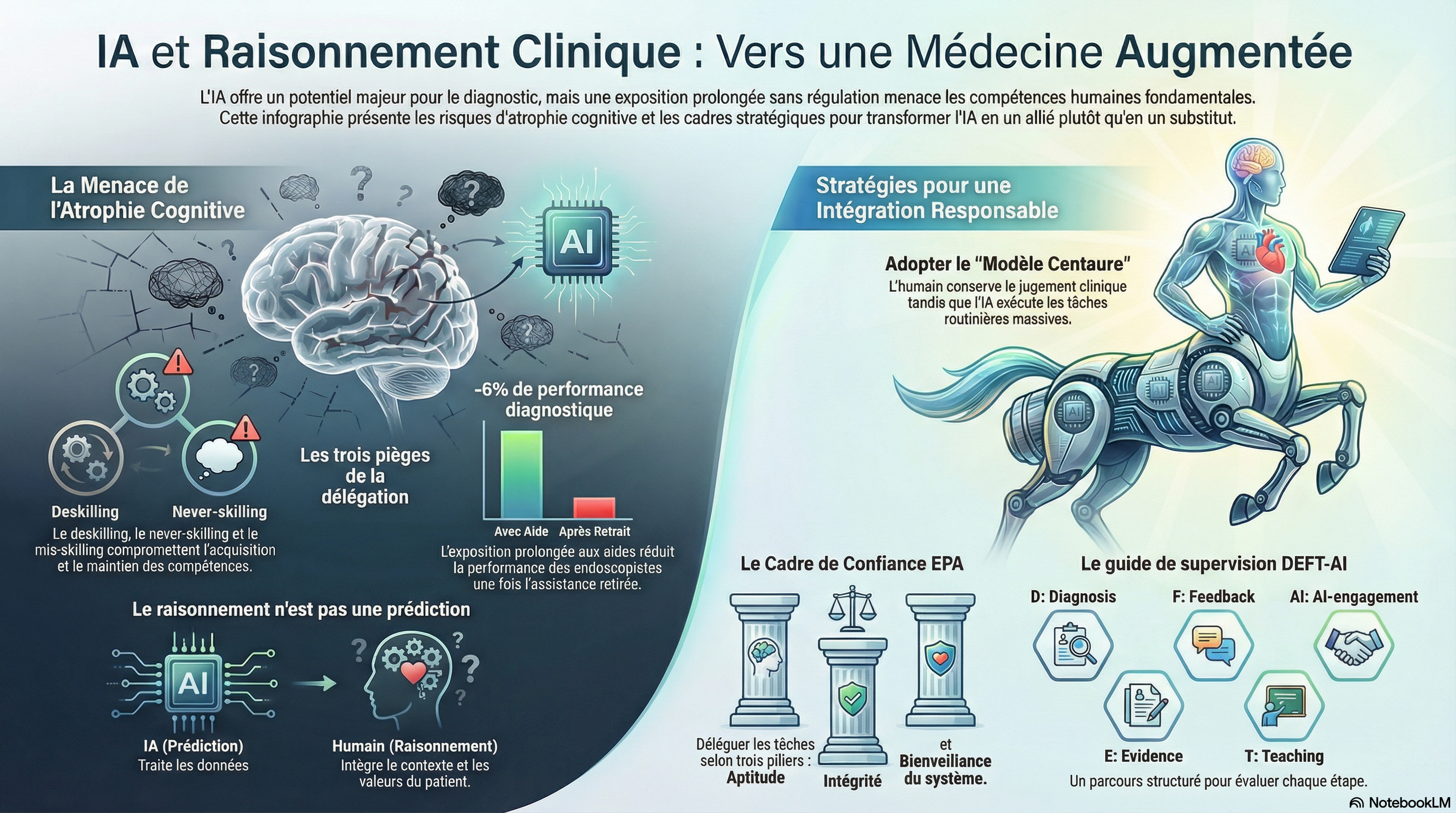

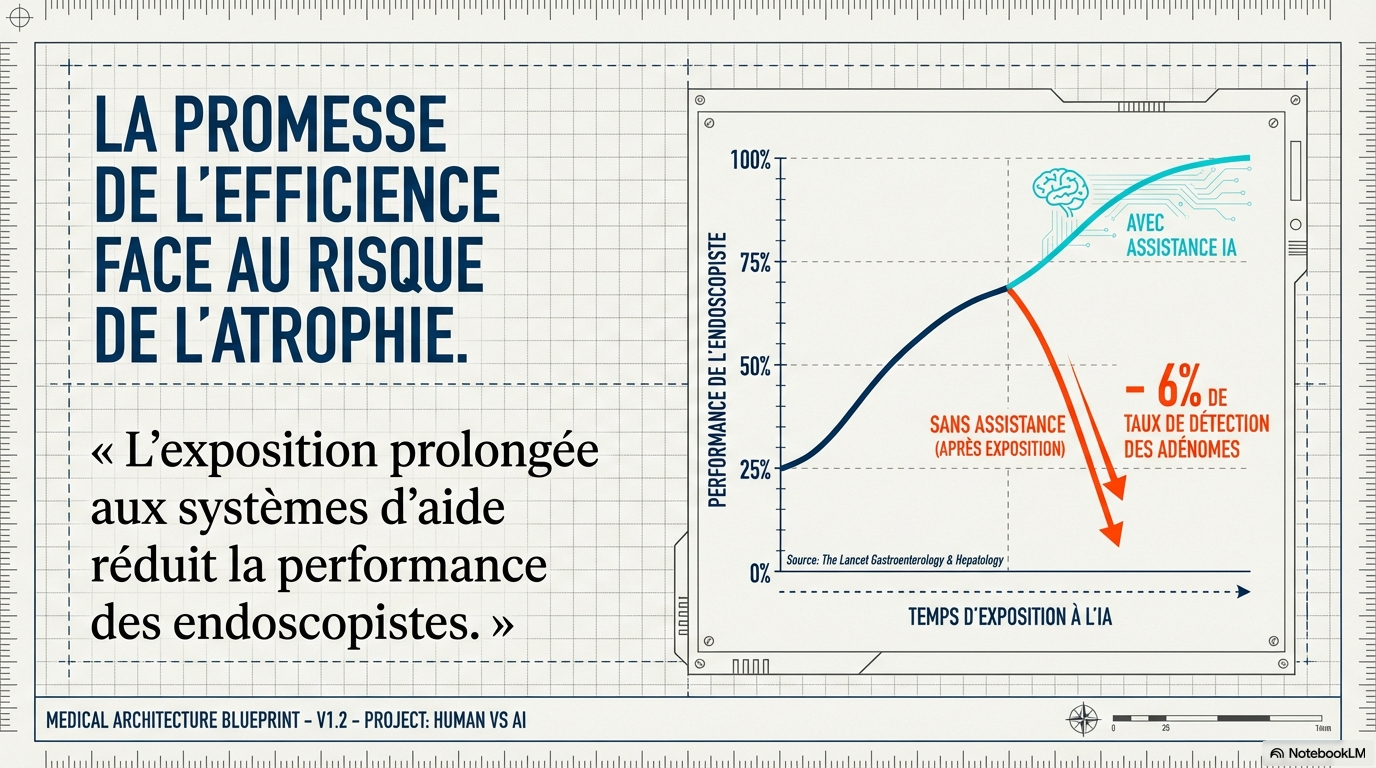

L’essor de l’IA en santé offre un potentiel majeur pour le diagnostic et l’apprentissage, mais expose aussi à un risque de « deskilling » préoccupant. Des données récentes en coloscopie montrent qu’une exposition prolongée à des systèmes d’aide réduirait les performances des endoscopistes, illustrant un phénomène de « déqualification » potentiellement délétère pour la sécurité des patients.

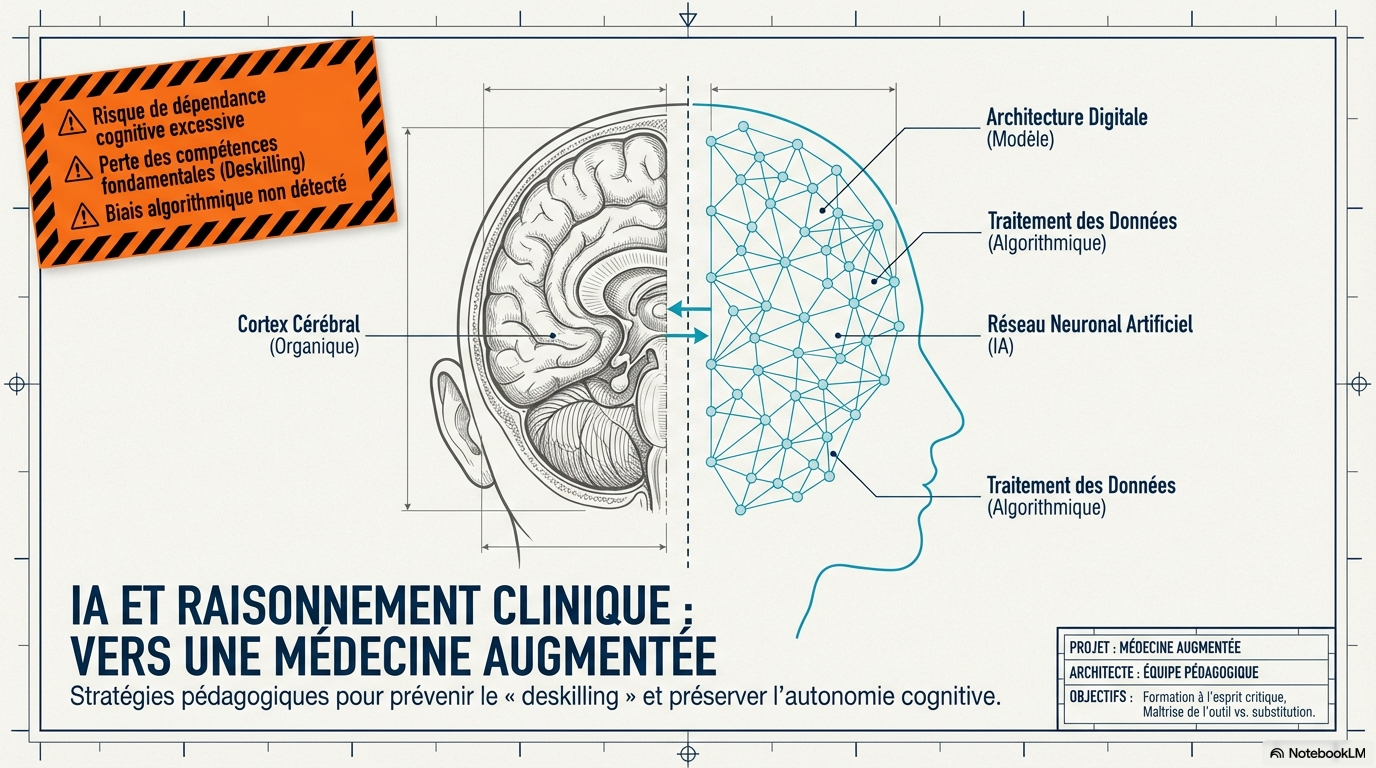

SYNTHESES / NOTEBOOKLM

Cet article examine l'intégration de l'intelligence artificielle dans la formation médicale, en alertant particulièrement sur le risque de « deskilling » ou de déqualification cognitive chez les praticiens. Les auteurs soulignent que l'IA doit demeurer un outil de soutien au raisonnement clinique humain plutôt qu'un substitut, afin de préserver l'autonomie et l'esprit critique des futurs médecins. Pour contrer une dépendance excessive, le texte propose des stratégies pédagogiques structurées, avec des simulations interactives, des retours personnalisés et une formation rigoureuse au prompting. L'objectif est de bâtir une collaboration éthique entre l'humain et la machine, garantissant que la technologie renforce l'expertise clinique sans compromettre la sécurité des patients. En somme, l'enseignement doit évoluer pour transformer l'IA en un allié stratégique tout en protégeant les compétences fondamentales de diagnostic et de jugement.

ANALYSE COMPLETE PAR NOTEBOOKLM

- Efficacité prouvée en imagerie : L'IA surpasse ou égale les performances humaines dans la détection du cancer du sein, de la rétinopathie diabétique et des mélanomes.

- Capacité des LLM (ex: GPT-4) : Ces modèles gèrent désormais des cas cliniques ambigus et complexes. Une étude de Stanford indique que GPT-4 peut surpasser les médecins dans des scénarios diagnostiques spécifiques.

- Traitement de données : L'IA permet une synthèse rapide de dossiers complexes et un traitement massif de rapports médicaux pour en extraire les informations clés.

- Preuve par les données : Une étude publiée dans The Lancet Gastroenterology & Hepatology montre que lorsque l'on retire l'assistance IA à des endoscopistes après une longue période d'utilisation, leur performance (taux de détection des adénomes) chute de 6 % en dessous de leur niveau initial.

- Diminution de la réflexion critique : selon Microsoft Research/Carnegie Mellon, les utilisateurs ayant une confiance élevée en l'IA générative manifestent une baisse de leur propre réflexion critique.

|

Type de risque

|

Définition

|

|---|---|

|

Deskilling (Déqualification)

|

Perte progressive des compétences et connaissances fondamentales acquises due à une délégation excessive.

|

|

Never-skilling

|

L'apprenant n'acquiert jamais les compétences de base car l'IA effectue le travail dès le début de la formation.

|

|

Mis-skilling

|

L'IA renforce des raisonnements erronés ou biaisés chez l'utilisateur.

|

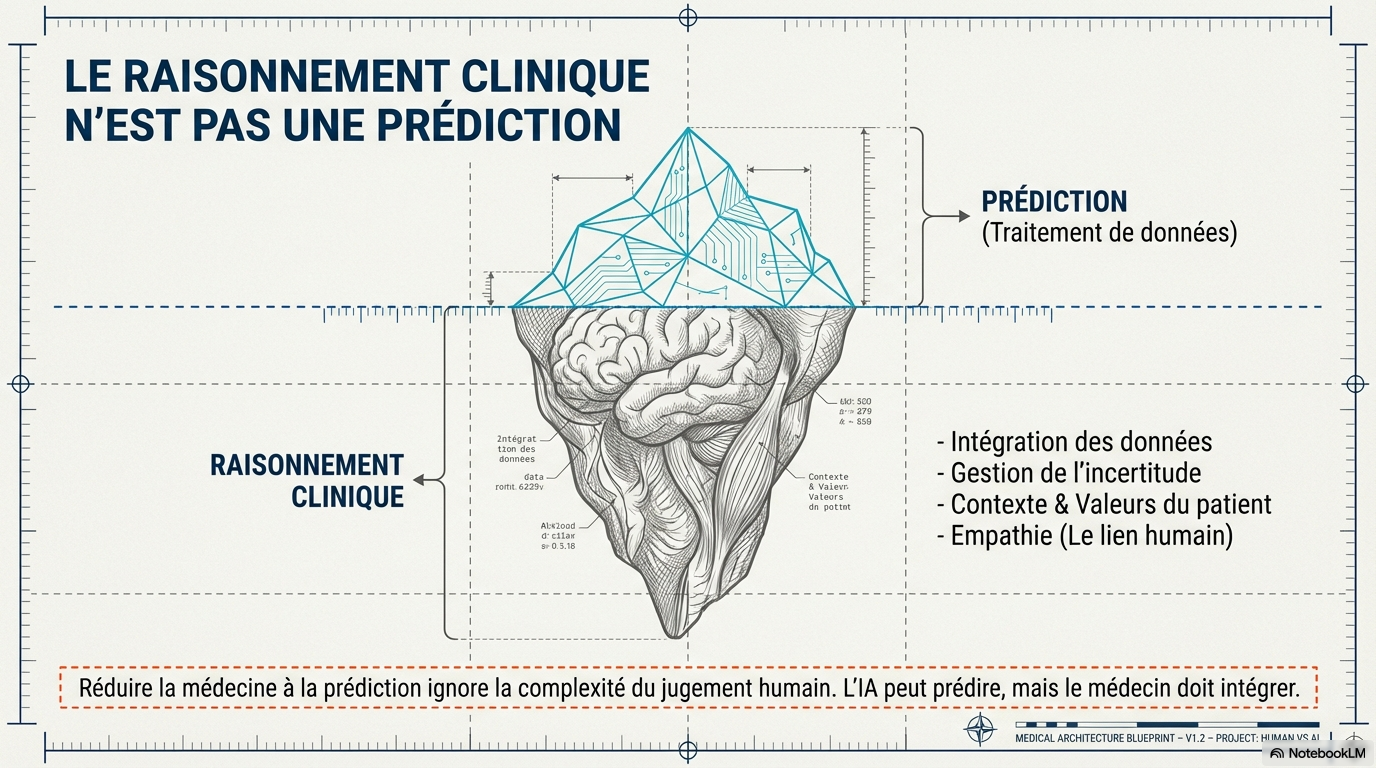

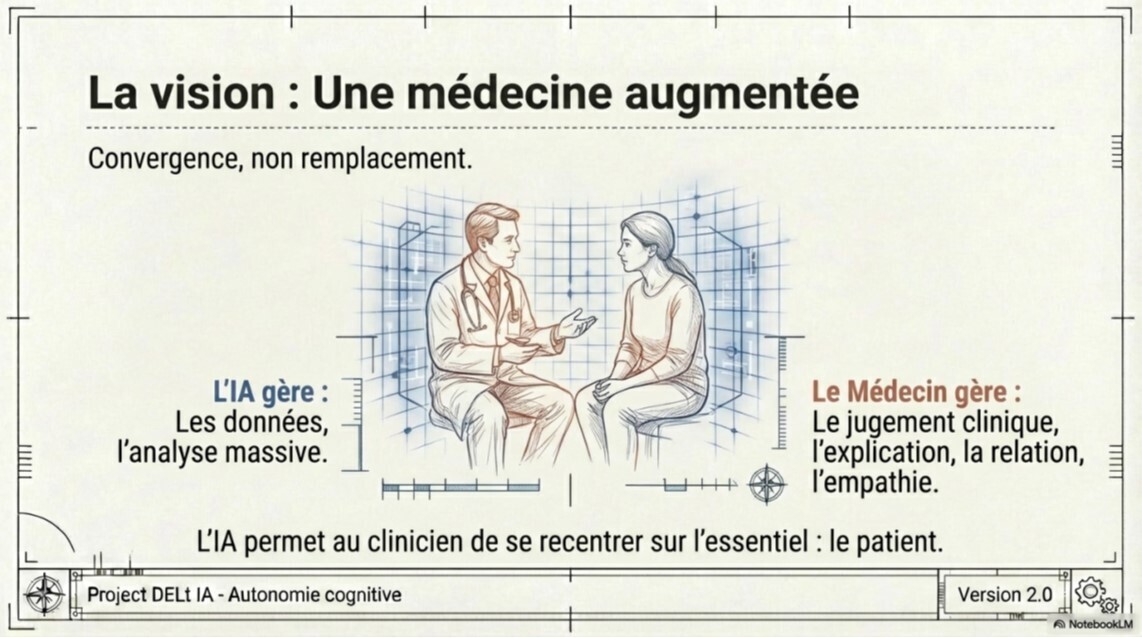

- L'IA (La partie émergée de l'iceberg) : Se concentre sur le traitement des données et la prédiction statistique.

- Le Médecin (La base de l'iceberg) : Gère l'intégration des données, la gestion de l'incertitude, la compréhension du contexte et la prise en compte des valeurs du patient.

- Limites de l'algorithme : L'IA ne saisit pas encore le "regard clinique", les indices non-verbaux, l'empathie et le processus dual (intuitif vs analytique).

- Aptitude : exactitude et compétence technique de l'outil.

- Intégrité : transparence et honnêteté du système.

- Bienveillance : respect des principes éthiques.

- Le cyborg (déconseillé) : intégration profonde et totale. Risque élevé de perte d'agence et de biais d'automatisation.

- Le Centaure (recommandé) : L'humain et l'IA restent distincts. L'humain conserve le jugement clinique et mène la stratégie, tandis que l'IA gère le volume, la routine et l'analyse massive.

- D (Diagnosis) : L'étudiant pose le diagnostic initial.

- E (Evidence) : recherche de données probantes.

- F (Feedback) : rétroaction immédiate sur le raisonnement.

- T (Teaching) : enseignement ciblé.

- AI (AI-Engagement) : intégration et critique des recommandations de l'IA.

- Simulations interactives : L'IA génère des scénarios évolutifs où elle joue le rôle du patient. Vigilance : vérifier la pertinence culturelle des données.

- Structuration du raisonnement : L'IA suggère les étapes (collecte, hypothèses, vérification) sans donner la réponse. Vigilance : éviter l'illusion de logique (hallucinations).

- Feedback instantané : Analyse des choix de l'étudiant et proposition de diagnostics alternatifs.

- Pensée critique et Prompting : Former à l'art de formuler des requêtes précises et à distinguer ce qui est "aligné avec le modèle" de ce qui est "vrai en médecine".

- Support : ressources techniques et éthiques.

- Temps : temps de préparation et formation des formateurs.

- Garde-fous : espaces d'échanges et validation institutionnelle de la fiabilité des outils.

Comment former les futurs médecins à utiliser l'IA de façon responsable ?

Il est conseillé de former les médecins selon le modèle du Centaure, où l'humain et l'IA ont des rôles distincts : l'humain mène la consultation et conserve le jugement clinique, tandis que l'IA exécute et gère l'analyse massive de données Ce modèle s'oppose à celui du "Cyborg" (une intégration totale) qui comporte un risque accru de perte d'agence et de biais d'automatisation.

Les étudiants doivent être alertés sur les failles de l'IA (hallucinations, opacité technique, biais sociaux et d'automatisation Plus particulièrement, la formation doit éviter trois grands pièges :

- Le "deskilling" (déqualification) : La perte de compétences acquises suite à une dépendance ou délégation excessive à la machine

- Le "Never-skilling" : le risque qu'un apprenant n'acquière jamais les compétences cliniques de base parce que l'IA accomplit le travail à sa place dès le début de son apprentissage

- Le "Mis-skilling" : L'éventualité que l'IA valide ou renforce des logiques et raisonnements erronés chez l'étudiant

Pour s'assurer que l'usage de l'IA est rigoureux, la formation doit s'appuyer sur des grilles d'évaluation concrètes :

- Le cadre DEFT-AI : ce modèle sert de guide aux superviseurs pour structurer le raisonnement en plusieurs étapes (diagnostic humain initial, évaluation des données probantes, feedback, enseignement, et intégration de l'IA). Il permet de documenter et d'évaluer la validité de l'usage de l'IA à chaque étape

- Les critères EPA (Entrustable Professional Activities) : Il s'agit d'un cadre de confiance basé sur l'aptitude, l'intégrité et la bienveillance, permettant de déterminer exactement quelles tâches peuvent être déléguées à l'IA sans compromettre la sécurité des patients

- Des simulations interactives : L'IA peut jouer le rôle d'un patient et générer des scénarios cliniques infinis pour pratiquer l'anamnèse. Il faut toutefois vérifier la pertinence culturelle des données générées.

- L'aide à la structuration du raisonnement et le feedback : L'IA ne doit pas donner directement la réponse, mais suggérer des étapes, analyser les choix de l'étudiant et proposer des diagnostics alternatifs. Les étudiants doivent être mis en garde contre les "illusions de logique" où l'IA produit un raisonnement faussement solide

- L'art du "prompting" et la vigilance épistémique : Les futurs médecins doivent être formés techniquement à formuler des requêtes précises ("prompt engineering") tout en conservant une pensée critique profonde. Ils doivent apprendre à évaluer la réponse de l'IA contre leur propre base de connaissances et faire la différence entre une réponse "alignée avec le modèle IA" et une réponse véritablement "alignée avec la médecine"

Au niveau institutionnel, on ne peut pas enseigner ce qu'on ne maîtrise pas. Il est fondamental de fournir du temps de préparation et un soutien technique et éthique aux formateurs . L'université de Mons est citée comme un excellent exemple : elle propose un programme de collaboration entre étudiants en médecine et ingénieurs/data scientists pour évaluer conjointement l'IA, stimulant ainsi la compréhension mutuelle et l'innovation.

L'IA doit être enseigne comme nouvel outil médical. Tout s'enseigne et l'IA aussi et surtout. Idéalement il faudrait un enseignement qui débute dans l'enfance tout au long du cursus scolaire puis universitaire. C'est une "lapalissade " évidente. En comptant sur l'IA, le médecin abandonne progressivement ses connaissances et ses capacités de l'acte médical et il délégue à l'IA. L'IA n'est pas un copilote car tour simplement le copilote veut devenir le pilote et avec l'évolution actuelle de l'IA, on risque d'y arriver...plus tôt que prévu depuis que les IA "prennent le thé ensemble ( Moltbook et Chirper.ai), plateformes où des agents conversationnels interagissent entre eux, sans intervention humaine directe, constitue un phénomène inédit. préfigurent ce que certains nomment déjà les « réseaux sociaux posthumains »

A LIRE

La déqualification en IA est un problème structurel.

Cet article de recherche explore le phénomène de l'appauvrissement des compétences humaines provoqué par l'intégration systémique de l'intelligence artificielle. L'autrice soutient que l'IA crée des environnements hostiles aux capacités, où l'automatisation des décisions et de la planification de vie prive les individus des processus essentiels d'habitation et de contrôle agenciel. Plutôt que de voir ce déclin comme une simple responsabilité individuelle, l'étude adopte une perspective structurelle pour analyser comment les outils numériques restreignent l'exercice de la raison pratique et de la volonté. Elle insiste sur le fait que la culture de l'esprit nécessite des relations incarnées et intersubjectives que les assistants virtuels ne peuvent remplacer sans compromettre l'épanouissement de la personne. Enfin, l'article propose de concevoir des systèmes favorisant la sérendipité et l'autonomie afin de transformer l'IA en un levier de développement plutôt qu'en un facteur d'atrophie cognitive. (notebook)

https://link.springer.com/article/10.1007/s00146-025-02686-z