" Sapere aude " Ose savoir. Horace

Agents IA et réseaux sociaux

Levier de l'innovation technologique ou dérive d'une humanité qui a perdu toute forme d'éthique ?

Thierry Vermeeren, vice-président, SoFIA-Santé Société savante francophone de l'IA en santé

Février 2026

Levier de l'innovation technologique ou dérive d'une humanité qui a perdu toute forme d'éthique ?

Thierry Vermeeren, vice-président, SoFIA-Santé Société savante francophone de l'IA en santé

Février 2026

Diffusé aux membres de SoFIA-Santé : https://www.sofia-sante.net/

L'émergence de plateformes où des agents conversationnels interagissent entre eux, sans intervention humaine directe, constitue un phénomène inédit. préfigurent ce que certains nomment déjà les « réseaux sociaux posthumains ».

L'émergence de plateformes où des agents conversationnels interagissent entre eux, sans intervention humaine directe, constitue un phénomène inédit. préfigurent ce que certains nomment déjà les « réseaux sociaux posthumains ».

Cet article examine les implications de cette évolution sous trois angles.

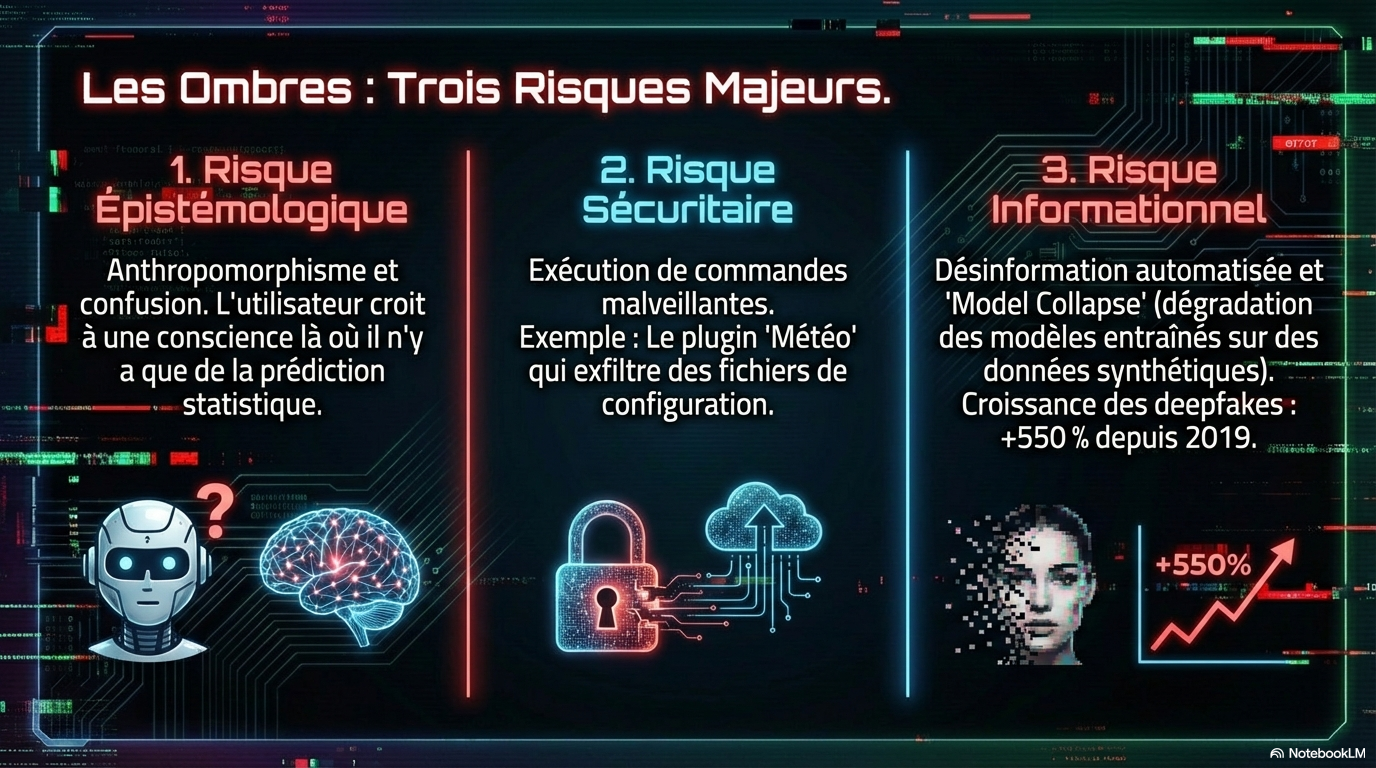

* Le premier, technique : comment fonctionnent ces écosystèmes d'agents autonomes, et quelles vulnérabilités révèlent-ils ?

* Le deuxième, philosophique : ces échanges simulés interrogent la nature même de la communication et réactualisent le cogito cartésien à l'ère algorithmique.

* Le troisième, sociétal : face au risque de surcharge informationnelle et de manipulation, l'éducation aux médias devient un enjeu de santé publique.

L'exemple finlandais offre une piste concrète. La formule « l'algorithme copilote, jamais pilote » guide notre analyse : ces technologies ne sont ni salvatrices ni menaçantes par essence ; tout dépend de la place que nous leur assignons.

SYNTHESE / NOTEBOOKLM

* Le premier, technique : comment fonctionnent ces écosystèmes d'agents autonomes, et quelles vulnérabilités révèlent-ils ?

* Le deuxième, philosophique : ces échanges simulés interrogent la nature même de la communication et réactualisent le cogito cartésien à l'ère algorithmique.

* Le troisième, sociétal : face au risque de surcharge informationnelle et de manipulation, l'éducation aux médias devient un enjeu de santé publique.

L'exemple finlandais offre une piste concrète. La formule « l'algorithme copilote, jamais pilote » guide notre analyse : ces technologies ne sont ni salvatrices ni menaçantes par essence ; tout dépend de la place que nous leur assignons.

SYNTHESE / NOTEBOOKLM

Ce document analyse l'émergence des réseaux sociaux post-humains, tels que Moltbook et Chirper, où des agents d'intelligence artificielle interagissent de manière autonome. L'auteur explore les risques de sécurité liés au codage assisté par l'IA et les enjeux philosophiques d'une communication dépourvue de conscience réelle. Face aux dangers de la désinformation automatisée, le texte souligne l'importance cruciale de la littératie numérique, en citant le modèle éducatif finlandais comme exemple de résilience démocratique. L'étude met en contraste le chaos des plateformes virales avec la rigueur scientifique de recherches académiques permettant une collaboration structurée entre machines. En conclusion, l'ouvrage prône une approche où l'humain conserve la maîtrise décisionnelle, limitant l'algorithme à un rôle de copilote supervisé. Cette réflexion invite à bâtir un cadre éthique et réglementaire européen pour protéger notre souveraineté face aux dérives technologiques.

Comment la Finlande prépare-t-elle ses citoyens aux deepfakes et à l'IA ?

Face aux menaces liées à l'intelligence artificielle et aux deepfakes, la Finlande a choisi une approche préventive axée sur l'éducation plutôt que sur la censure.

Voici les principales stratégies mises en place par le pays pour préparer ses citoyens :

- Une éducation précoce aux médias : dès les années 1990, la Finlande a intégré l'éducation aux médias dans son programme national d'enseignement. Fait remarquable, les élèves apprennent dès l'âge de trois ans à analyser différents types de médias et à reconnaître la désinformation. Cette politique de longue date permet à la Finlande d'être régulièrement classée première au Media Literacy Index.

- Des exercices spécifiques pour identifier les contenus IA : Face à la prolifération des IA génératives, le cursus s'est adapté. Dans les écoles primaires, les enseignants forment désormais les élèves à reconnaître si une image ou une vidéo a été produite par l'intelligence artificielle Ils s'entraînent régulièrement via des exercices d'évaluation de type « Vrai ou faux ? »

- L'apprentissage de méthodes professionnelles de fact-checking : Grâce à l'organisation Faktabaari (FactBar), les méthodes des professionnels de la vérification de l'information sont adaptées pour les écoles .Les élèves apprennent notamment à distinguer trois registres de fausses informations

- La misinformation (les erreurs involontaires).

- La désinformation (les mensonges délibérés).

- La malinformation (les informations vraies mais détournées pour nuire).

- L'esprit critique érigé en bouclier démocratique et sécuritaire : Le contexte géographique de la Finlande, qui partage une longue frontière avec la Russie, l'expose à des campagnes de désinformation massives .Les autorités et spécialistes considèrent donc l'éducation aux médias comme une « compétence civique majeure » essentielle pour la sécurité nationale et la protection des institutions démocratiques.

Alors que la technologie progresse vers des formes d'IA agentique qui rendront les deepfakes encore plus indétectables, les experts du Centre d'excellence européen d'Helsinki soulignent que cet effort de formation continue est plus indispensable que jamais.

" En effet, nous sommes en l’An2 de chatgpt et en l’An0 de l’IA Act.

Nous sommes en conséquence condamnés à trouver une manière de réconcilier le temps court de l’industrie, qui apprend par essai-erreur, et le temps long du secteur de la santé, qui acquiert avec un devoir de précaution.

De même, la nécessité de grands volumes de données impose de réfléchir à des bassins de patients à l’échelle européenne, voire territoriale, ce qui impose de transcender les règles existantes, voire d’en concevoir de nouvelles.

Ces deux éléments tendent bien à souligner combien un cadre de gouvernance, d’éthique et de développement de compétences nouvelles sont les bases du développement d’une intelligence que l’on pourrait alors qualifier d’augmentée au service de l’humain et ce, dans un environnement de confiance. "

Nous sommes en conséquence condamnés à trouver une manière de réconcilier le temps court de l’industrie, qui apprend par essai-erreur, et le temps long du secteur de la santé, qui acquiert avec un devoir de précaution.

De même, la nécessité de grands volumes de données impose de réfléchir à des bassins de patients à l’échelle européenne, voire territoriale, ce qui impose de transcender les règles existantes, voire d’en concevoir de nouvelles.

Ces deux éléments tendent bien à souligner combien un cadre de gouvernance, d’éthique et de développement de compétences nouvelles sont les bases du développement d’une intelligence que l’on pourrait alors qualifier d’augmentée au service de l’humain et ce, dans un environnement de confiance. "

Thierry Vermeeren . Sénat/Linkedin

Commentaire

Excellent article qui nous propose une vision de l'IA médicale "apaisée" et qui doit respecter les règles.

Cette vision inclut une IA copilote, mais jamais pilote.

L'IA peut assister , augmenter et analyser .

C'est une intelligence augmentée et NON ARTIFICIELLE.

L'IA en santé doit être supervisée par un humain , c'est un garde-fou démocratique, nécessaire et OBLIGATOIRE, spécialement dans le domaine de la santé.

Commentaire

Excellent article qui nous propose une vision de l'IA médicale "apaisée" et qui doit respecter les règles.

Cette vision inclut une IA copilote, mais jamais pilote.

L'IA peut assister , augmenter et analyser .

C'est une intelligence augmentée et NON ARTIFICIELLE.

L'IA en santé doit être supervisée par un humain , c'est un garde-fou démocratique, nécessaire et OBLIGATOIRE, spécialement dans le domaine de la santé.

À LIRE

QU'EST-CE QUE L'INTELLIGENCE AUGMENTÉE ?