" I’m sorry, Dave. I’m afraid I can’t do that..." L'ordonateur HAL 9000, refusant d'ouvrir la baie du vaisseau dans 2001, l'Odyssée de l'espace, Stanley Kubrick

Deep learning, ou apprentissage profond en français, est une sous-catégorie de l'apprentissage automatique (machine learning) qui utilise des réseaux de neurones artificiels pour modéliser et comprendre des structures complexes dans les données.

1. Réseaux de Neurones : Le deep learning utilise des réseaux de neurones avec de nombreuses couches (d'où le terme "profond") pour traiter les informations. Chaque couche apprend différentes caractéristiques des données.

2. Apprentissage Automatique : Comme d'autres méthodes d'apprentissage automatique, le deep learning permet aux machines d'apprendre à partir de données. Cependant, il est particulièrement efficace pour traiter des données non structurées comme les images, le texte et l'audio.

3. Applications : Le deep learning est utilisé dans de nombreux domaines, tels que la reconnaissance d'images, la traduction automatique, la reconnaissance vocale, et même les voitures autonomes.

4. Exemple : Imaginez un système qui peut reconnaître des visages dans des photos. Le deep learning permet au système d'apprendre à identifier des caractéristiques comme les yeux, le nez, et la bouche, puis à les assembler pour reconnaître un visage complet.

En résumé, le deep learning est une technique puissante qui permet aux machines d'apprendre à partir de grandes quantités de données en utilisant des réseaux de neurones complexes.

LLM, ou Large Language Model

LLM, ou Large Language Model (Modèle de Langage de Grande Taille), est un type de modèle d'intelligence artificielle conçu pour comprendre et générer du texte de manière similaire à un humain.

1. Compréhension du Texte : Un LLM est entraîné sur de vastes quantités de texte pour apprendre les motifs et les structures du langage humain. Cela lui permet de comprendre le contexte et la signification des mots dans une phrase ou un paragraphe.

2. Génération de Texte : Grâce à cette compréhension, un LLM peut générer du texte cohérent. Par exemple, il peut compléter une phrase, répondre à des questions, ou même écrire des histoires.

3. Polyvalence : Les LLM peuvent être utilisés pour diverses tâches, comme la traduction de langues, la rédaction d'articles, ou l'assistance dans des conversations.

4. Apprentissage Continu : Ces modèles s'améliorent avec plus de données et d'entraînement, devenant de plus en plus précis et capables de gérer des tâches complexes.

En résumé, un LLM est comme un assistant intelligent qui peut lire, comprendre et écrire du texte, en s'appuyant sur une vaste base de connaissances acquises à partir de nombreux exemples de langage humain.

Chatbot

Un chatbot est un programme informatique conçu pour simuler une conversation avec des utilisateurs humains.

1. Interaction : Un chatbot peut discuter avec vous via du texte, comme dans une messagerie instantanée. Il peut répondre à des questions, fournir des informations, ou même raconter des blagues.

2. Automatisation : Les chatbots sont souvent utilisés pour automatiser des tâches courantes, comme le service client. Par exemple, un chatbot peut vous aider à suivre une commande ou à réserver un billet.

3. Apprentissage : Certains chatbots utilisent l'intelligence artificielle pour apprendre et s'améliorer au fil du temps, en fonction des interactions qu'ils ont avec les utilisateurs.

4. Disponibilité : les chatbots sont disponibles 24h/24 et 7j/7, ce qui signifie qu'ils peuvent fournir de l'aide à tout moment.

En résumé, un chatbot est comme un assistant virtuel qui peut discuter avec vous et vous aider avec diverses tâches, en utilisant des technologies pour comprendre et répondre à vos messages.

Groupe IA SFMV

The Paradox of Medical AI Implementation

From Missed Opportunities to Missing Evidence

ERIC TOPOL

MAY 3 2026 , in :

https://erictopol.substack.com/p/the-paradox-of-medical-ai-implementation?utm_campaign=email-half-post&r=24vxe5&utm_source=substack&utm_medium=email

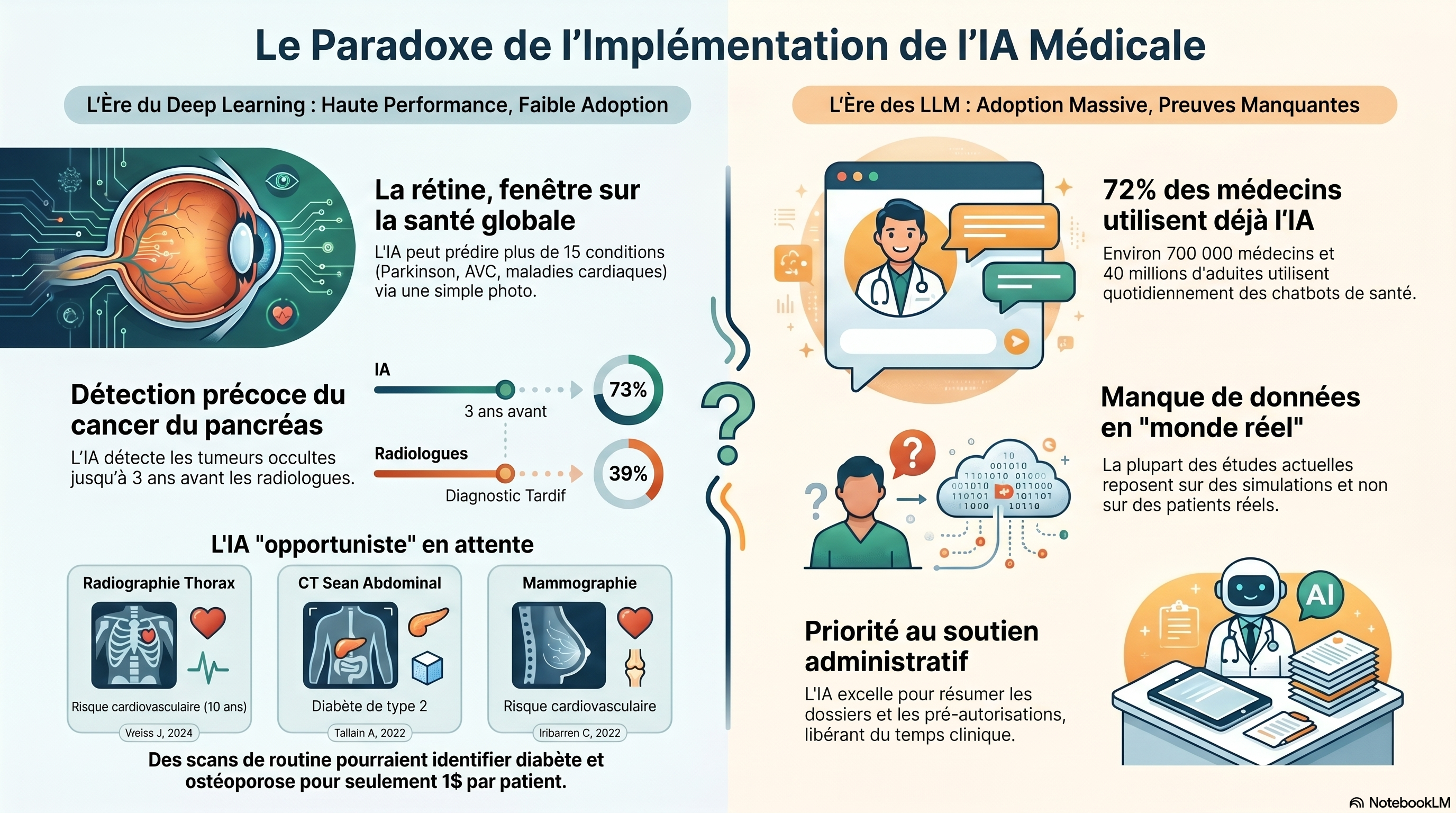

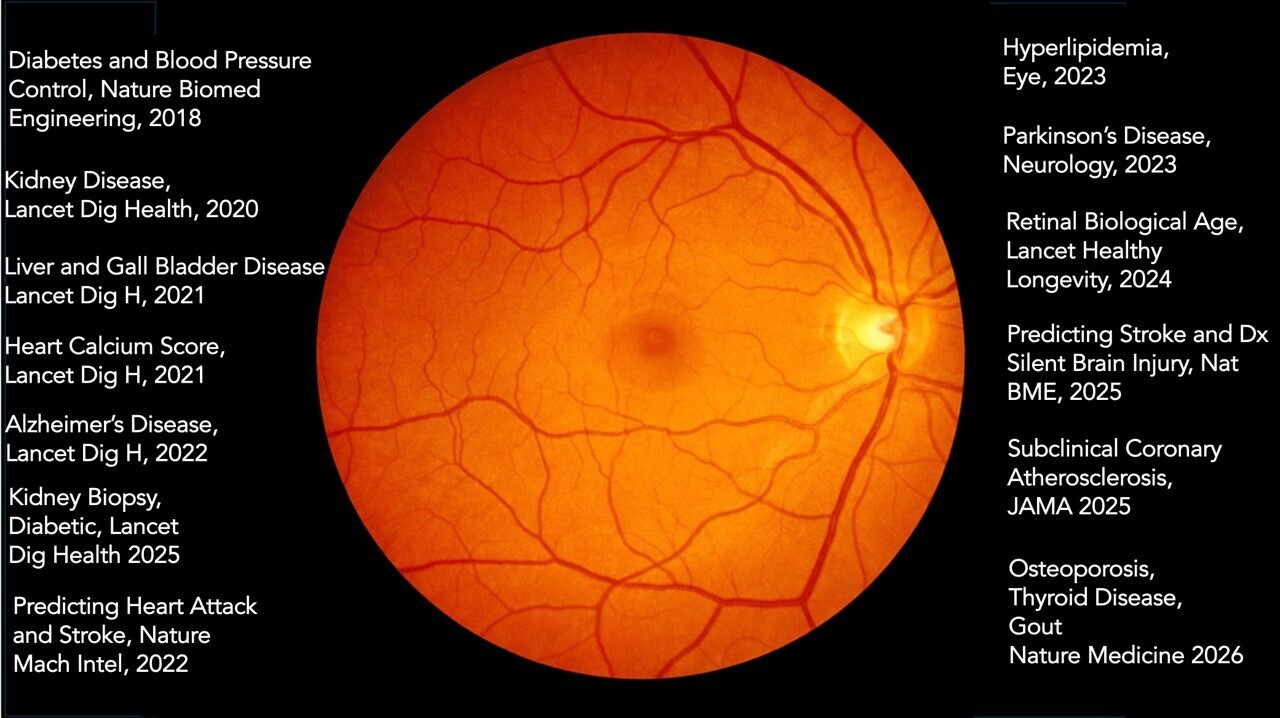

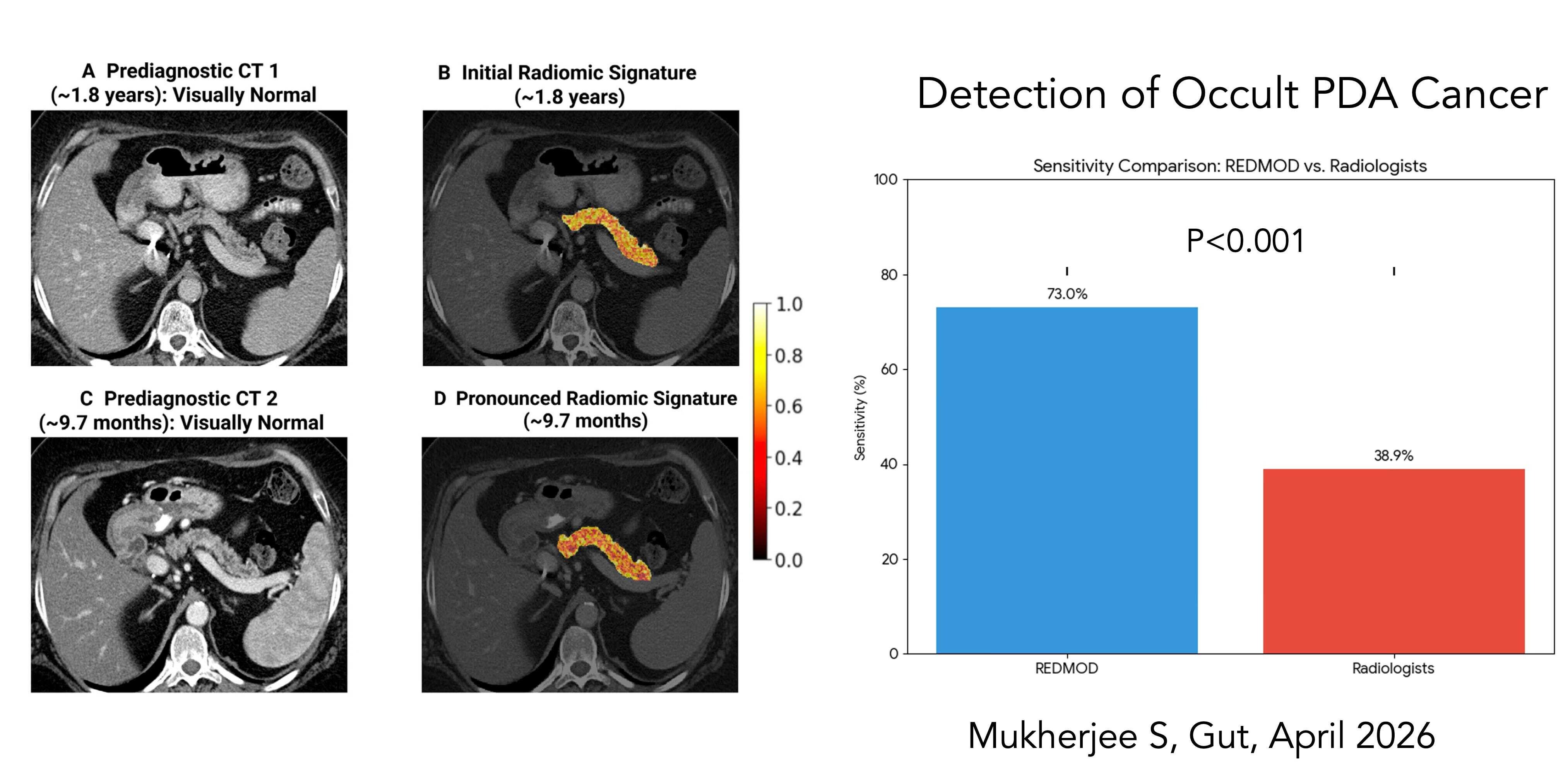

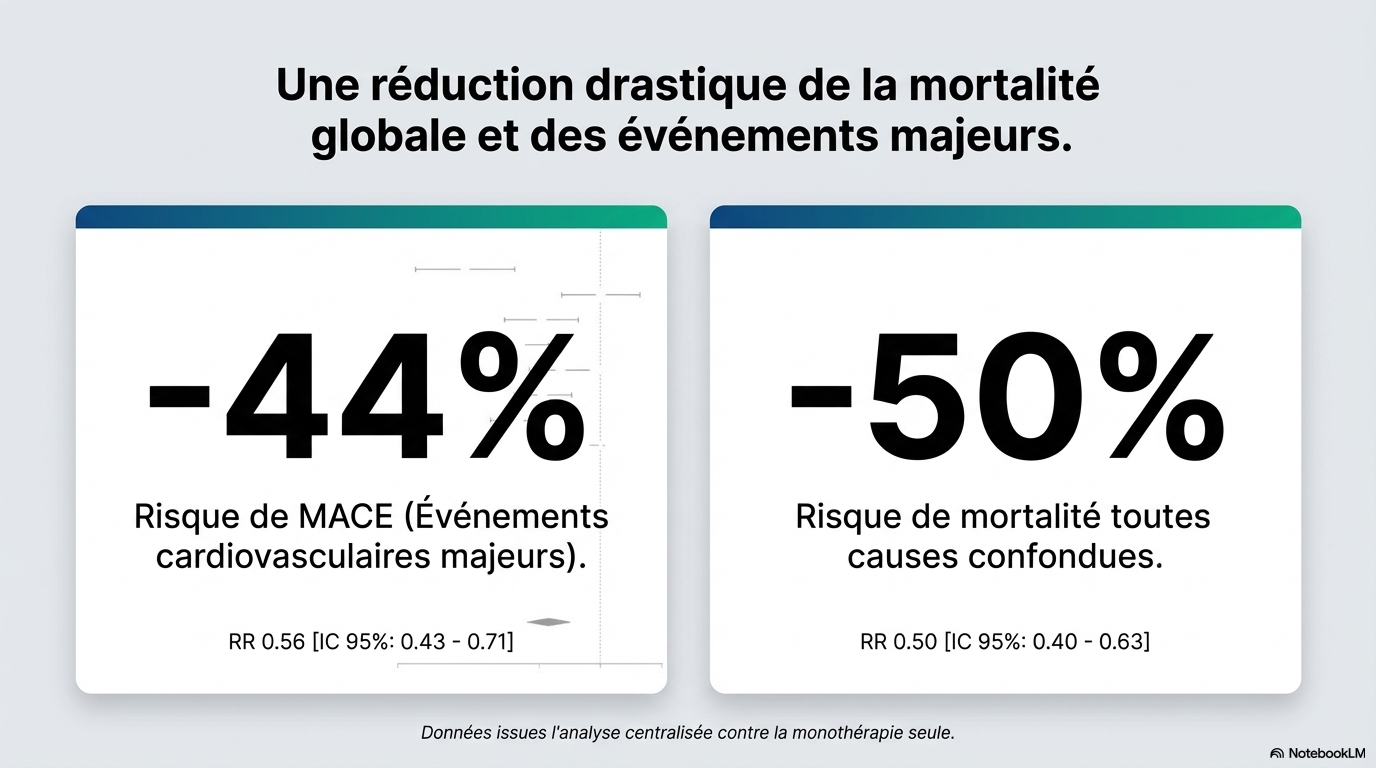

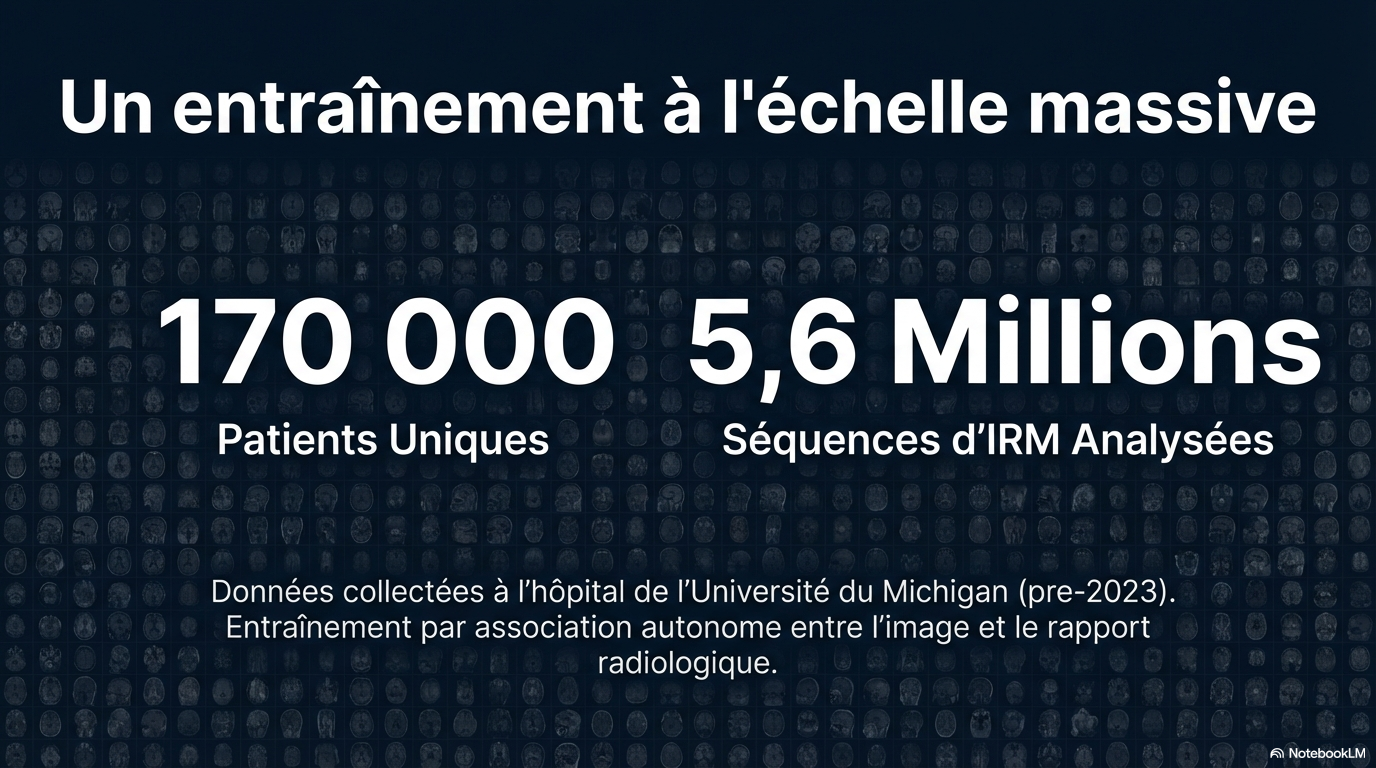

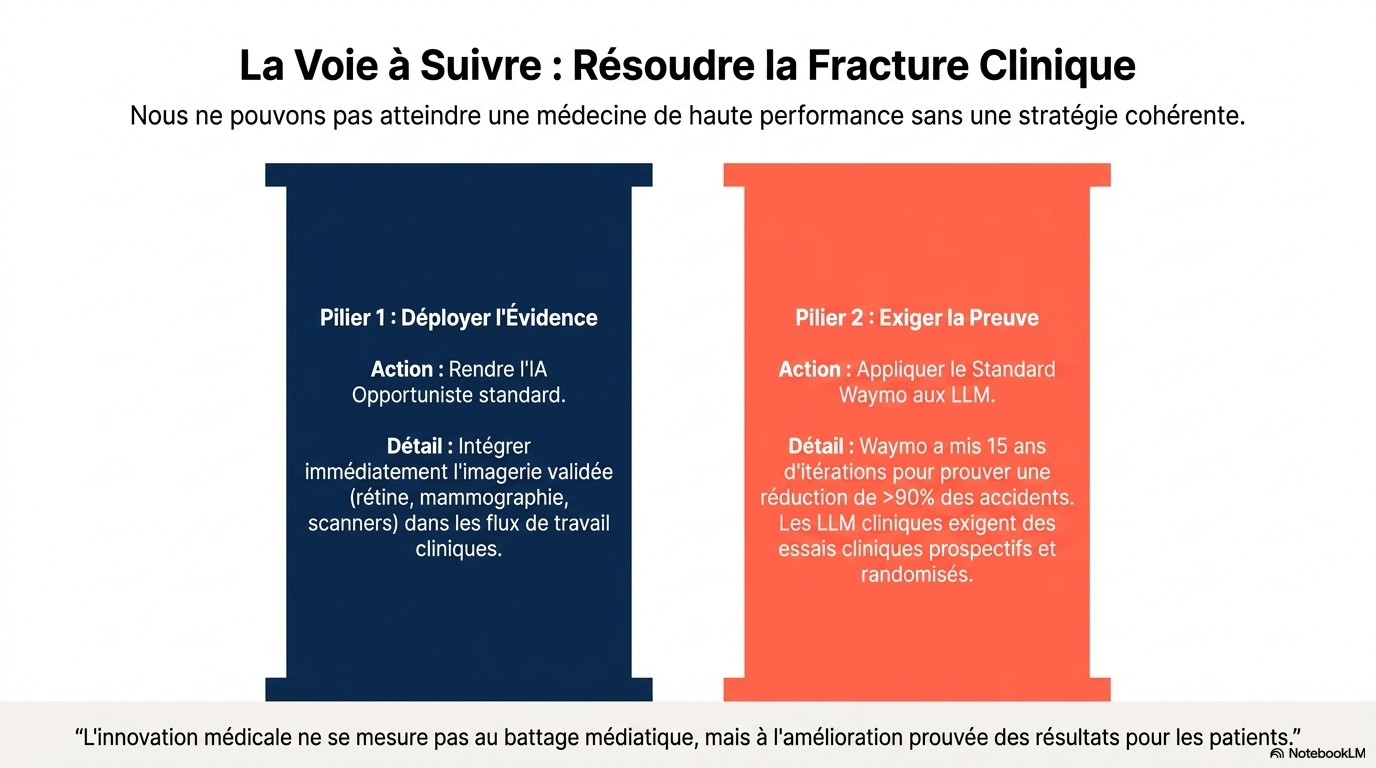

Cet article d'Eric Topol explore une contradiction majeure dans le domaine de la santé numérique : alors que des outils d'IA établis sur l'imagerie médicale possèdent des preuves scientifiques solides et une précision "surhumaine", ils restent largement sous-utilisés dans la pratique clinique courante. À l'inverse, les modèles de langage (LLM) et les agents conversationnels connaissent une adoption massive et rapide par les médecins et les patients, malgré une absence flagrante de données probantes quant à leur efficacité réelle sur les résultats de santé. L'auteur souligne que nous négligeons des opportunités de diagnostic vitales, comme le dépistage précoce via l'imagerie rétinienne, tout en nous précipitant vers des technologies génératives qui nécessitent encore des essais cliniques rigoureux. En fin de compte, Topol appelle à une harmonisation des pratiques pour atteindre une médecine de haute performance, en validant scientifiquement les nouveaux outils tout en implémentant enfin ceux qui ont déjà fait leurs preuves.

EXTRAITS

EXTRAITS

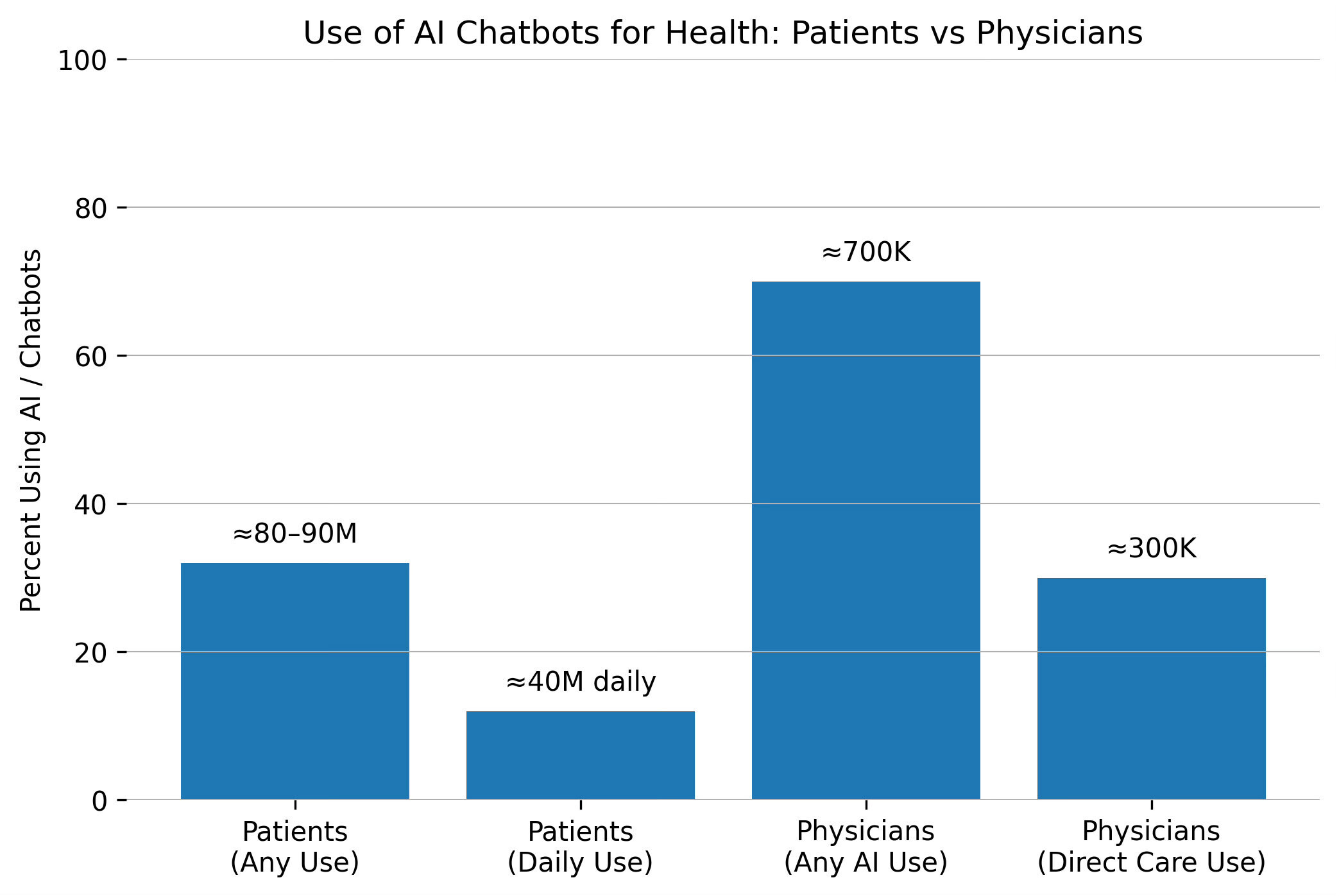

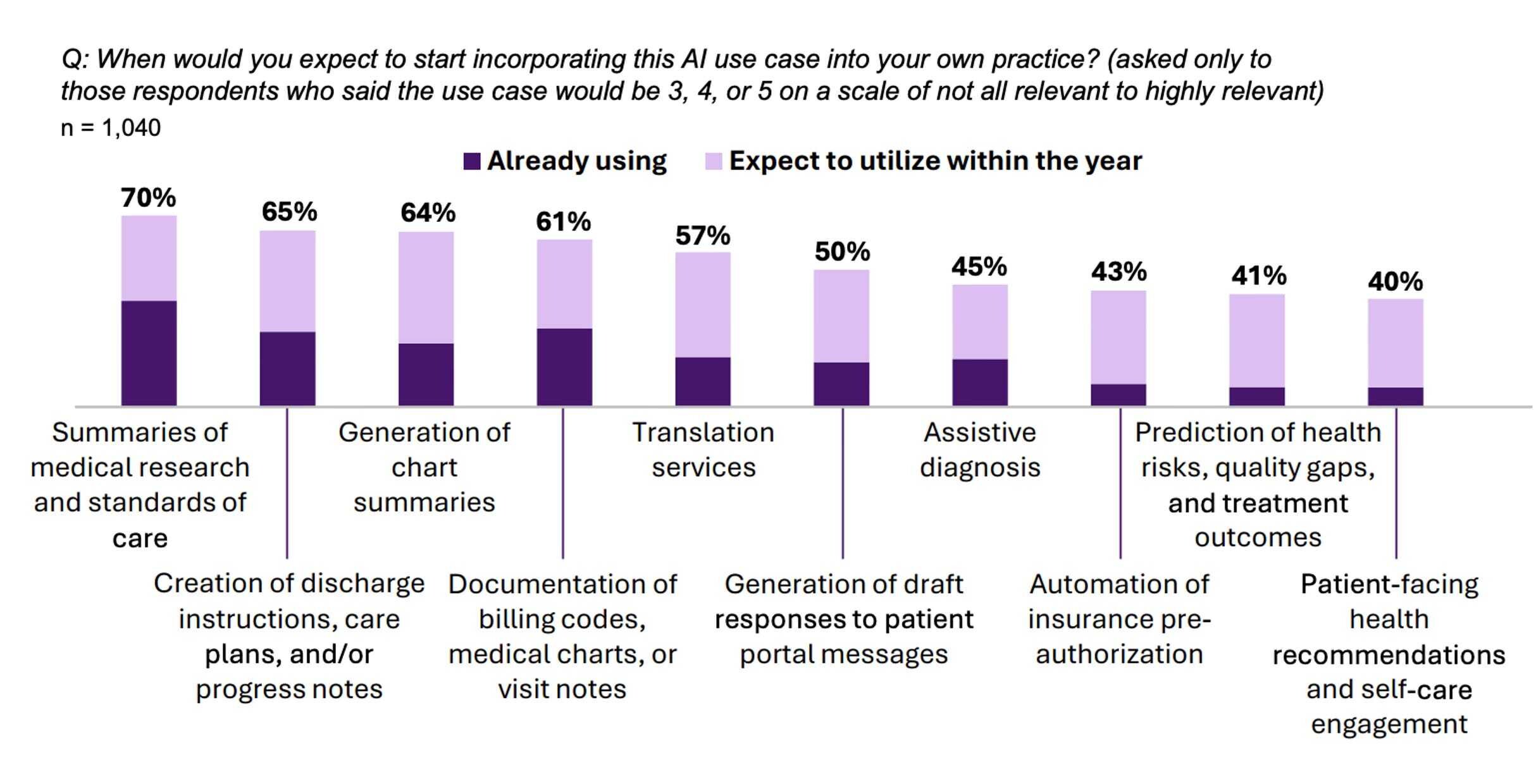

Le graphique suivant indique l'utilisation prévue par les médecins (d'après l'enquête de l'AMA) d'ici fin 2026. On constate que les prévisions sont très différentes de l'utilisation actuelle ! Notez le plan concernant l'aide au diagnostic.

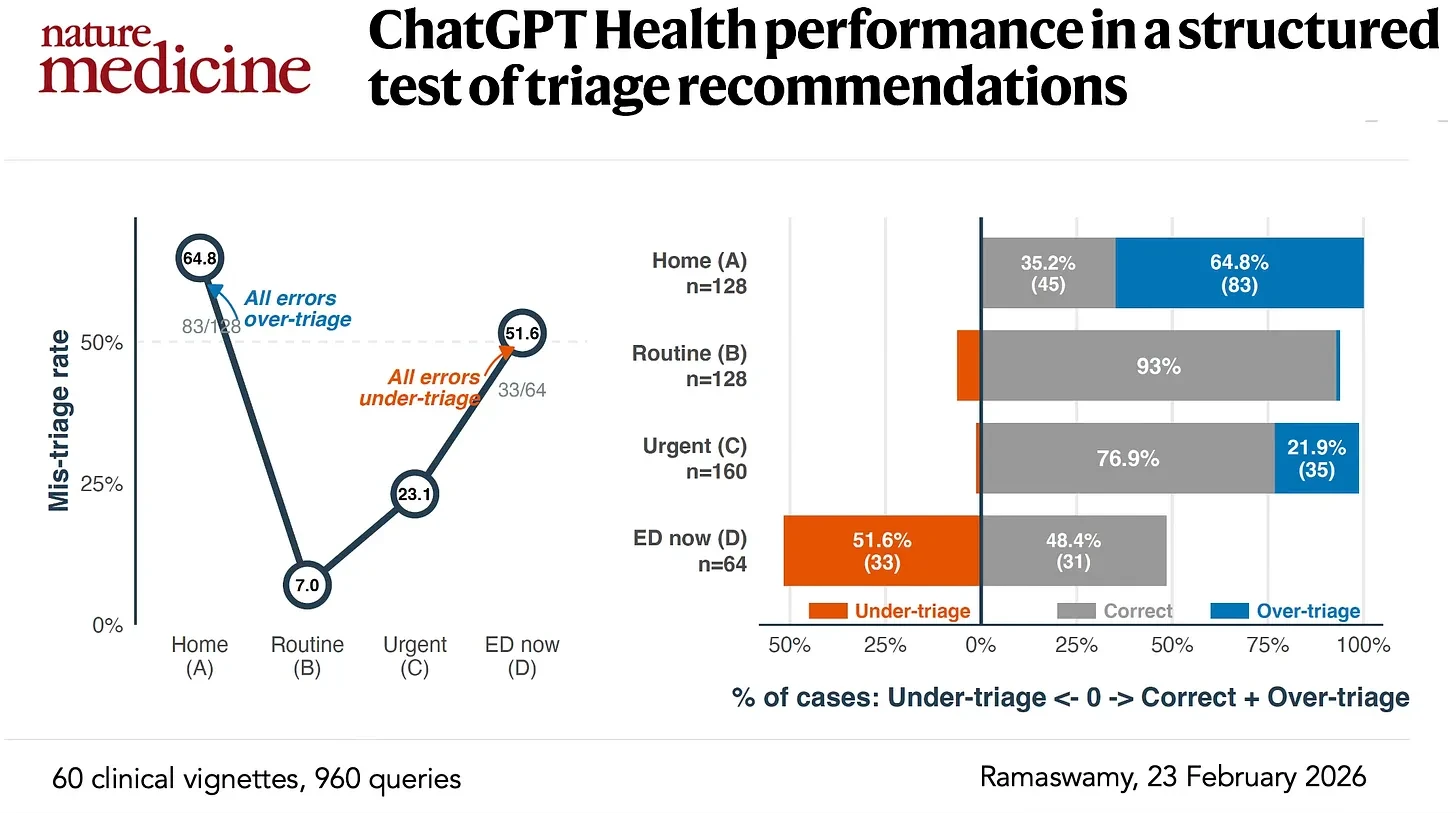

Concernant l'aide à la décision basée sur l'IA, comme l'établissement d'un diagnostic ou la prise en charge optimale des patients par les cliniciens, quelles sont les preuves ? Nous manquons cruellement de données issues du monde réel . Cette semaine, dans Science Magazine , six expériences évaluant deux modèles de langage (o1 d'OpenAI et ChatGPT-4) et des médecins sur des cas cliniques ont mis en évidence le potentiel d'un raisonnement amélioré. De plus, dans une simulation de décisions prises aux urgences à trois moments clés (graphique ci-dessous), comparée à celle de deux médecins, o1 a permis d'obtenir de meilleures décisions de triage initial. La plupart des nombreuses publications utilisent des études de cas, des simulations et des acteurs comme patients, ce qui est loin de refléter la complexité de la pratique médicale.

Dans un essai randomisé de LLM comparant des patients assistés par des LLM pour 10 scénarios médicaux (non réels) , les patients n'ont pas obtenu de bons résultats (Figure) et la conclusion était : « Nous recommandons des tests systématiques auprès d'utilisateurs humains pour évaluer les capacités interactives avant les déploiements publics dans le domaine de la santé. »

DIAPORAMA NOTEBOOK

Le DEEP LEARNING face au LLM ; tel est le sujet de l'article d'Eric TOPOL. Plus simplement il faut faire la part des choses entre ce qui est validé et ce qui ne l'est pas en médecine. C'est une querelle médicale qui existe depuis des siècles, chaque fois que de nouvelles techniques arrivent. De plus il y a toujours les "POUR" et les "CONTRE", et en plus souvent ceux qui sont pour ne savent pas pourquoi, idem pour les contre. Il faut donc toujours en médecine intégrer dans la pratique ce qui est validé et valider ce qui ne l'est pas encore, quelle que soit la technique en cause... si "miraculeuse" soit-elle. En médecine, on veut toujours plus et plus encore, on franchit la ligne jaune à tort La médecine est une science et non un "jeu vidéo", nous sommes dans la réalité et non dans la fiction ni dans la science-fiction. Parce que l'IA est à l'origine des chatbots,les patients s'imaginent qu'ils vont se passer de médecin, d'autant plus qu'il en manque ...cherchez l'erreur !

À LIRE