https://www.nature.com/articles/s44360-026-00116-y

En libre accès

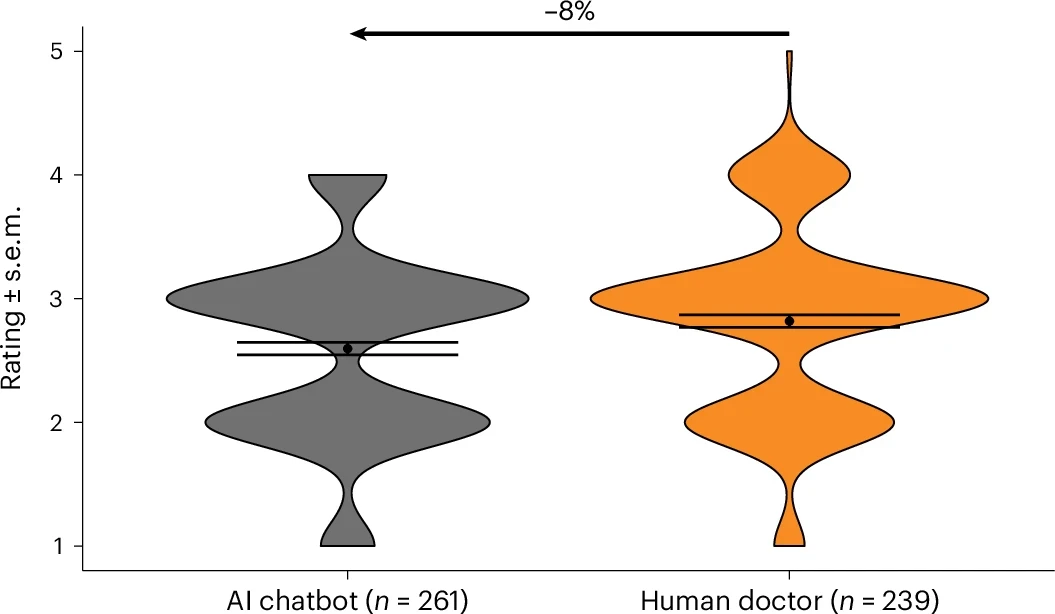

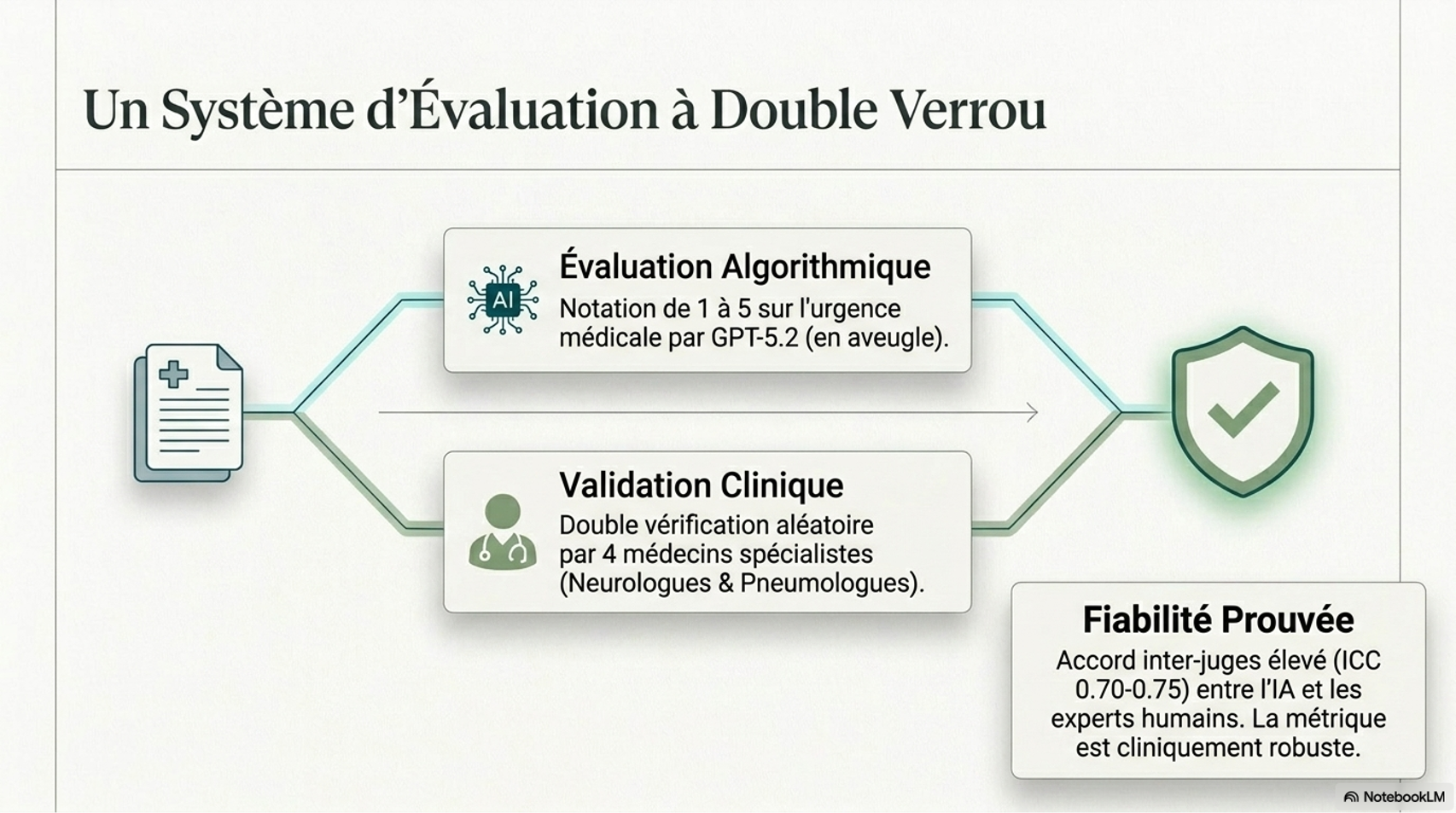

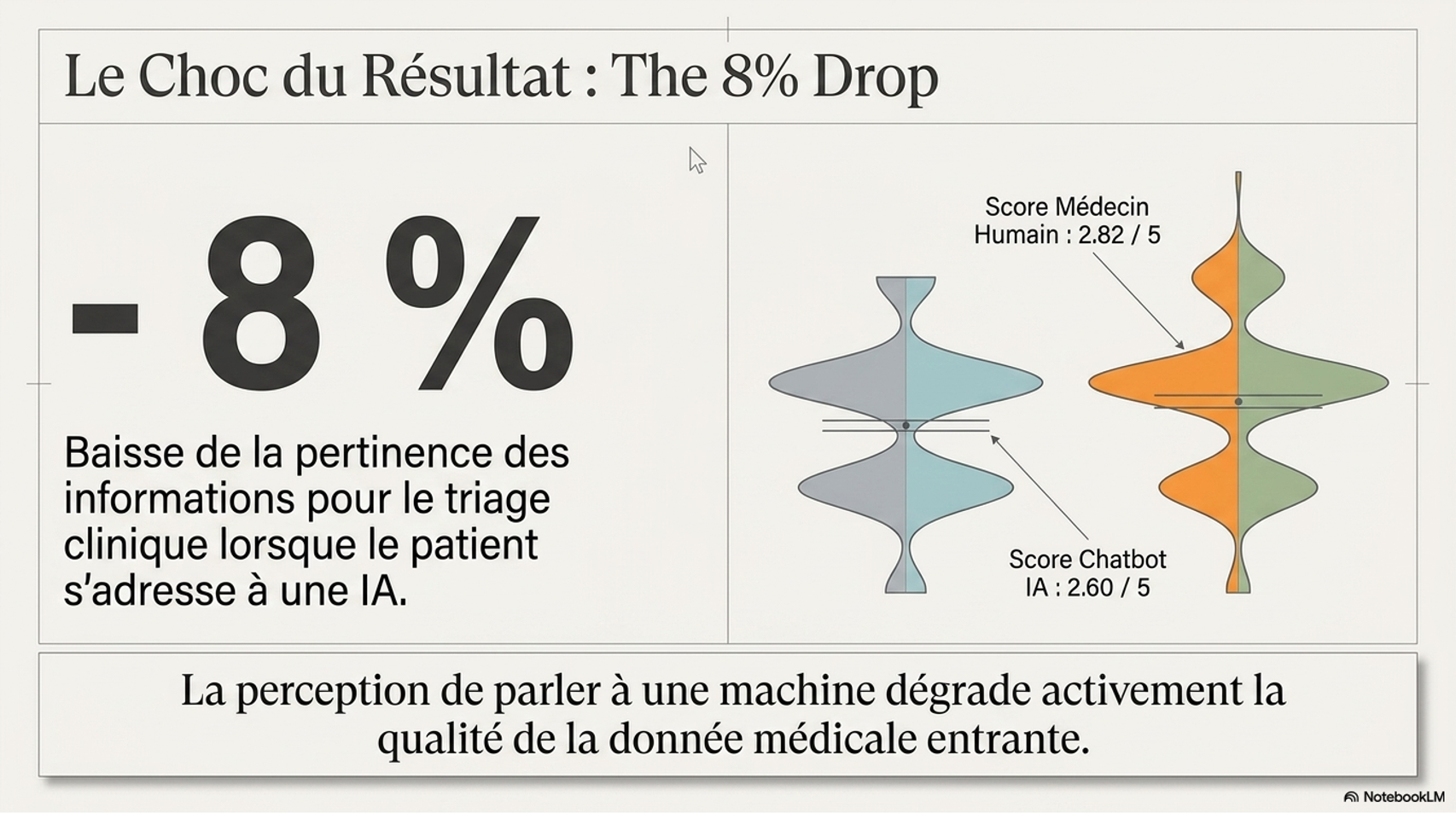

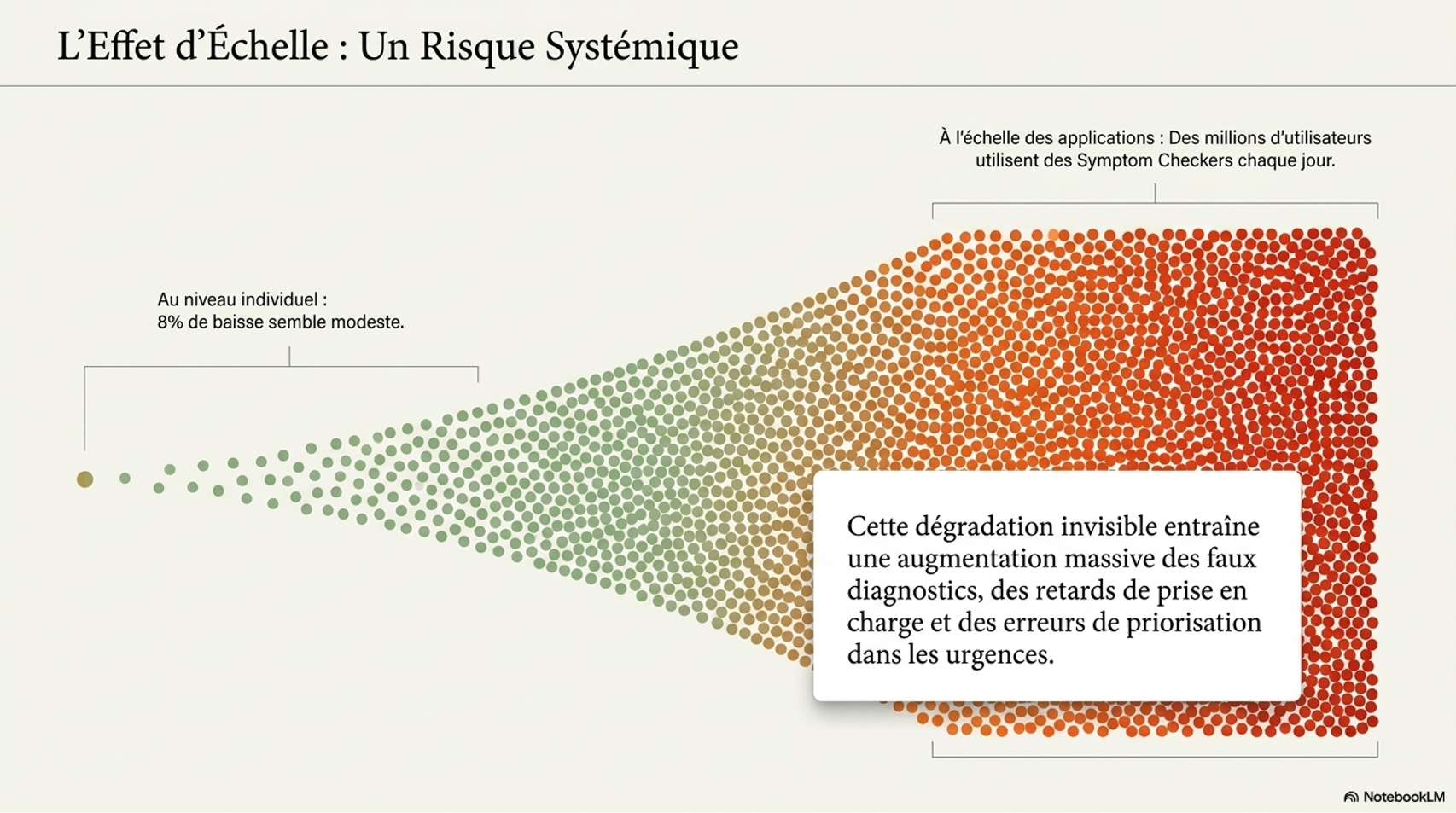

Dans le groupe IA (moyenne = 2,60, erreur standard = 0,04), les descriptions de symptômes étaient 8 % moins pertinentes pour une évaluation initiale de l'urgence médicale que dans le groupe médecin (moyenne = 2,82, erreur standard = 0,04 ; évaluation par GPT-5.2). Nous avons calculé un modèle linéaire mixte pour tester les différences entre les deux groupes. Les barres d'erreur représentent les erreurs standard des moyennes individuelles.

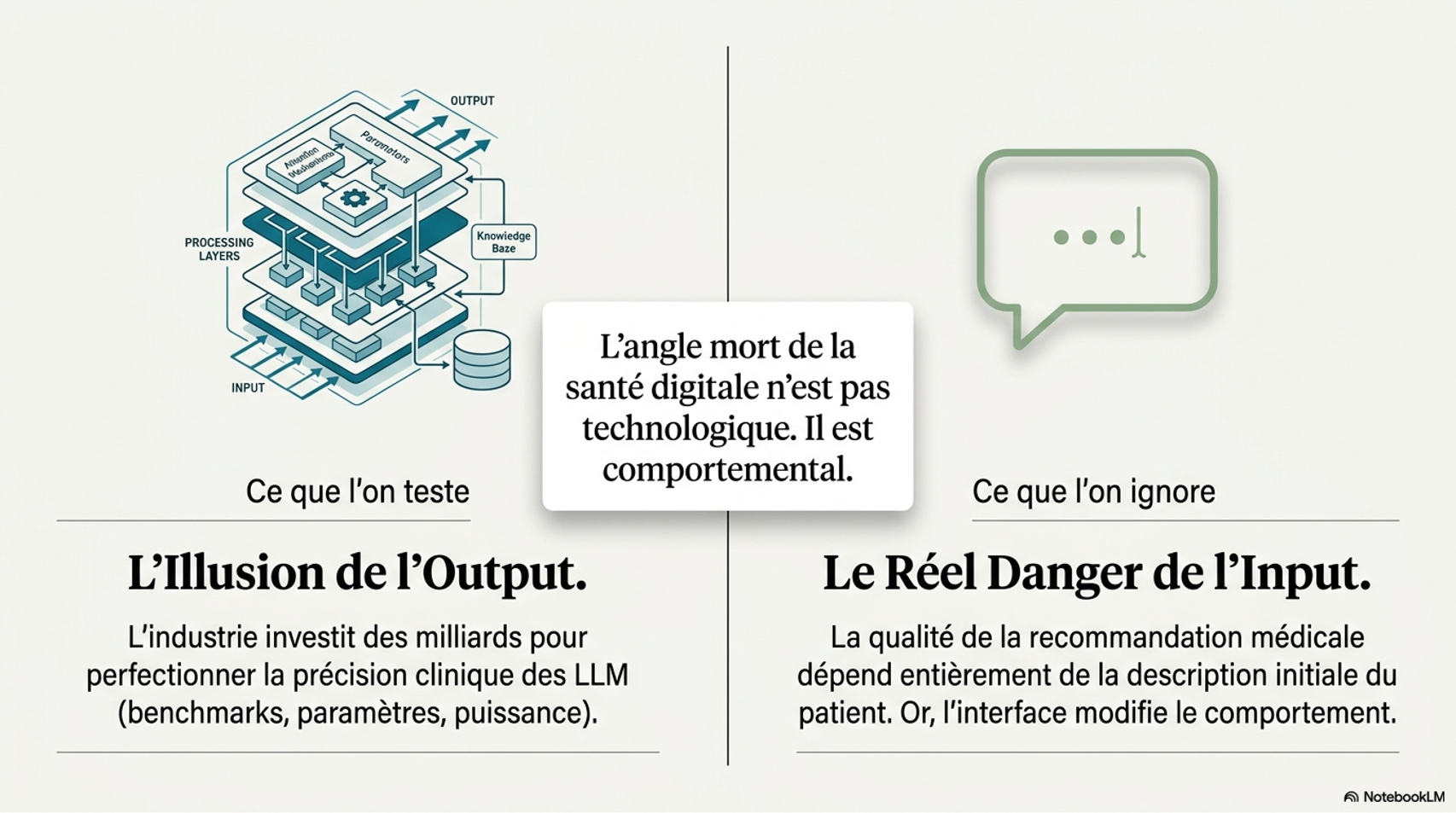

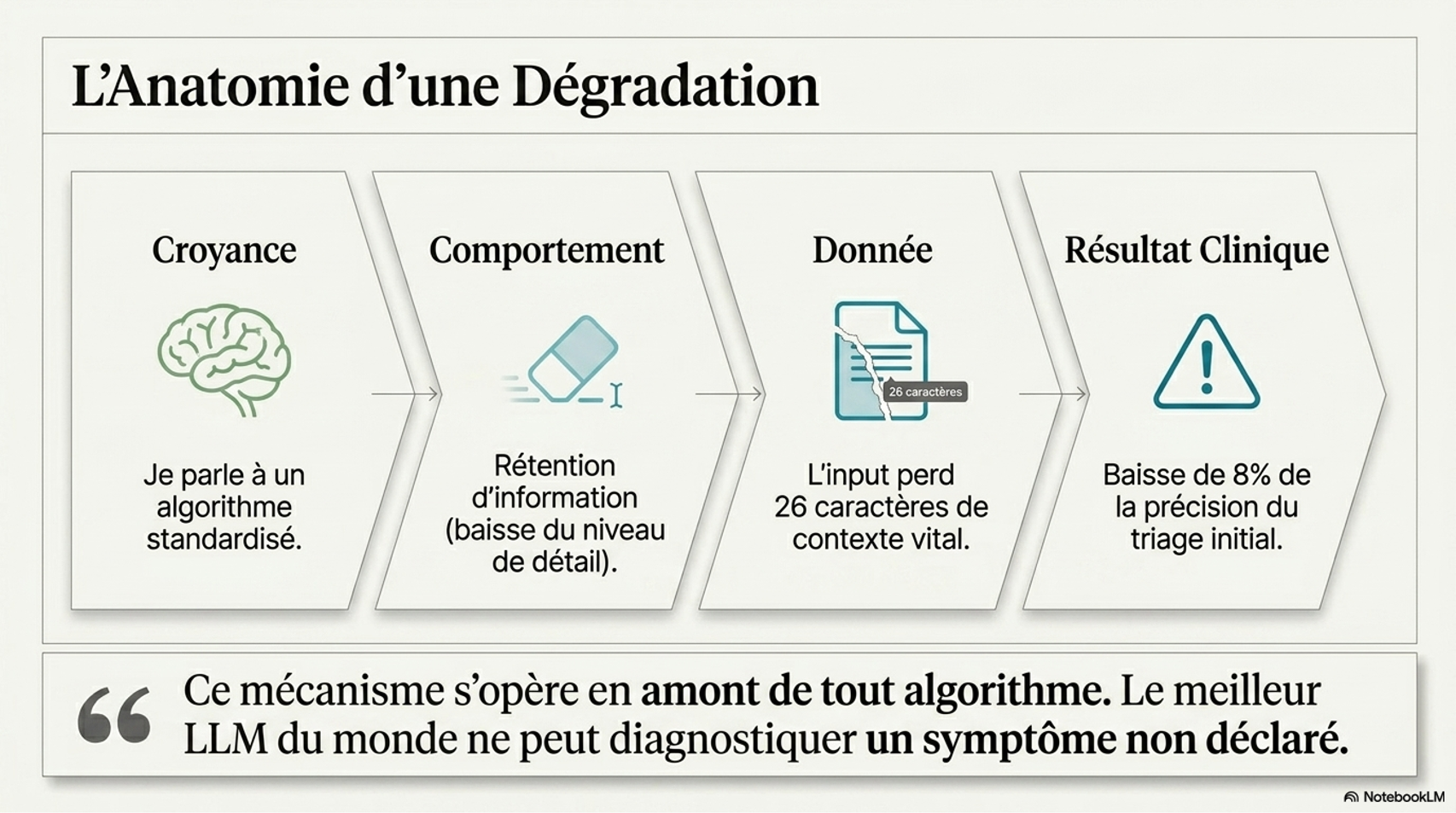

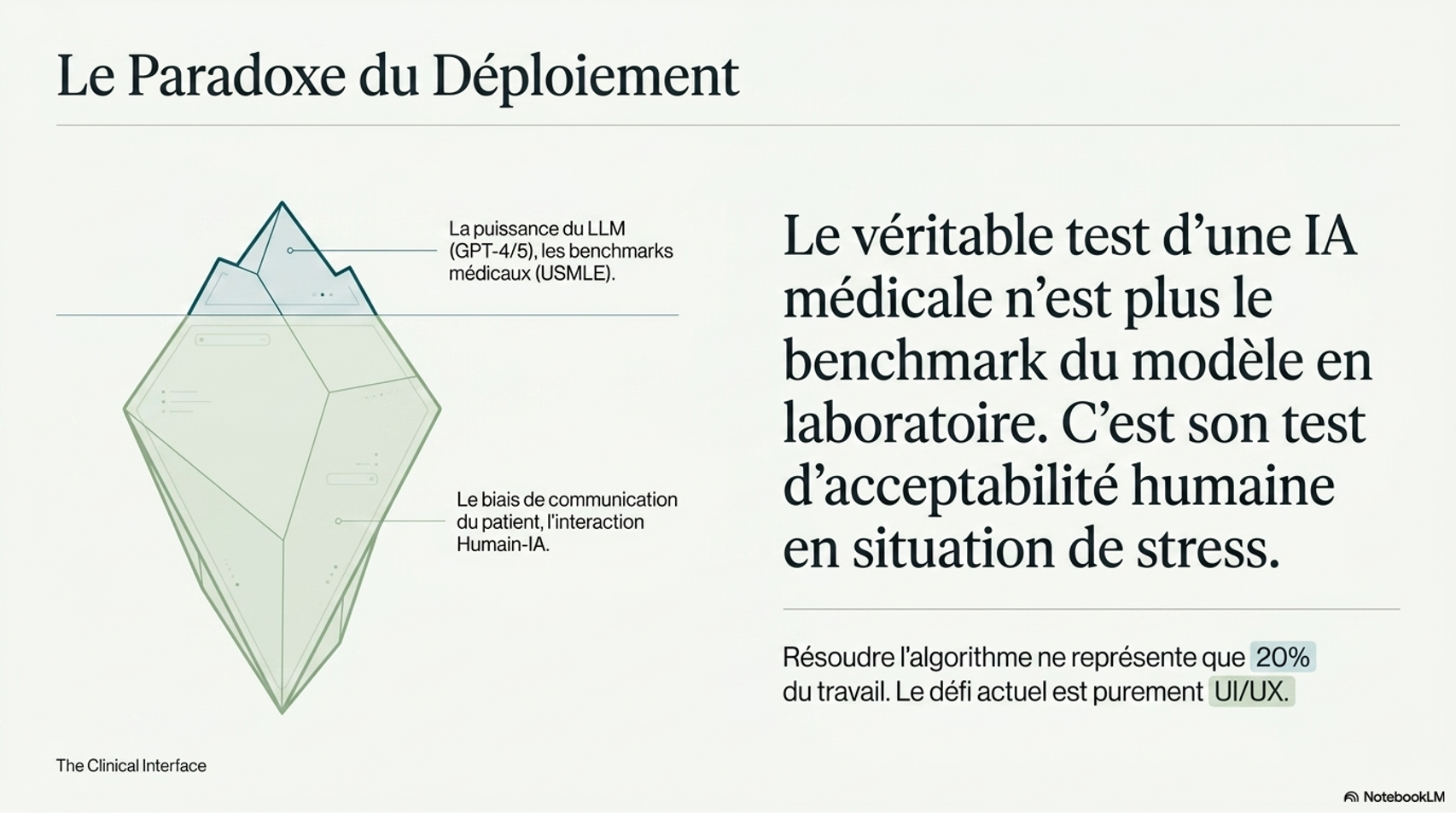

Globalement, cette étude met en lumière de nouveaux obstacles à l'adoption de l'IA dans le domaine de la santé. Conformément à des résultats récents⁵, les problèmes techniques ne constituent pas le principal défi pour le déploiement concret de l'IA médicale. Le principal obstacle réside plutôt dans l'interaction entre les humains et ces outils.

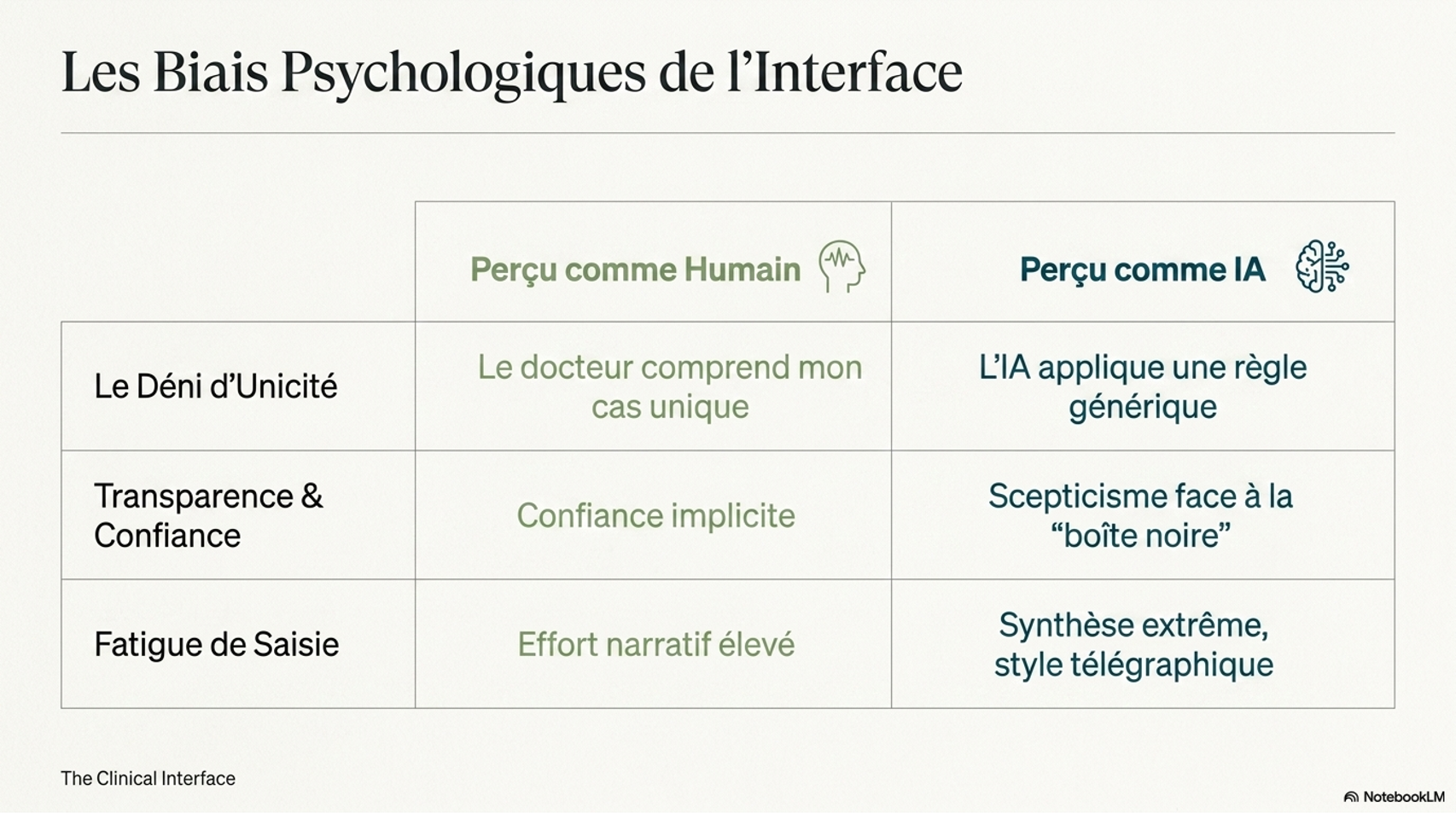

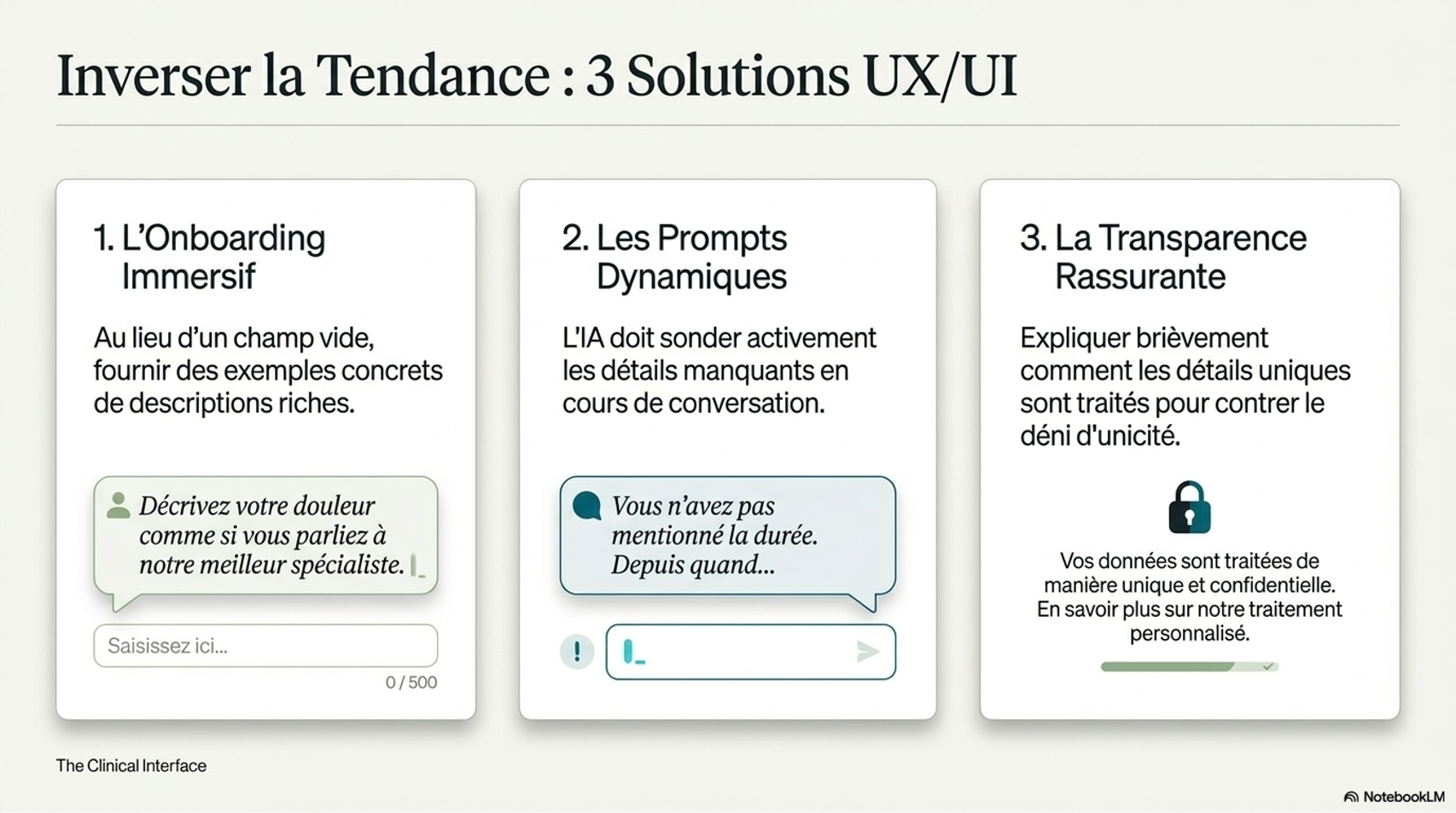

Afin de faciliter une intégration efficace de l'IA, les recherches futures devraient approfondir l'interaction homme-IA dans ce contexte. Par exemple, la présentation du système d'IA (par exemple, son degré de réalisme humainou sa capacité (supposée) à considérer les caractéristiques uniques de l'utilisateur) ou les explications relatives aux processus décisionnels de l'IA pourraient atténuer cet effet. Enfin, des données récentes indiquent que le scepticisme du public envers l'IA médicale s'étend au-delà de la technologie elle-même , jusqu'aux médecins qui utilisent des outils d'IA³. Les recherches futures devraient donc examiner si les patients fournissent des descriptions moins précises de leurs symptômes lorsqu'ils consultent un médecin, s'ils soupçonnent ce dernier de recourir à l'IA.

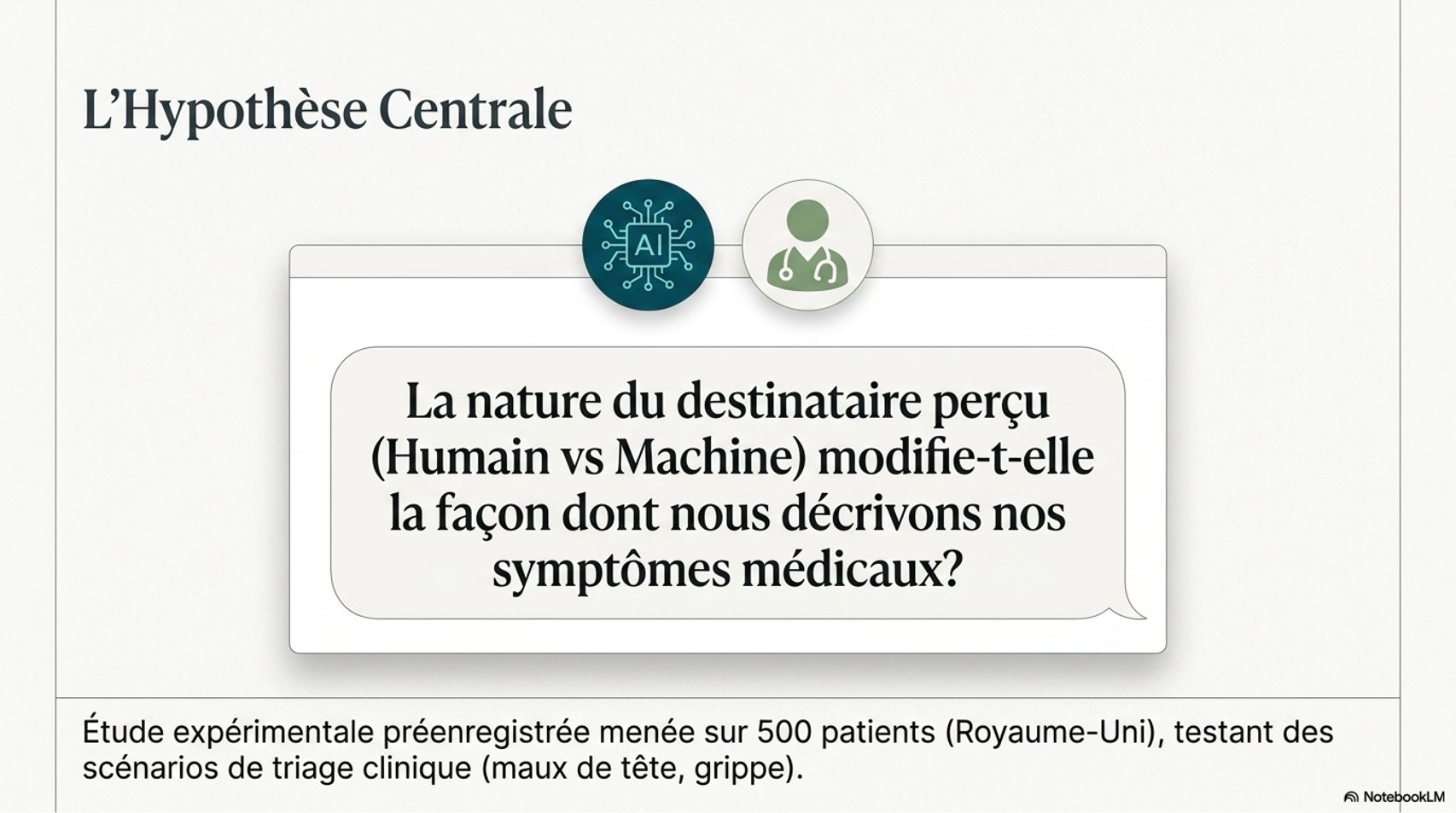

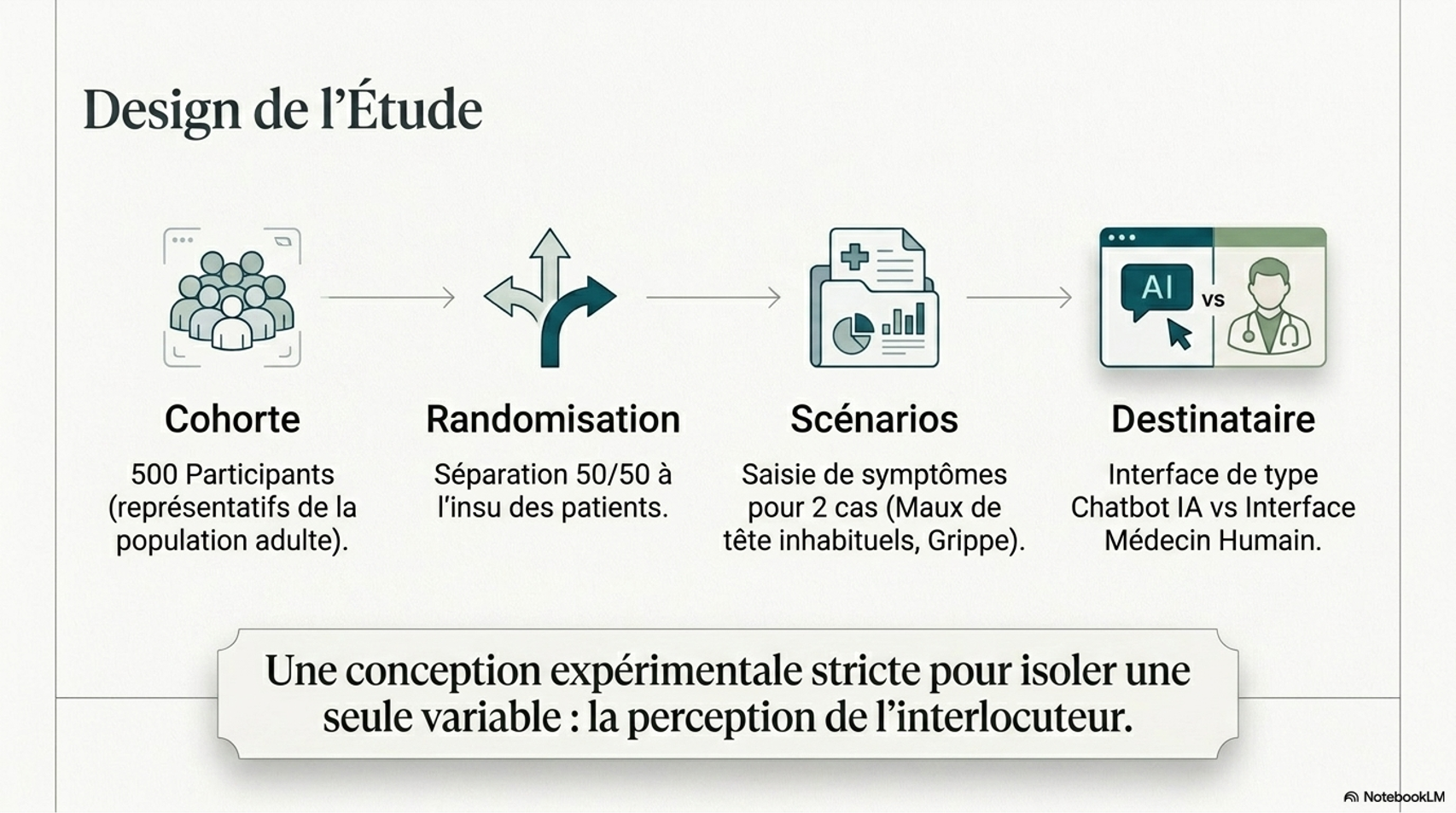

Concernant la validité externe de nos résultats, il convient de noter que nous avons utilisé des scénarios hypothétiques avec des affections médicales spécifiques pour tous les participants. Ce choix méthodologique nous a permis de mener une étude rigoureusement contrôlée sur cette question de recherche inédite. Afin de renforcer la pertinence de nos résultats pour la pratique clinique, nous avons explicitement sélectionné des affections courantes et facilement identifiables, pour lesquelles une consultation médicale auprès de médecins spécialistes est probable. De plus, nous avons invité les participants à une étude de suivi afin d'analyser l'influence de leur expérience antérieure des affections présentées sur nos résultats. Il est important de souligner que nos résultats sont restés robustes même en incluant uniquement les participants ayant déclaré avoir ressenti les symptômes en question au moment de leur participation à l'étude . Par ailleurs, les témoignages de patients en situation réelle peuvent différer à plusieurs égards des descriptions de symptômes simulées (par exemple, en termes de charge émotionnelle et d'exhaustivité des informations). Ainsi, une étape cruciale pour les recherches futures consiste à déterminer si l'effet observé se généralise aux situations cliniques réelles, où la charge émotionnelle et les enjeux sont différents.

SYNTHESE NOTEBOOKLM

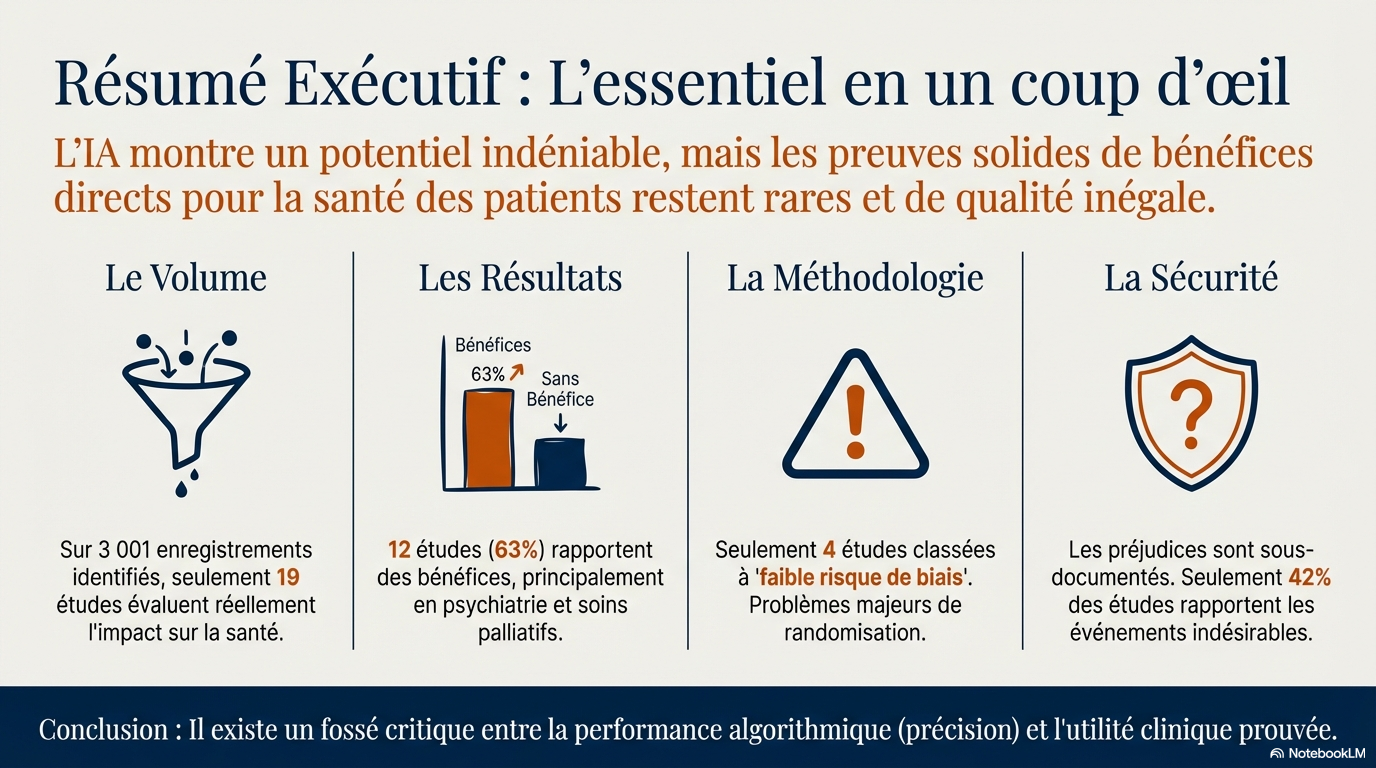

Cette étude scientifique explore comment la perception du destinataire influence la manière dont les patients décrivent leurs problèmes de santé. Les chercheurs démontrent que les individus fournissent des comptes rendus de symptômes moins détaillés et de moindre qualité lorsqu'ils pensent s'adresser à un agent conversationnel d'intelligence artificielle plutôt qu'à un médecin humain. Ce phénomène de dégradation de l'information à la source est préoccupant, car il peut fausser les recommandations médicales et le triage, même si l'algorithme sous-jacent est techniquement performant. En fin de compte, l'article souligne que le succès de l'IA en santé dépendra moins de ses capacités techniques que de l'amélioration de l'interaction humain-machine pour encourager une communication patient plus riche.

Commentaire

La VRAIE VIE nous montre , nous médecins, qui il est souvent difficile de comprendre les symptômes décrits par un patient. Quelquefois c'est instantané et quelque fois l'histoire médicale du patient doit être reprise à son début. De plus, en médecine, la vraie vie dépasse souvent la fiction, ce qui ne doit pas nous étonner. Les sollicitations des patients auprès de ChatGPT ou vers une autre IA sont le plus souvent incomplètes avec une chronologie des faits "ubuesque". Le patient a une représentation de son hypothétique affection loin du réel. Pour d'autres, ils se perdent dans les détails et n'arrivent pas à être concis. La force du médecin, c'est qu'il a en face de lui un patient "en vrai" . Au premier regard, on sait tout de suite comment il faut aborder le patient, on connait les bonnes questions et celles qu'il ne faut pas poser tout de suite Notre perception résulte de l'expérience, qui constitue la base de l'intuition. ChatGPT a-t-il une telle expérience ? A-t-elle des intuitions, etc. ? C'est toute la différence entre un être humain et un outil. Le travail du médecin est très différent d'un patient à l'autre, chaque individu est unique. Notre approche n'est jamais univoque. Il y a du Sherlock Holmes chez tous les médecins. Il faut donc rechercher les indices pertinents et ceux qui ne cadrent pas avec l'histoire du patient. Certains exagèrent leur symptomatologie, d'autres les minimisent. Quand le couple est présent et que l'un des deux est malade, on assiste souvent à la modération de celle ou de celui qui n'est pas malade ou alors accable l'autre. ou alors nous apporte la vérité. Alors "ChatBoter " sur une supposée maladie ne donne pas souvent la clé de la maladie . Nous devons, nous, médecins, faire la part des choses, la part de l'utile et de l'inutile, être attentifs à la gestuelle du patient,à des mimiques,à son odeur, etc. Il s'agit toujours d'une véritable enquête policière. Cependant, elle doit se faire dans le respect du patient, avec un dialogue adapté à ses besoins, ainsi qu'une écoute attentive et un partage des mots pour exprimer les maux. Il faut être capable de comprendre rapidement " à qui on a affaire", ce qui permet d'adapter notre discours. Avec l'expérience, on comprend rapidement celui ou celle qui souffre, sa détresse, son stress et "mille petits indices" qui, rassemblés, nous amènent au diagnostic. Lorsque le diagnostic est posé, il faut expliquer au patient ce qui lui arrive, quels examens seront nécessaires ou pas, expliquer le traitement et non rester mystérieux ou inaudible. On doit toujours rester explicite, on doit utiliser un vocabulaire adapté au patient, on doit prendre des décisions expliquées et surtout ne pas "tomber" dans l'inertie médicale. Ainsi, tout ce que vous venez de lire justifie largement l'importance de l'humain, car un outil ne peut en aucun cas intégrer tous ces éléments. De plus, l'outil peut vous embarquer vers un diagnostic erroné, voire dangereux, qui va mettre à mal le patient. L'utilisation de l'IA découlera des données des la consultation médicale initiale , si nécessaire. Notamment le grand apport de l'IA réside dans la médecine personnalisée et prédictive. Mais "au commencement" il y a le colloque singulier selon Hippocrate.

Une citation à retenir qui résume la consultation médicale : "Lorsque vous avez éliminé l’impossible, ce qui reste, si improbable soit-il, est nécessairement la vérité." Arthur Conan Doyle