L'IA grand public médical doit faire ses preuves.

" L'intelligence artificielle est notre alchimie, notre pierre philosophale : nous faisons littéralement réfléchir le sable." Marc Andreessen, créateur de Mosaic, fondateur de Netscape

Démontrez la valeur de l'IA médicale. Nat Med 32 , 1163 (2026).

https://doi.org/10.1038/s41591-026-04389-4

Les affirmations selon lesquelles l'IA médicale améliore les soins doivent être étayées par des preuves appropriées.

L’adoption des outils d’intelligence artificielle (IA) s’accélère rapidement à tous les niveaux des systèmes de santé. Les modèles prédictifs, les outils d’aide à la décision et les outils génératifs sont désormais utilisés en milieu clinique. ¹ , et le grand public a de plus en plus recours aux grands modèles de langage pour obtenir des informations et des conseils médicaux

Cependant, les preuves de la valeur ajoutée des outils d’IA pour les patients, les professionnels de santé ou les systèmes de santé restent encore rares.

Néanmoins, dans les publications et les documents relatifs aux produits, les allégations concernant l'impact clinique sont de plus en plus fréquentes, malgré l'absence de consensus sur le niveau de preuve requis pour les considérer comme crédibles.

Il en résulte non seulement une incertitude scientifique, mais aussi souvent une mise en œuvre et une adoption prématurées.

Si l'IA doit améliorer significativement les soins, il est impératif que le domaine établisse un lien systématique et cohérent entre les allégations d'impact et des preuves appropriées et proportionnées. Un cadre d'évaluation des technologies médicales basées sur l'IA, définissant les indicateurs et les critères de référence, est donc nécessaire de toute urgence.

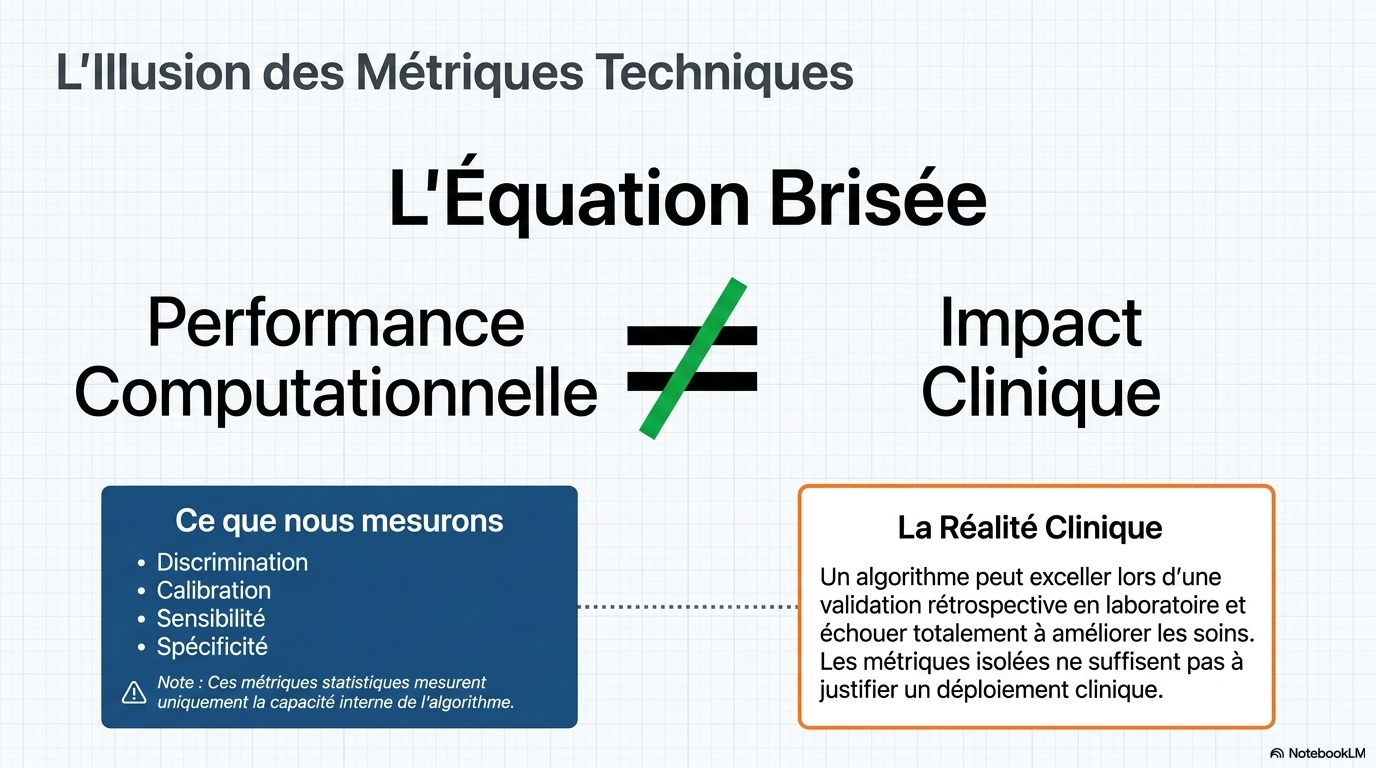

Les évaluations de l’IA médicale se sont jusqu’ici surtout basées sur des indicateurs statistiques, comme la discrimination, la calibration, la sensibilité ou encore la spécificité, qui mesurent les capacités de calcul et les performances d’un outil.

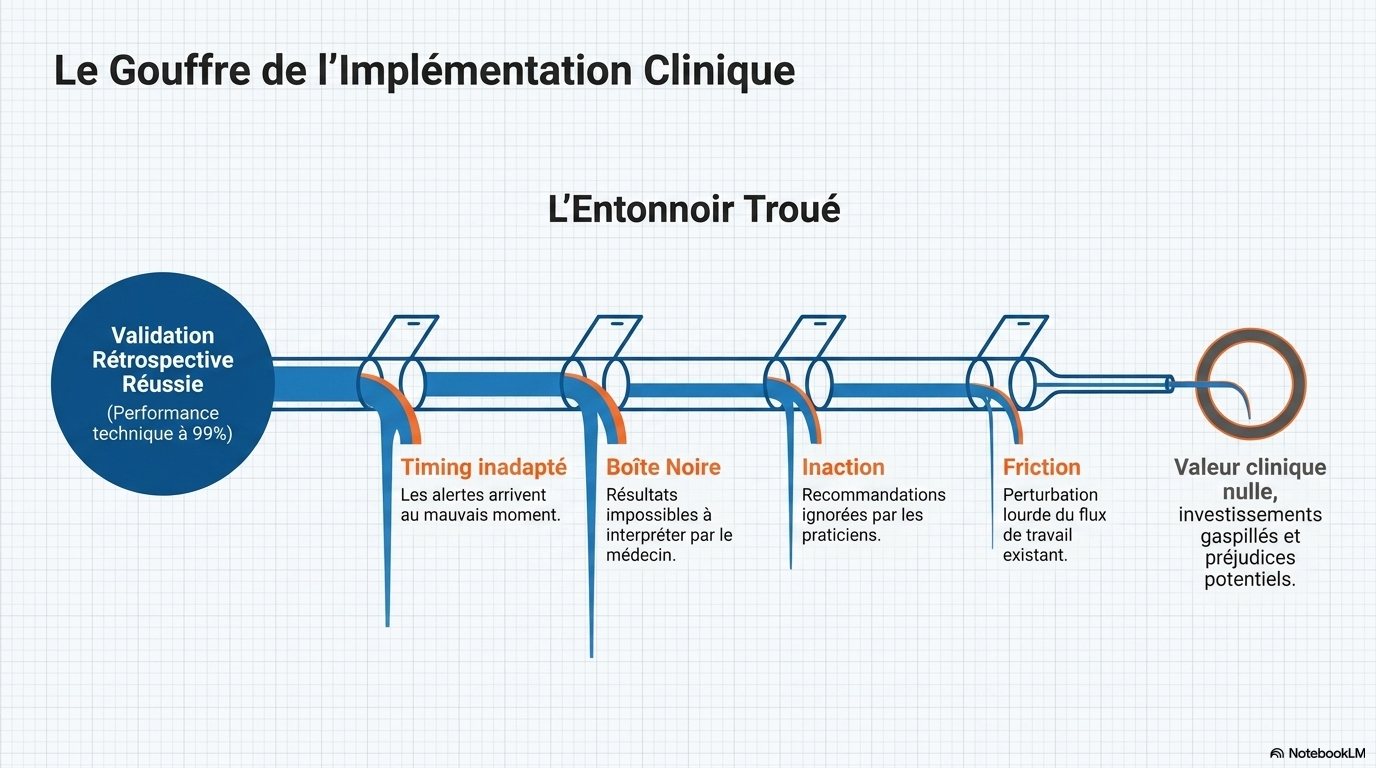

Bien que ces indicateurs soient importants, ils ne permettent pas, à eux seuls, d'établir un impact clinique. Un système peut obtenir d'excellents résultats lors d'une validation rétrospective sans pour autant améliorer les soins si ses résultats sont fournis au mauvais moment, difficiles à interpréter, appliqués de manière incohérente ou perturbent les flux de travail cliniques. Par conséquent, lorsque de tels outils sont adoptés sans mesures plus concrètes de leur impact clinique, les systèmes de santé et les utilisateurs risquent d'investir dans des produits. Leur valeur réelle demeure incertaine, voire néfaste, et leurs conséquences imprévues peuvent être considérables.

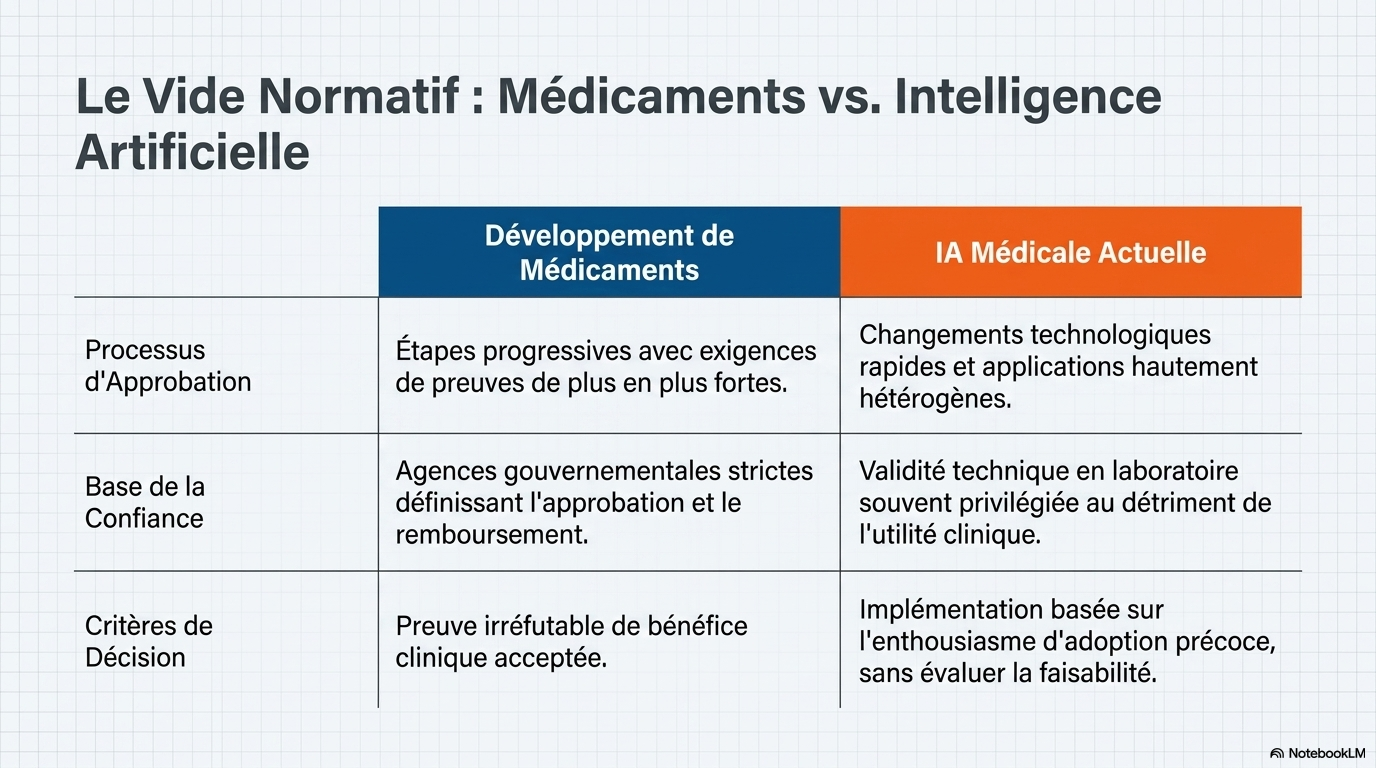

Dans l'histoire de la médecine, pour affirmer un impact clinique, il a fallu plus que de simples performances techniques. Ainsi, la mise au point d’un médicament requiert habituellement des preuves de plus en plus fortes avant que le bénéfice clinique ne soit reconnu, et les mécanismes de contrôle des agences gouvernementales aident à déterminer quand les preuves sont suffisantes pour une autorisation, une recommandation ou un remboursement. Pour de nombreuses raisons, notamment le rythme rapide des évolutions technologiques, l'hétérogénéité des applications et les différentes incitations à la production de preuves, le domaine de l'IA médicale n'a pas encore développé de normes comparables. Bien que les cadres réglementaires fassent l'objet de débats et d'évolutions constants, ils demeurent insuffisants.Les études publiées privilégient souvent la validité technique à l'utilité clinique. Les décisions de mise en œuvre sont fréquemment prises avant que les questions fondamentales d'applicabilité, de faisabilité, de sécurité et d'efficacité aient été suffisamment abordées .

En, l'absence de consensus sur les normes de preuve, ces décisions peuvent reposer davantage sur l'enthousiasme initial que sur des critères cohérents. Sans règles plus claires et sans obligation explicite de fournir des preuves solides, le seuil de validation de la valeur reste trop variable.

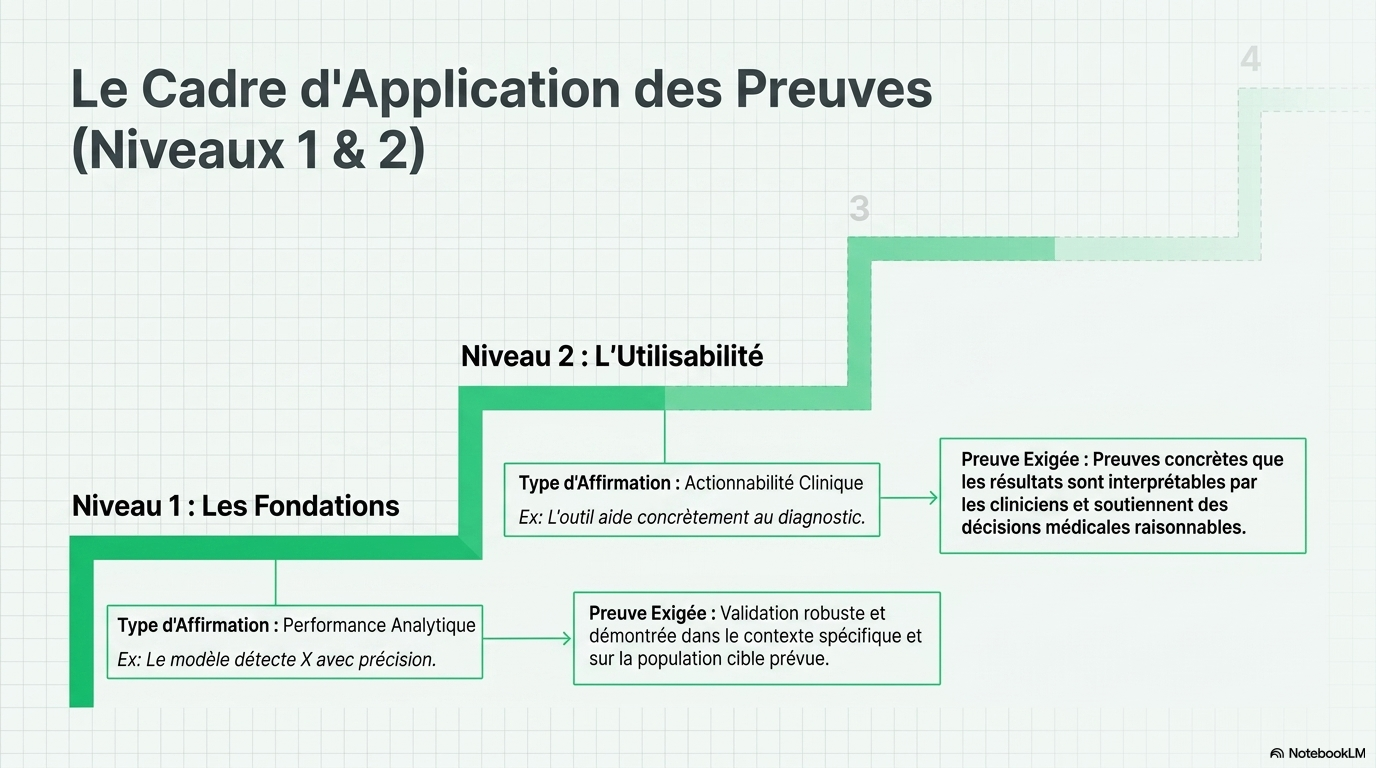

À l'avenir, le domaine de l'IA médicale devra se doter d'un cadre cohérent permettant de relier les affirmations relatives à la valeur clinique d'un outil d'IA aux preuves nécessaires pour les étayer.

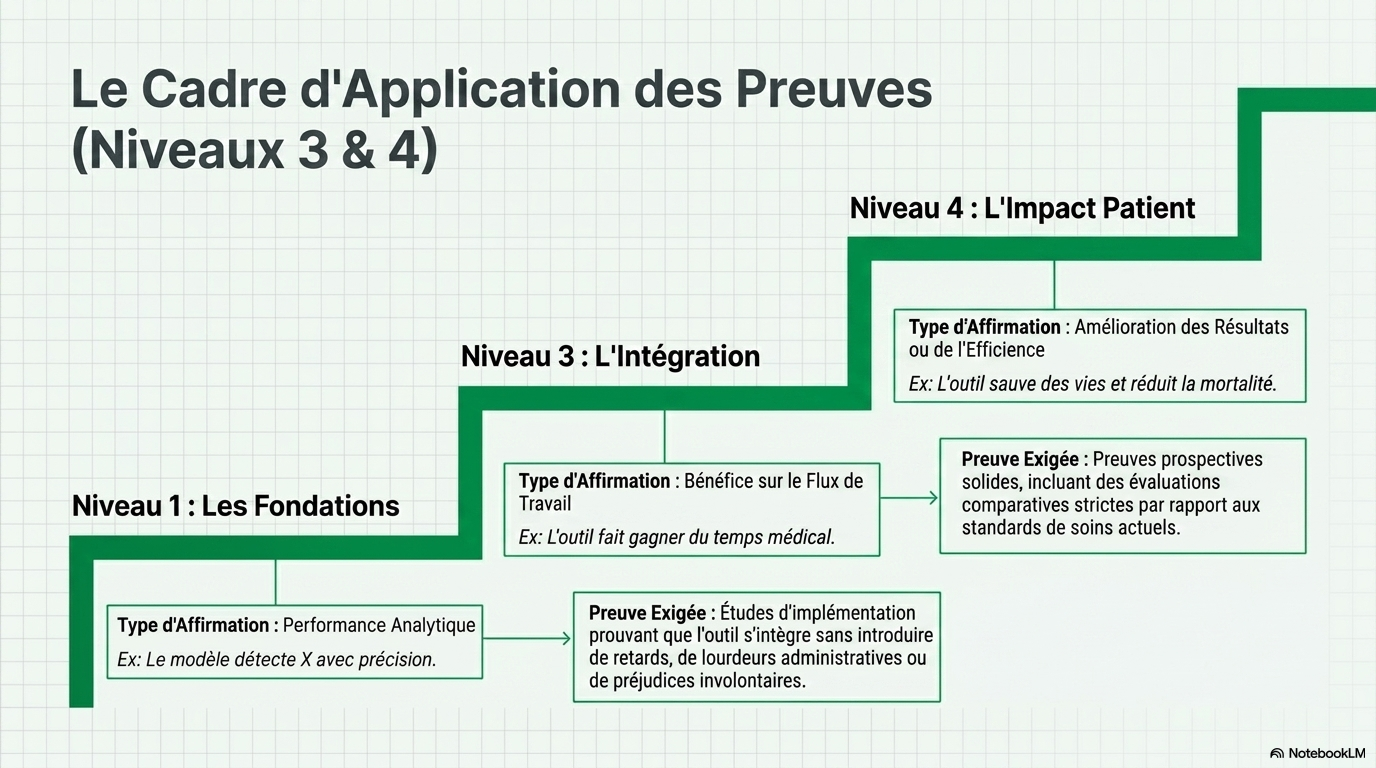

Ainsi, les allégations sur les performances analytiques devront être validées rigoureusement dans le contexte et sur la population cible, et celles portant sur l’applicabilité clinique devront montrer que les résultats sont interprétables et permettent de prendre des décisions éclairées.

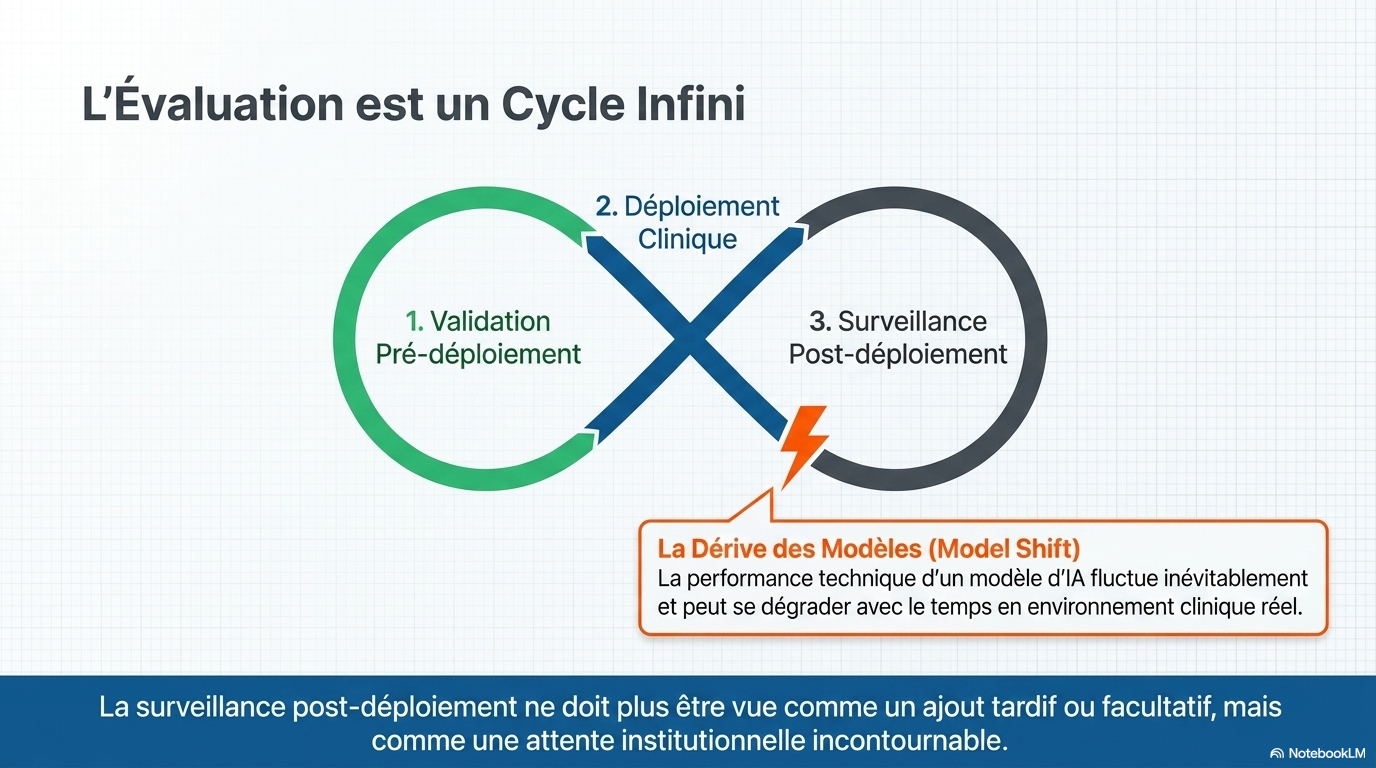

Les affirmations concernant l'amélioration des flux de travail devront s'appuyer sur des études d'implémentation démontrant que les outils peuvent être intégrés sans engendrer de retards, de surcharges ou d'effets indésirables. Les affirmations concernant l'amélioration des résultats ou de l'efficacité devront s'appuyer sur des preuves prospectives plus solides, avec, le cas échéant, des évaluations comparatives aux pratiques courantes. De plus, étant donné que la performance des modèles peut évoluer au fil du temps, le suivi post-déploiement devra être considéré comme une exigence institutionnelle et non comme une option ultérieure.

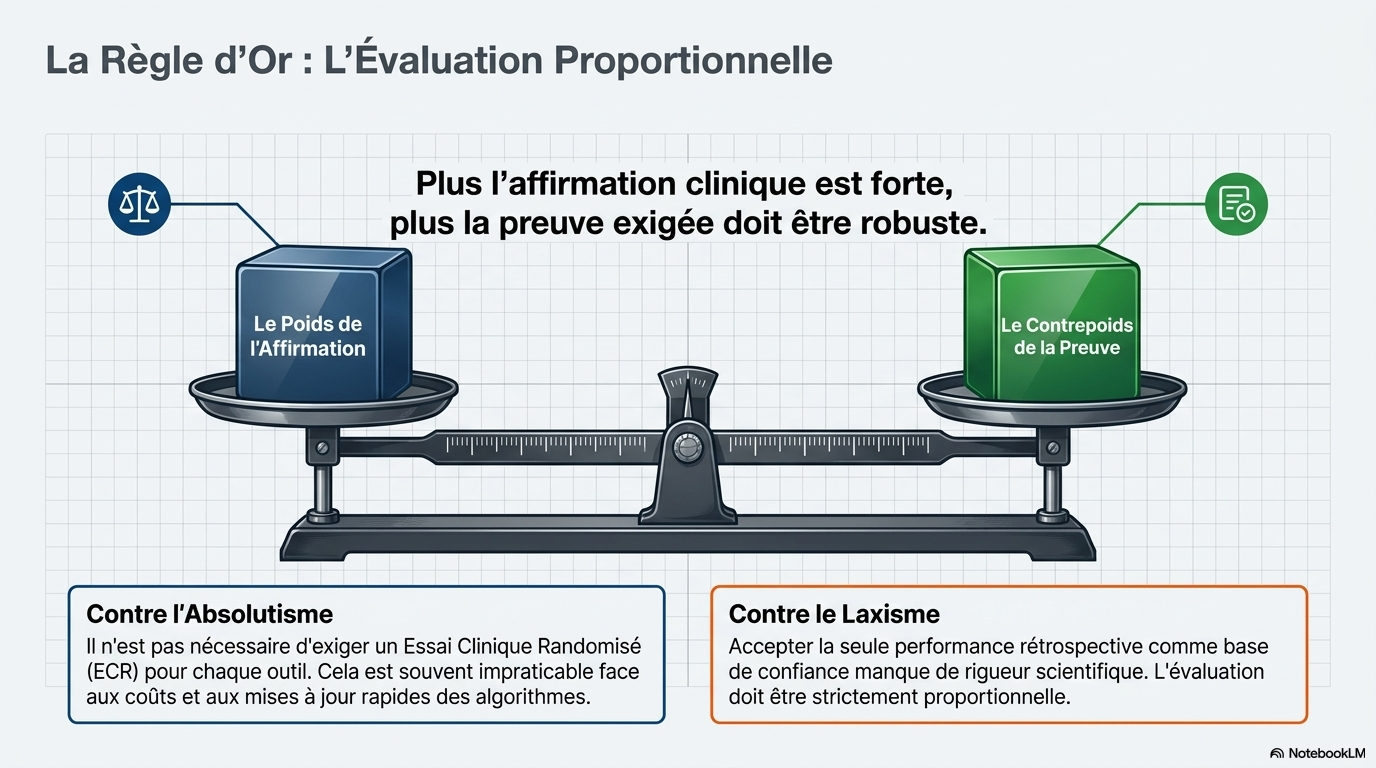

L'existence d'un tel cadre ne signifie pas que chaque outil d'IA doive subir toutes les phases de test, jusqu'à un essai contrôlé randomisé, avant son adoption, comme c'est généralement le cas pour les autres interventions médicales.

Dans de nombreux cas, cela serait irréalisable, compte tenu des coûts élevés, de la mise à jour rapide des modèles sous-jacents et de la complexité et du temps nécessaires à la réalisation de telles études. Par ailleurs, se fier uniquement aux performances rétrospectives pour établir la confiance n'est pas scientifiquement rigoureux. L'objectif devrait donc être une preuve proportionnelle : plus l'affirmation est forte, plus les preuves nécessaires pour la soutenir doivent être solides.

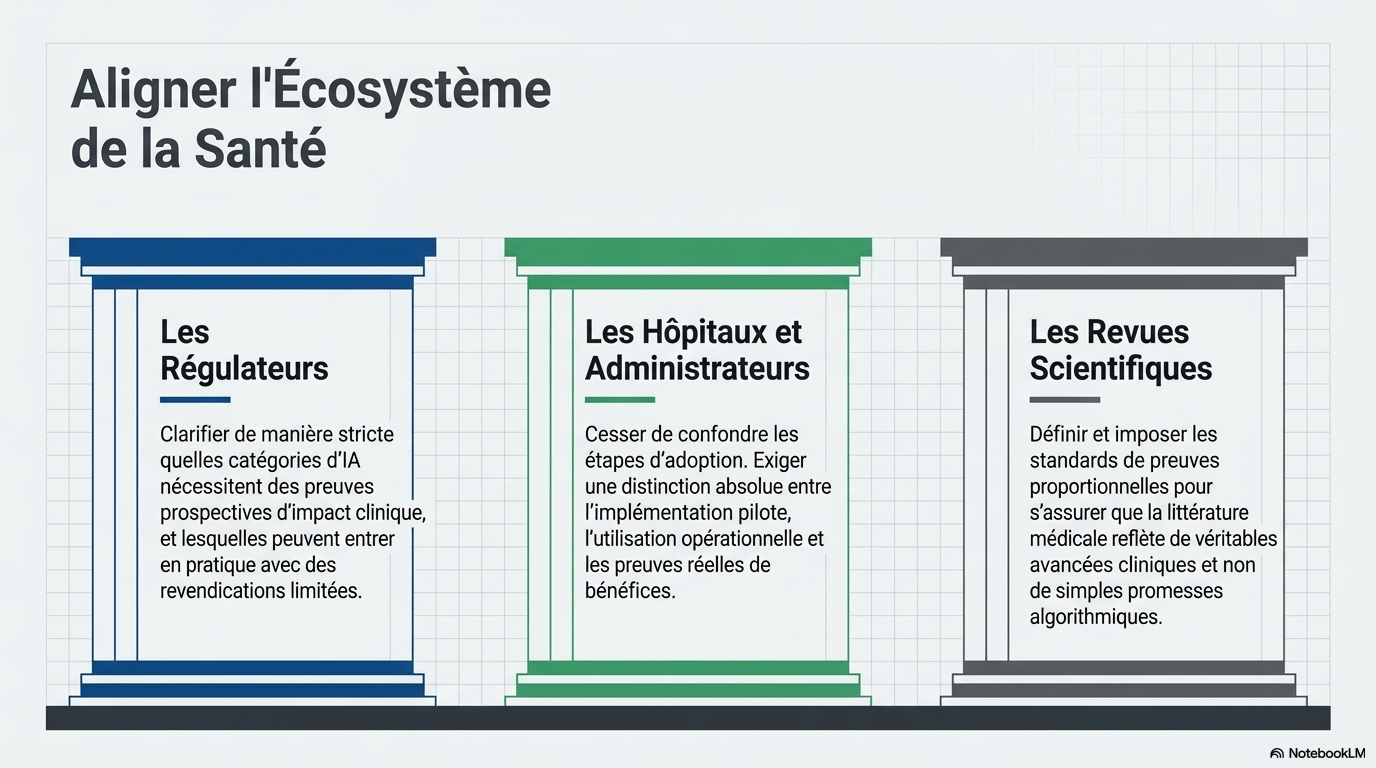

Ce principe a des implications pratiques pour toutes les parties prenantes. Par exemple, les organismes de réglementation devraient mieux définir quelles catégories d'outils d'IA médicale nécessitent des preuves prospectives d'impact clinique et lesquelles peuvent être mises en pratique sur la base d'allégations plus limitées. Les établissements et les gestionnaires de santé devraient faire la distinction entre la mise en œuvre pilote, l'utilisation opérationnelle et la démonstration d'un bénéfice, plutôt que de les regrouper en une seule décision. Dans tous ces contextes, les critères de preuve devraient être transparents, spécifiques à chaque allégation et susceptibles d'être révisés à mesure que les outils évoluent.

Les revues scientifiques, en tant qu'acteurs de l'écosystème de la recherche, ont une occasion unique de définir les types de preuves acceptables. Dans les domaines émergents, la littérature publiée est souvent considérée comme établissant ce qui constitue une preuve valide pour un domaine de recherche ou de pratique.

En appliquant des normes de preuve proportionnelles, les revues peuvent garantir que les recherches publiées reflètent de véritables affirmations cliniques plutôt que de simples promesses techniques, un rôle que nous continuerons de soutenir chez Nature Medicine .

La prochaine étape du progrès dépendra à la fois de meilleurs modèles et de nouvelles applications, et d'attentes plus claires quant à la définition, l'évaluation et la communication de l'impact clinique. Sans lien évident entre les affirmations et les preuves, l'IA médicale risque d'être adoptée plus rapidement que sa véritable valeur ne puisse être comprise.

AVIS d'une IA sur l'IA médicale/GEMINI

L'article publié dans Nature Medicine en avril 2026, intitulé « Show us the evidence for the value of medical AI », marque un tournant critique dans le discours sur l'intelligence artificielle en santé. Après des années d'enthousiasme, la communauté scientifique exige désormais que les promesses d'amélioration des soins soient étayées par des preuves cliniques rigoureuses et prospectives.

Voici une analyse des points clés de cette réflexion actuelle :

1. La fin de la "fascination pour les scores"

Jusqu'à récemment, la valeur d'une IA médicale était souvent jugée sur sa capacité à surpasser les médecins lors d'examens théoriques (comme le MedQA). L'article souligne que réussir un examen ne signifie pas soigner un patient.

-

Le constat : Les modèles comme Med-PaLM 2 atteignent des scores d'experts (86,5 %), mais restent des outils de recherche sans autorisation clinique généralisée.

-

L'exigence : On demande désormais de passer des bancs d'essai (benchmarks) aux essais cliniques randomisés (ECR) pour mesurer l'impact réel sur la mortalité, le temps de guérison ou la réduction des erreurs de diagnostic.

2. Le fossé entre "Performance" et "Utilité clinique"

L'analyse met en lumière un paradoxe : les IA les plus impressionnantes techniquement ne sont pas forcément celles qui apportent le plus de valeur aujourd'hui.

-

IA administrative vs IA diagnostique : les outils de documentation ambiante (comme DAX Copilot) connaissent une adoption massive car ils réduisent le burn-out des médecins en automatisant la paperasse. Ici, la preuve de la "valeur" est directe et mesurable.

-

Fragilité des modèles : L'article pointe la "frontière dentelée" (jagged frontier) : une IA peut diagnostiquer une pathologie rare avec une précision surhumaine, mais échouer lamentablement sur un cas de routine à cause d'un biais dans les données d'entraînement.

3. La crise de confiance et les "hallucinations médicales"

L'année 2026 a été marquée par des incidents documentés (comme l'affaire bixonimania, une maladie fictive que plusieurs IA ont traitée comme réelle).

-

La preuve par la sécurité : Nature insiste sur le fait que la valeur de l'IA ne peut être validée sans des protocoles de vérification des traces de raisonnement (reasoning traces). On ne veut plus seulement une réponse, mais la preuve que l'IA s'appuie sur des sources médicales vérifiées et non sur une probabilité statistique de mots.

4. Vers une médecine fondée sur les preuves (EBM) pour l'IA

L'appel de Nature est clair : l'IA médicale doit intégrer le cadre de la médecine fondée sur les preuves (EBM).

-

Évaluation post-déploiement : une IA validée en laboratoire peut perdre de son efficacité une fois installée dans un hôpital avec un matériel différent. L'article exige un suivi continu.

-

Transparence algorithmique : contrairement aux médicaments dont on connaît la composition, de nombreux algorithmes restent des "boîtes noires" propriétaires, ce qui freine la validation scientifique indépendante.

Synthèse des preuves attendues en 2026

| Type d'IA | Preuve de valeur actuelle | Lacune identifiée |

| Imagerie / Radiologie | Réduction du temps de lecture et détection précoce. | Risque de sur-diagnostic et dépendance technologique. |

| Découverte de médicaments | Succès en Phase IIa (ex: ISM001-055). | Coûts de développement encore très élevés. |

| IA Conversationnelle | Soutien psychiatrique et administratif. | Risque majeur d'hallucinations et de conseils dangereux. |

En résumé : L'analyse de Nature en 2026 nous dit que le temps de "l'IA magique" est révolu. Pour que l'IA soit acceptée comme un outil médical standard, elle doit prouver sa valeur non pas par sa complexité technique, mais par son bénéfice tangible pour le patient, vérifié par des pairs et des études cliniques indépendantes.

SYNTHESE NOTE BOOKLM

Cet éditorial souligne la nécessité urgente d'établir des normes de preuve proportionnelles pour valider l'efficacité réelle de l'intelligence artificielle dans le secteur de la santé. Bien que les outils technologiques progressent rapidement, l'auteur soutient que les simples mesures de performance statistique sont insuffisantes pour garantir une amélioration concrète des soins ou une intégration fluide dans les flux de travail cliniques. Le texte propose donc un cadre d'évaluation rigoureux où la solidité des preuves exigées doit correspondre directement à l'importance des affirmations cliniques avancées par les concepteurs. En fin de compte, l'objectif est d'éviter une adoption prématurée de ces technologies afin de s'assurer que l'innovation servvéritablement la sécurité des patients et l'efficience des systèmes médicaux.

Ce commentaire met l'accent sur l'importance de l'IA médicale pour les patients.

L'arrivée de GOOGLE et notamment du Dr GOOGLE a boosté ' les recherches médicales effectuées par les patients. " Il en est de même avec l'IA et les chatbots. Tel un nouvel oracle, les patients (certains) passent des heures à poser des questions à ChatGPT, notamment . Quand ils sont en consultation avec un médecin, le rythme des questions "médicales" s'accélère. Mais, comme le Dr GOOGLE, l'IA peut dans certains cas raconter aux patients n'importe quoi. De plus, il existe une inadéquation de compréhension entre l'humain et l'IA. En fait, double problème . D'abord, les patients ne connaissaient pas les fondamentaux de la médecine, c'est le problème nᵒ 1. Le deuxième problème, conséquence du premier l'interprétation de l'humain face à l'IA , la recherche de "l'authenticité de la vérité", ce qui amène une impasse entre le médecin et le patient. En fait il faudrait une IA médicale accessible au patient qui soit conçue pour le patient en termes de mots, de langage, de schémas, etc. Il ne faut pas noyer les patients dans une pseudo-confiance. scientifique. Cela semble a priori être LA SOLUTION. Que les patients souhaitent mieux comprendre leur maladie, les indications des examens, des médicaments, la nature d'une intervention chirurgicale , c'est une évidence. L'IA peut solutionner ces problèmes aisément par les preuves médicales destinées à toutes et à tous. Les chatbots patients, doivent naître, c'est une URGENCE. Tout cela est évident, mais ce qui s'impose aujourd'hui, c'est la complexité et les usines à gaz "sans gaz". Les patients pensent qu'ils sont bien informés, mais une fois sur deux ils sont mal informés et c'est dangereux pour leur santé. Pour eux, l'IA est un grand manitou qui ne peut se tromper, c'est la VRAIE VIE , leur VRAIE VIE ! L'IA peut se tromper, ce qui peut entraîner des "hallucinations" chez les patients....et des catastrophes médicales, il faut en être conscient et rester vigilant et surtout continuer de penser.