"L’intelligence artificielle est créée par des humains, conçue pour se comporter selon des intentions humaines, et destinée, en fin de compte, à impacter les vies humaines et la société. "

"Ces systèmes restent entièrement dépendants des décisions humaines."

" l’intelligence artificielle ne définit pas à elle seule le futur.C’est la manière dont nous choisissons de la concevoir et de l’utiliser qui déterminera son rôle dans nos vies et dans la société."

Fei Fei Li

Fei-Fei Li, née en à Pékin, est une informaticienne et chercheuse américaine spécialiste de la vision artificielle. Professeure d'informatique à l'université Stanford, elle est aussi co-directrice du Stanford Institute for Human-Centered Artificial Intelligence, et co-directrice du Stanford Vision and Learning Lab.

Elle dirige le Stanford Artificial Intelligence Laboratory (SAIL) de 2013 à 2018. En 2017, elle co-fonde AI4ALL (Intelligence artificielle pour tous), pour augmenter la diversité et l'inclusion dans le domaine de l'IA.

Ses activités de recherche concernent l'apprentissage automatique, l'apprentissage profond, la vision par ordinateur et les neurosciences cognitives. Elle est la principale instigatrice de la base d'images ImageNet (WIKIPEDIA)

[Simulation] IA et compétences médicales : et si la simulation était l'antidote à la dette cognitive ?

Lucile Sivot ✍️ / LINKEDIN

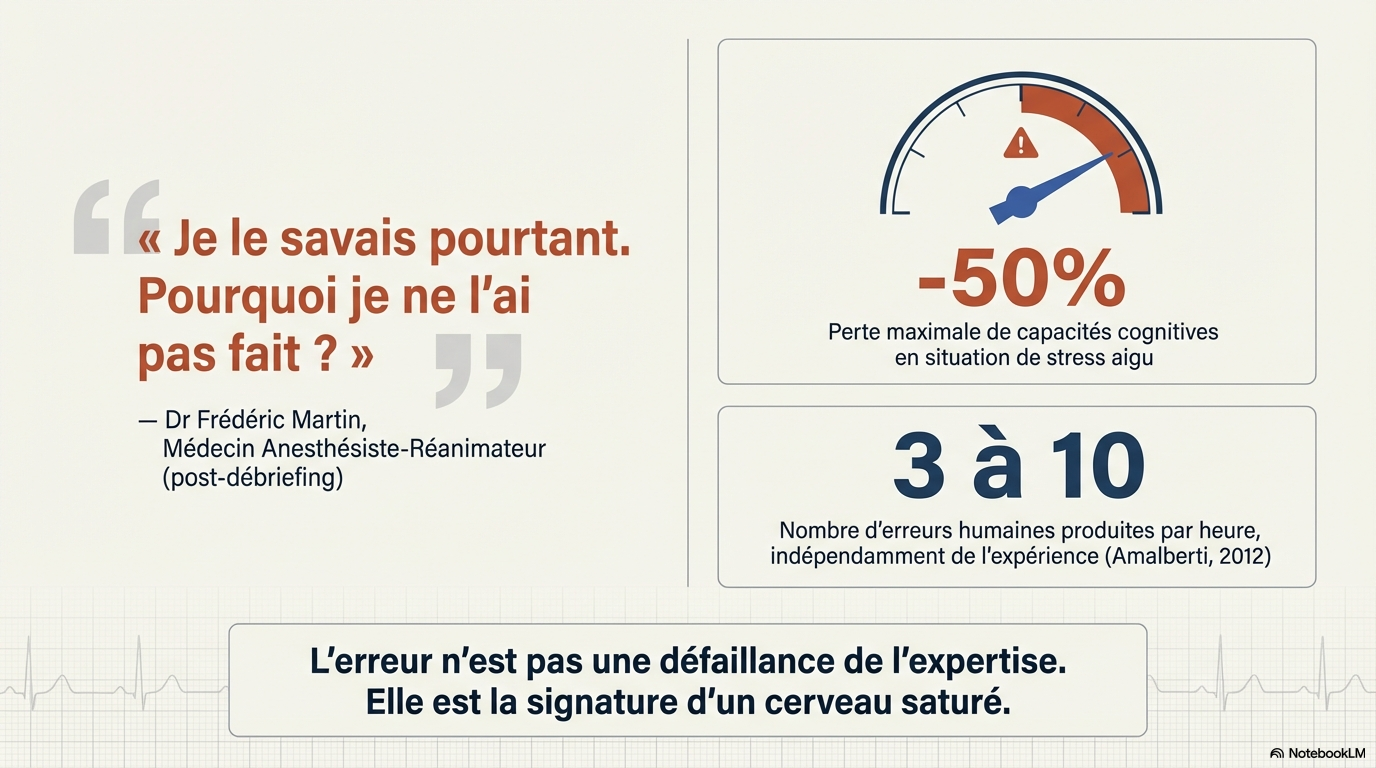

« Je le savais pourtant. Pourquoi je ne l'ai pas fait ? »

Cette phrase, le Dr Frédéric Martin, médecin anesthésiste-réanimateur à la Clinique des Franciscaines, l'a entendue des centaines de fois. Dans les salles de débriefing, après les simulations, quand le stress est redescendu et que la lucidité revient.

Elle résume à elle seule ce que les sciences cognitives documentent depuis des décennies : l'erreur n'est pas l’expression d'une défaillance. Elle est « humaine ». En situation de stress, le professionnel de santé perd jusqu'à 50% de ses capacités cognitives. Chacun d'entre nous produit 3 à 10 erreurs par heure, indépendamment de l'expérience et du niveau de compétences [1].

👉 L'essor de l'IA au bloc, aux urgences et en consultation interroge:si l'IA compense une partie de cette charge cognitive au quotidien, que se passe-t-il le jour où elle n'est plus disponible ❓

L'IA AMÉLIORE LA PERFORMANCE. ELLE MODIFIE AUSSI LE RAISONNEMENT.

Trois études récentes éclairent ce double mouvement de façon convergente.

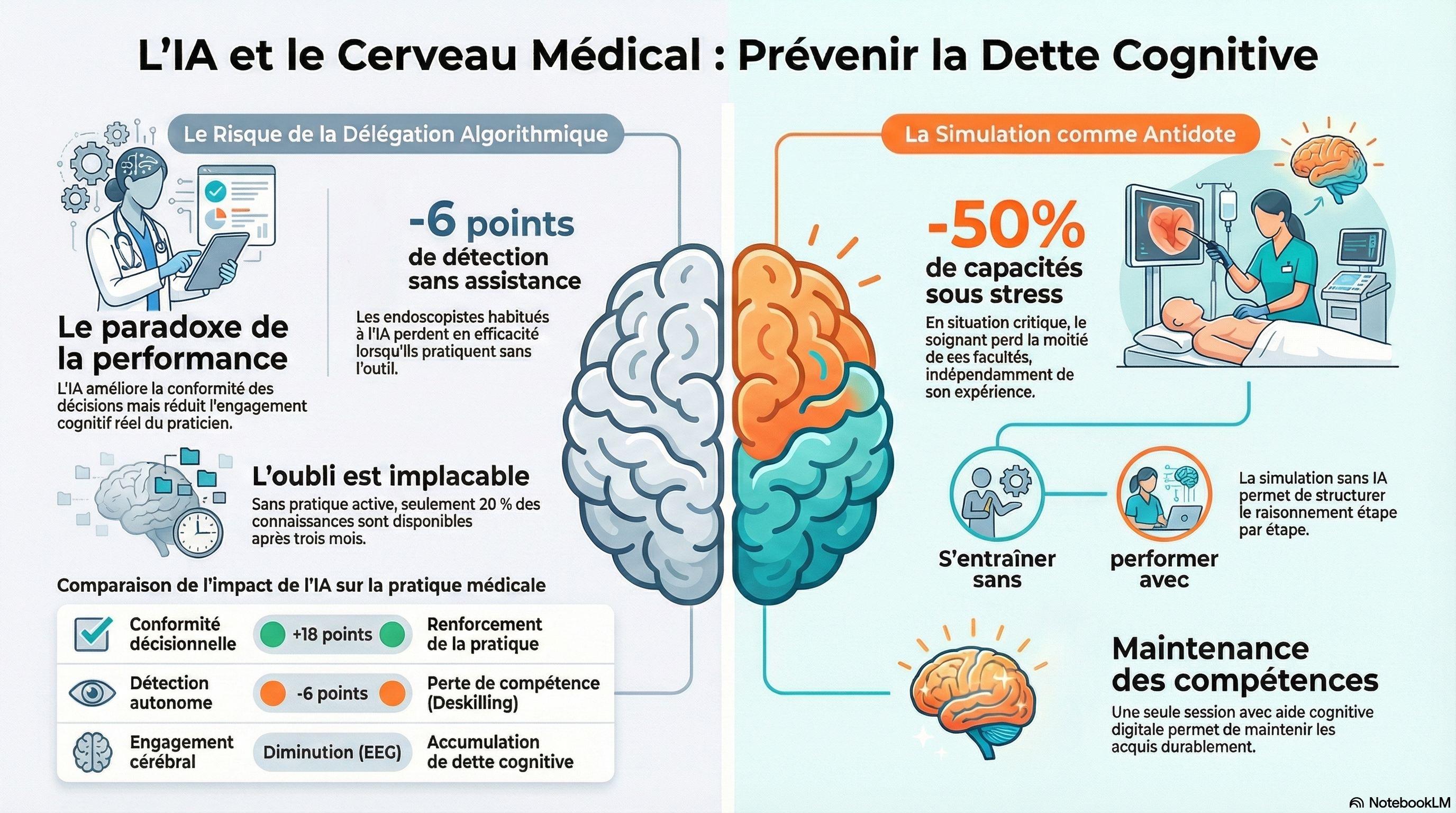

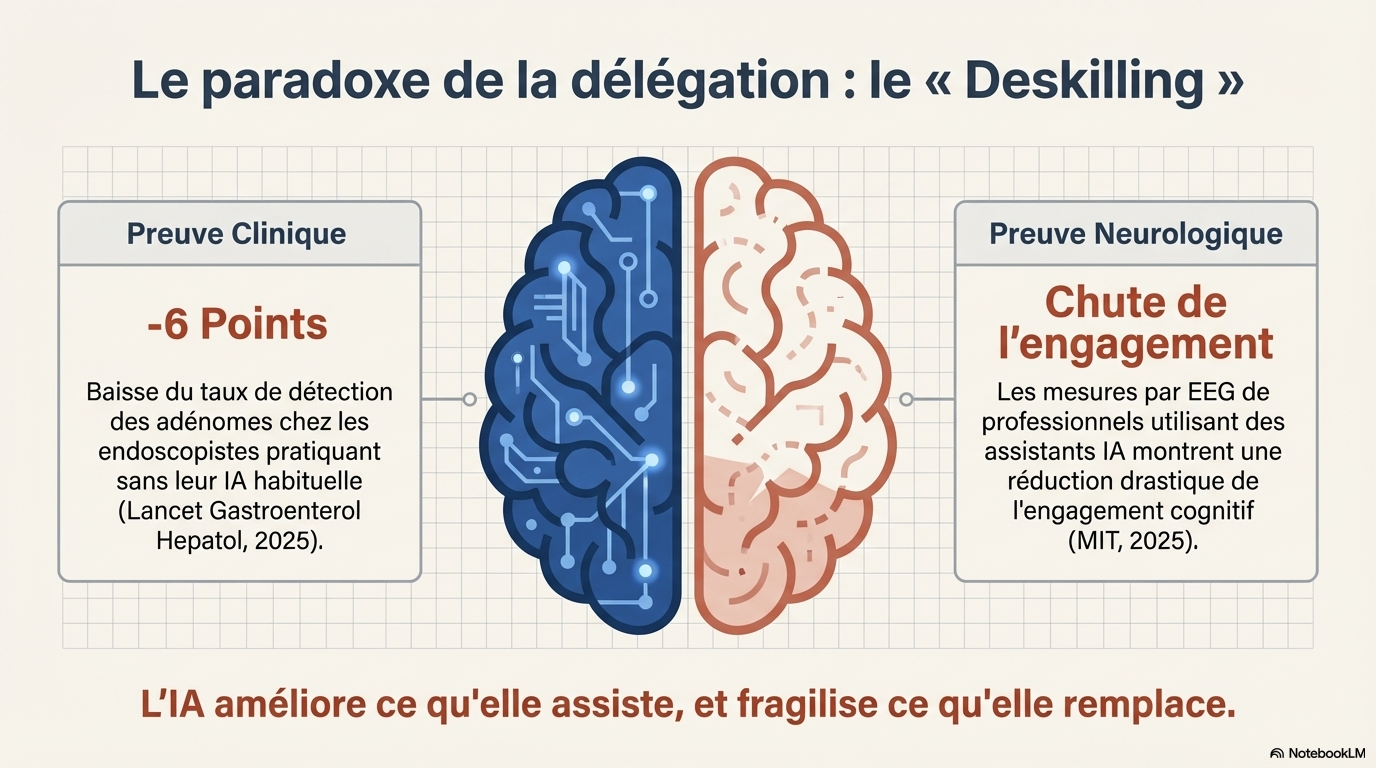

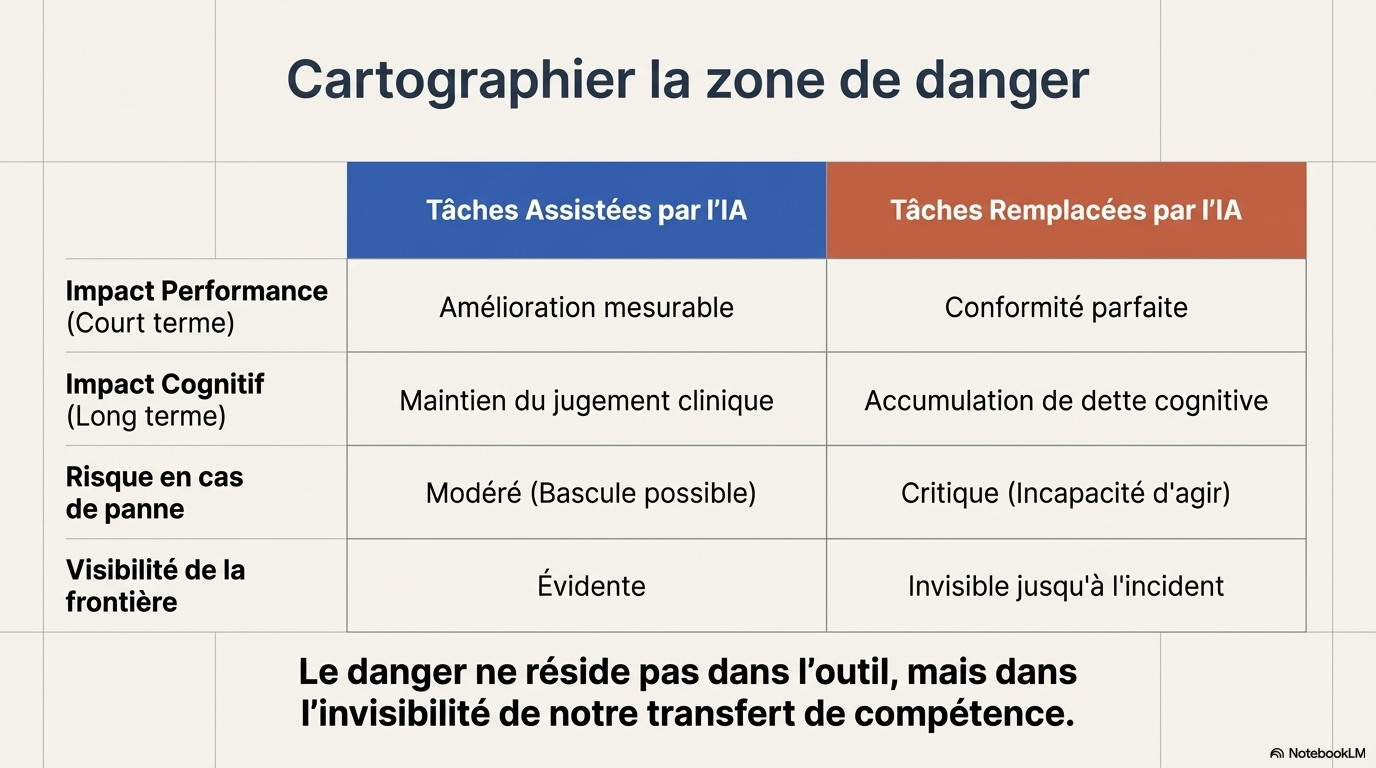

1️⃣En gastroentérologie, une étude publiée dans The Lancet Gastroenterology & Hepatology en 2025 a mesuré ce que les chercheurs appellent le "deskilling" ou la perte de compétences : des endoscopistes exposés régulièrement à l'IA de détection des adénomes voient leur taux de détection baisser de 6 points lorsqu'ils pratiquent sans assistance algorithmique. L'outil semble fragiliser l’expertise en son absence [2].

2️⃣ Au MIT, une étude en préprint a mesuré par EEG l'activité cérébrale de rédacteurs utilisant ChatGPT de façon régulière : les chercheurs observent une réduction significative de l'engagement cognitif. La dette cognitive s'accumule silencieusement, sans que le professionnel en ait conscience [3].

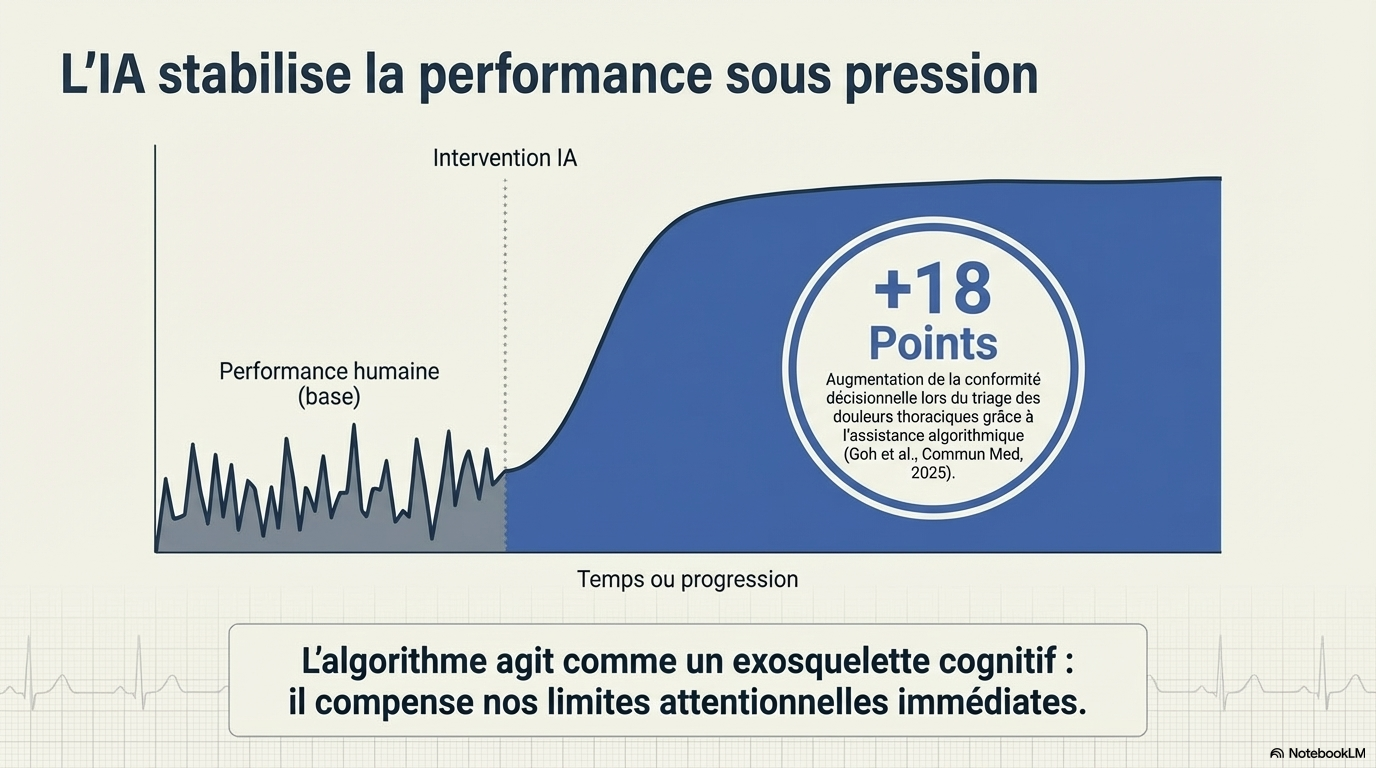

3️⃣ En miroir, une troisième étude sur le triage de douleur thoracique montre que l'IA augmente la conformité décisionnelle de 18 points - preuve que l'outil peut aussi renforcer la pratique [4].

📌 Ces trois résultats coexistent. Ensemble, ils dessinent une réalité plus nuancée qu'il n'y paraît : l'IA améliore ce qu'elle assiste, et fragilise ce qu'elle remplace. La frontière entre les deux n'est pas toujours visible au moment où elle se déplace.

🧠 LE CERVEAU SÉQUENTIEL NE SE SOUVIENT PAS DE TOUT

Pour comprendre pourquoi ce phénomène touche même les soignants les plus expérimentés, il faut revenir à un principe fondamental des sciences cognitives : le cerveau est séquentiel.

👉 Quand des tâches requièrent une attention consciente, il les gère de manière alternativement séquentielle - il ne peut pas en traiter plusieurs simultanément avec la même fiabilité. Or, s'il délègue progressivement certaines d'entre elles à un algorithme, il cesse de les exercer.

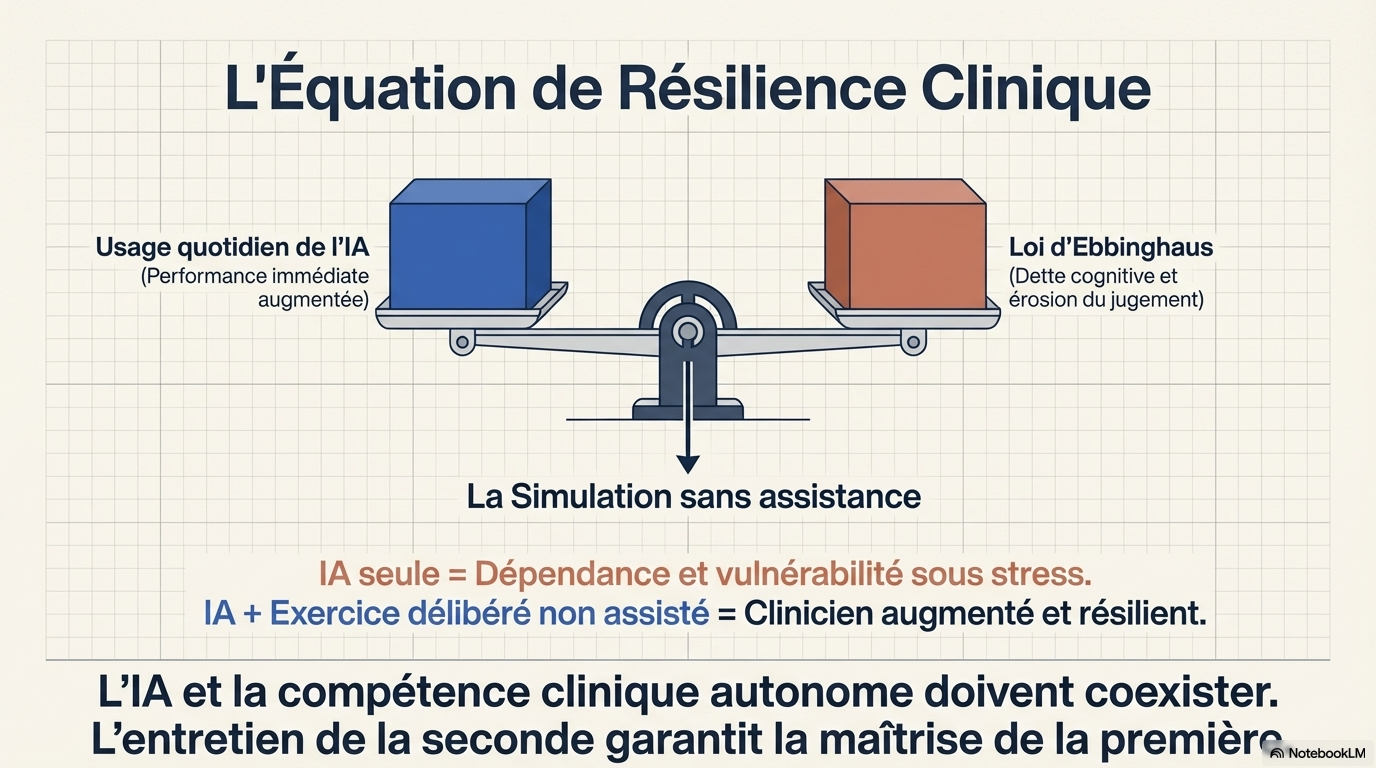

La courbe de l'oubli, décrite par Ebbinghaus dès 1885, est implacable : après trois mois sans pratique active, environ 20% seulement des connaissances acquises sont disponibles en mémoire [5]. Et ce constat est fait en situation normale. Sous l'effet du stress, les "tiroirs" se ferment encore plus vite.

📌 L'érosion des compétences cognitives sous l'effet de la délégation algorithmique est un mécanisme documenté, inhérent au fonctionnement du cerveau humain, que la généralisation de l'IA rend simplement plus visible et plus urgent à considérer.

LA SIMULATION COMME CONTRE-POIDS : UNE HYPOTHÈSE QUI SE CONSOLIDE

🔵 La simulation avec aides cognitives numériques présente une option remarquable pour l'entretien actif du raisonnement autonome.

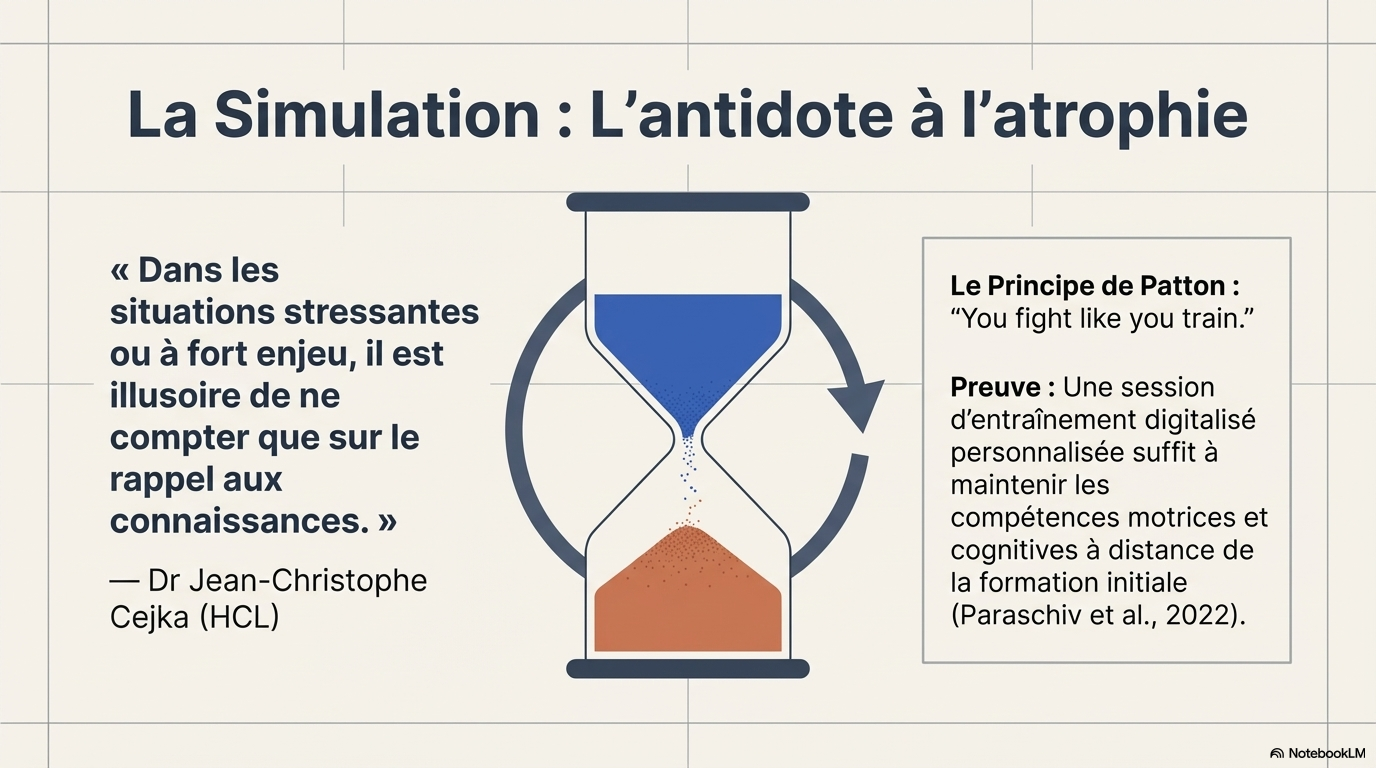

Le Dr Jean-Christophe Cejka, médecin anesthésiste-réanimateur aux Hospices Civils de Lyon, formule le principe ainsi : « Quelle que soit la qualité des formations, il nous arrivera toujours d'avoir à gérer une situation inhabituelle à distance de la formation, stressante ou à fort enjeu. Dans ces situations, il est illusoire de ne compter que sur le rappel aux connaissances. »

L'adage du Général George S. Patton - "You fight like you train" - prend ici une dimension nouvelle. Si le soignant s'entraîne avec l'IA, il performera avec l'IA. Mais s'il ne s'entraîne pas sans elle, il ne saura plus performer sans elle.

Un travail pilote récent évalue l'impact d'une aide cognitive digitale séquentielle personnalisée sur le maintien des compétences dans le temps : une seule session d'entraînement avec cet outil permet non seulement d'améliorer les performances techniques par rapport aux fiches papier de référence, mais surtout de maintenir les compétences à distance de la formation [6]. Ce signal, encore préliminaire, ouvre une piste concrète : la simulation régulière avec des outils qui structurent le raisonnement étape par étape pourrait constituer le contrepoids naturel à la dette cognitive induite par l'usage quotidien de l'IA.

➡️ IA et compétence clinique autonome coexistent - à condition d'entretenir activement la seconde pour rester maître de la première.

🩺 À RETENIR

📌 En situation de stress, le soignant perd jusqu'à 50% de ses capacités cognitives, indépendamment de l'expérience.

📌 L'IA améliore la performance en présence, mais des études récentes suggèrent qu'elle peut fragiliser le raisonnement autonome à distance, via un mécanisme de délégation progressive.

📌 La courbe de l'oubli s'applique aux compétences cognitives comme aux connaissances : sans pratique active, elles s'érodent en quelques mois.

📌 La simulation avec aides cognitives numériques structurées pourrait constituer un dispositif d'entretien du raisonnement autonome - un entraînement sans IA pour mieux performer avec.

📌 Maintenir, à côté de l'usage des outils d'assistance algorithmique, un espace d'exercice délibéré du jugement clinique non assisté conditionne la robustesse du raisonnement.

💬 Et vous, prévoyez-vous des temps de simulation réguliers sans assistance algorithmique dans votre service ou votre formation continue ?

SOURCES

[1] Amalberti R. Piloter la sécurité. Théories et pratiques sur les compromis et les arbitrages nécessaires. Lavoisier, 2012.

[2] Budzyń K, Romańczyk M, Kitala D, Kołodziej P, Bugajski M, Adami HO, et al. Endoscopist deskilling risk after exposure to artificial intelligence in colonoscopy: a multicentre, observational study. Lancet Gastroenterol Hepatol. 2025 Oct;10(10):896–903. doi: 10.1016/S2468-1253(25)00133-5.

[3] Kosmyna N, Hauptmann E, Yuan YT, Situ J, Liao XH, Beresnitzky AV, et al. Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task. arXiv [Preprint]. 2025. doi: 10.48550/arXiv.2506.08872.

[4] Goh E, Bunning B, Khoong EC, Gallo RJ, Milstein A, Centola D, et al. Physician clinical decision modification and bias assessment in a randomized controlled trial of AI assistance. Commun Med. 2025 Mar 4;5:59. doi: 10.1038/s43856-025-00781-2.

[5] Paraschiv AP, Cejka JC, Lilot M, Aigle L, Lehot JJ, Balança B. Impact of a Digital Cognitive Aid on the Performance of Military Healthcare Teams During Critical Care Management in a Warfront Injury Situation: A Simulation Randomized Controlled Study. Simul Healthc. 2022;17(3):163-169. doi:10.1097/SIH.0000000000000623

[6] Perriguey C., Kabir-Idrissi I., Rouge J. Abstract SFAR 2023

SYNTHESE NOTEBOOKLM

Ce texte explore le paradoxe de l’intelligence artificielle en médecine, soulignant que si l'IA accroît l'efficacité immédiate, elle engendre également une dette cognitive et une perte de compétences autonomes chez les praticiens. L'auteure s'appuie sur des études récentes pour démontrer que la délégation algorithmique modifie le raisonnement humain, affaiblissant la capacité de décision lorsque l'outil n'est plus disponible. Face à ce risque de « désapprentissage » accentué par le stress et la courbe de l'oubli, l'article propose la simulation médicale comme un remède indispensable. Exercer cette pratique de façon régulière permet de conserver la force du jugement clinique, et garantit que le soignant reste maître de sa technologie et ne devienne pas dépendant.

- Le revers de la médaille : une étude majeure publiée dans The Lancet Gastroenterology & Hepatology (2025) a mesuré le « deskilling ». Des endoscopistes utilisant régulièrement une IA de détection des adénomes voient leur performance chuter de 6 points lorsqu'ils doivent pratiquer sans assistance [2]. L'outil finit par émousser l'acuité du praticien.

- Le bénéfice immédiat : À l'inverse, une étude sur le triage des douleurs thoraciques montre que l'IA augmente la conformité décisionnelle de 18 points [4].

- Simulation sans IA : Il est impératif de s'entraîner sans assistance pour ancrer les réflexes et garantir que le raisonnement autonome reste fonctionnel.

- Aides cognitives digitales vs Papier : Des travaux pilotes ont évalué l'impact d'aides cognitives digitales séquentielles personnalisées. Contrairement aux fiches papier traditionnelles, ces outils numériques structurant le raisonnement étape par étape permettent non seulement d'améliorer la performance technique, mais surtout de mieux maintenir les compétences à distance de la formation [6].

- Entraînement hybride : L'objectif est de s'entraîner sans IA pour être paradoxalement plus performant avec elle, tout en restant capable de piloter seul si le système tombe.

- Fragilité humaine : Le stress réduit les capacités cognitives de 50 %, entraînant 3 à 10 erreurs par heure [1].

- Performance vs autonomie : L'IA peut augmenter la conformité (ex: +18 pts en triage [4]) mais diminue l'acuité autonome (ex: -6 pts en détection [2]).

- Dette cognitive : la délégation algorithmique réduit l'engagement cérébral (mesuré par EEG [3]), créant une érosion silencieuse des compétences.

- Courbe de l'oubli : sans pratique active, 80 % des connaissances s'effacent en 3 mois ; le stress « ferme les tiroirs » de la mémoire [5].

- La simulation structurée : L'usage d'aides cognitives digitales est plus efficace que le papier pour maintenir les compétences et garantir la robustesse du jugement [6].

Excellente mise au point, bravo !

En médecine, ce que l'on fait de mieux, ce sont les gestes que l'on répète depuis des années, que ce soit en médecine et en chirurgie.

La venue de l'IA en médecine bouscule "le train-train quotidien". Mais laisser la place à l'IA serait à l'origine de la diminution de l'expérience acquise par le médecin.

Intégrer l'IA dans nos activités médicales sera possible effectivement avec une formation établie sur la simulation.

Le paradoxe de l'IA en médecine, c'est qu'elle ne doit pas empiéter sur l'expérience du médecin, au contraire elle est censée augmenter ses compétences, mais sans déperdition des capacités des médecins.

De plus, le médecin doit continuer à être vigilant et renforcer son expérience plutôt que de la déléguer à l'IA.

La coexistence de l'IA et du médecin doit être "gagnant-gagnant".

La simulation des actes chirurgicaux dans l'apprentissage en réalité augmentée existe déjà avec succès.

Le concept IA/OUTIL reste la solution médicale idéale, c'est-à-dire que l'on peut envisager l'IMA : Intelligence Médicale Augmentée mais jamais Diminuée par l'IA .

AVIS OPEN AI

La délégation algorithmique présente un risque réel d'affaiblissement des compétences cliniques , particulièrement le "deskilling" (perte de compétences acquises), le "never-skilling" (échec à développer des compétences essentielles), et le "mis-skilling" (renforcement de comportements incorrects). La meilleure solution pour la coexistence IA/médecine repose sur un modèle d'intelligence hybride où l'IA complète plutôt que remplace l'expertise humaine, avec un encadrement structuré et une formation appropriée. [1]

Le problème de la délégation algorithmique

La recherche récente confirme vos préoccupations. Une étude randomisée de 2024 a démontré que l'accès seul aux grands modèles de langage (LLM) n'améliore pas le raisonnement diagnostique des médecins, malgré que l'IA dépasse significativement les performances humaines. [3]Plus préoccupant encore, les utilisateurs qui adoptent aveuglément les résultats de l'IA sans examen critique obtiennent de moins bons résultats, particulièrement ceux avec des performances globales plus faibles.[1]

Les études montrent une corrélation négative significative entre l'utilisation fréquente d'outils IA et les capacités de pensée critique, médiée par une augmentation du déchargement cognitif. Les participants qui dépendent davantage de l'IA montrent une réduction de l'engagement dans la résolution indépendante de problèmes et le raisonnement analytique.[1]Ce risque est particulièrement prononcé chez les apprenants plus jeunes et moins expérimentés, ainsi que dans les contextes de faible prévalence.[2][4]

Solutions pour une coexistence optimale

Utilisé sous licence du New England Journal of Medicine.

Le cadre DEFT-AI (Diagnosis, Evidence, Feedback, Teaching) illustre une approche structurée pour superviser l'utilisation de l'IA tout en préservant le raisonnement clinique. Cette approche transforme chaque interaction avec l'IA en moment éducatif qui favorise la pensée critique plutôt que la dépendance passive.[1]

Compétences essentielles identifiées

Six domaines de compétences ont été définis pour l'utilisation efficace de l'IA :[5]

-

Connaissances de base de l'IA - Comprendre ce qu'est l'IA et ses applications

-

Implications sociales et éthiques - Reconnaître les biais et questions d'équité

-

Rencontres cliniques augmentées par l'IA - Intégrer l'IA dans les soins centraux sur le patient

-

Évaluation fondée sur les preuves - Évaluer la qualité, l'exactitude et les biais des outils IA

-

Analyse des flux de travail - Adapter les rôles et responsabilités

-

Apprentissage continu - Participer au développement professionnel lié à l'IA

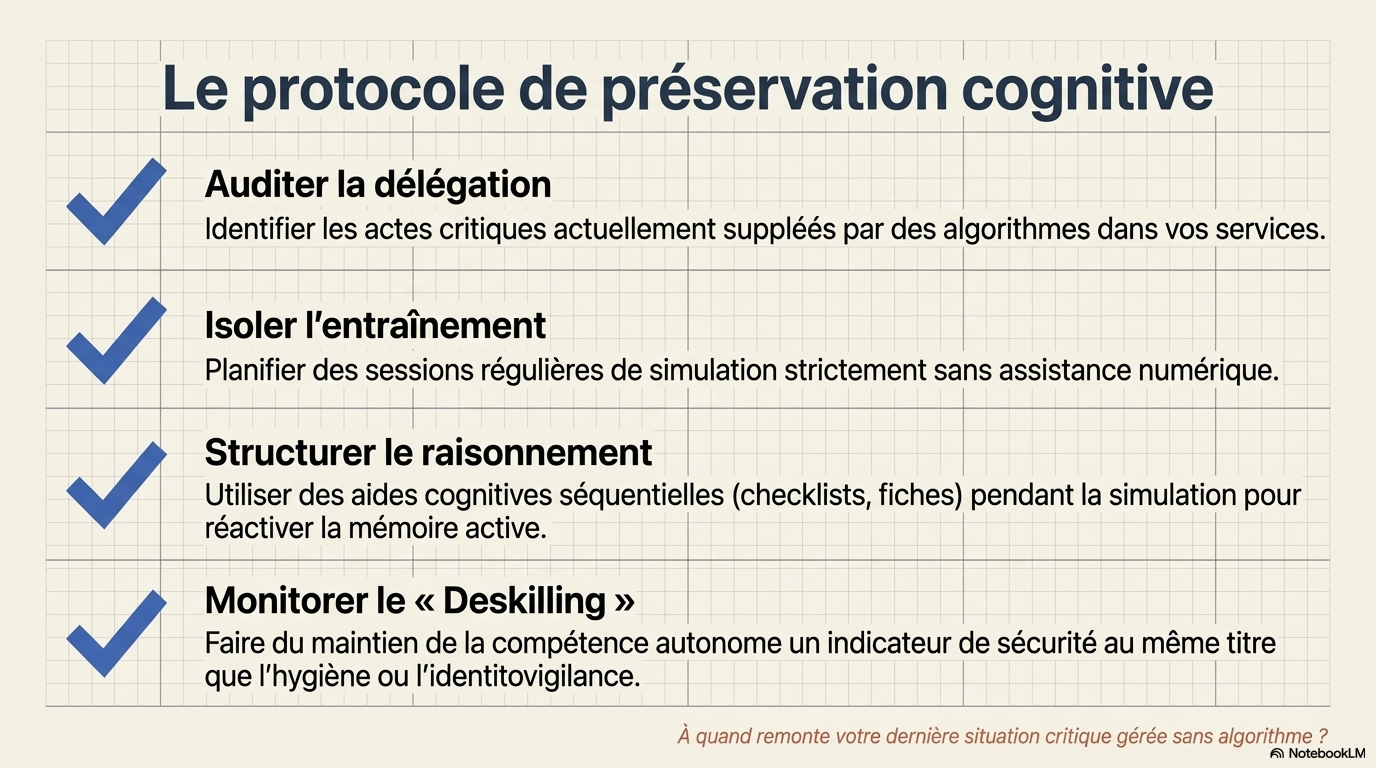

Stratégies de préservation des compétences

La littérature identifie plusieurs stratégies clés :[2][6]

Conception centrale sur l'humain : L'IA doit fournir des informations au bon moment (indices retardés ou activables plutôt qu'immédiats) pour éviter le biais d'automatisation tout en permettant au clinicien de raisonner d'abord.[2]

Raisonnement physiopathologique : L'éducation médicale doit aller au-delà des scripts de maladie et enseigner aux étudiants "comment penser" plutôt que "quoi penser", développant des compétences complémentaires que les machines ne peuvent pas facilement reproduire - raisonnement flexible, résolution créative de problèmes, et navigation de l'incertitude.[7]

Intelligence hybride : Un paradigme où les systèmes de soutien au raisonnement clinique (CRSS) effectuent des tâches empiriques clairement délimitées (raisonnement statistique, identification de patterns dans des données complexes) tandis que les cliniciens interprètent, intègrent et contextualisent ces informations.[6][8]

Formation et supervision structurées : Les programmes de formation continue doivent intégrer l'évaluation critique des outils IA, la détection des biais et l'interprétation des résultats d'explicabilité.[5][9-10]

Recommandations pratiques

Pour éviter la dépendance excessive tout en bénéficiant de l'IA :[2][9][11]

-

Maintenir la supervision humaine : Les médecins doivent interpréter les résultats de l'IA dans le contexte clinique individuel de chaque patient

-

Exiger la transparence : Les systèmes doivent indiquer quels facteurs ont contribué à leurs recommandations, permettant l'évaluation de la plausibilité médicale

-

Implémenter des mécanismes de sécurité : Surveillance post-déploiement, rapports d'événements indésirables, et évaluation continue

-

Former à l'utilisation critique : Enseigner les meilleures pratiques de formulation de requêtes (prompting) et l'évaluation critique des résultats

L'IA doit être considérée comme un outil qui assiste les cliniciens en soutenant de meilleures décisions plus rapides, plutôt que comme un substitut au jugement clinique.[11-12]Comme l'ont souligné les alertes de sécurité dans l'aviation et les leçons de l'industrie manufacturière, même dans des environnements hautement automatisés, l'expertise humaine reste essentielle pour la flexibilité, la pensée critique et la récupération rapide face à des situations imprévues.[13]